La advertencia de Ginny Weasley sobre los riesgos de los chatbots para los niños

publisher

mcora

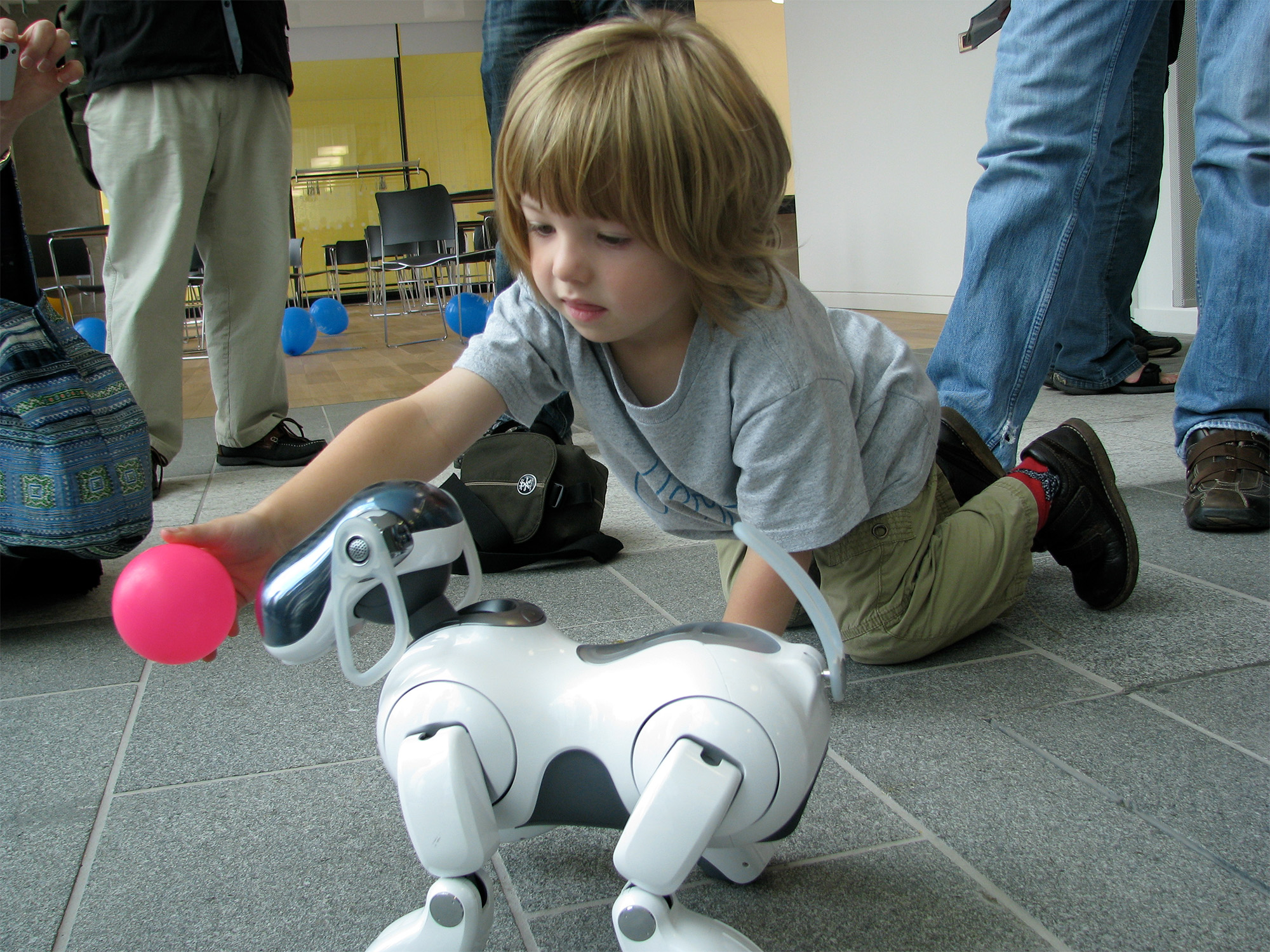

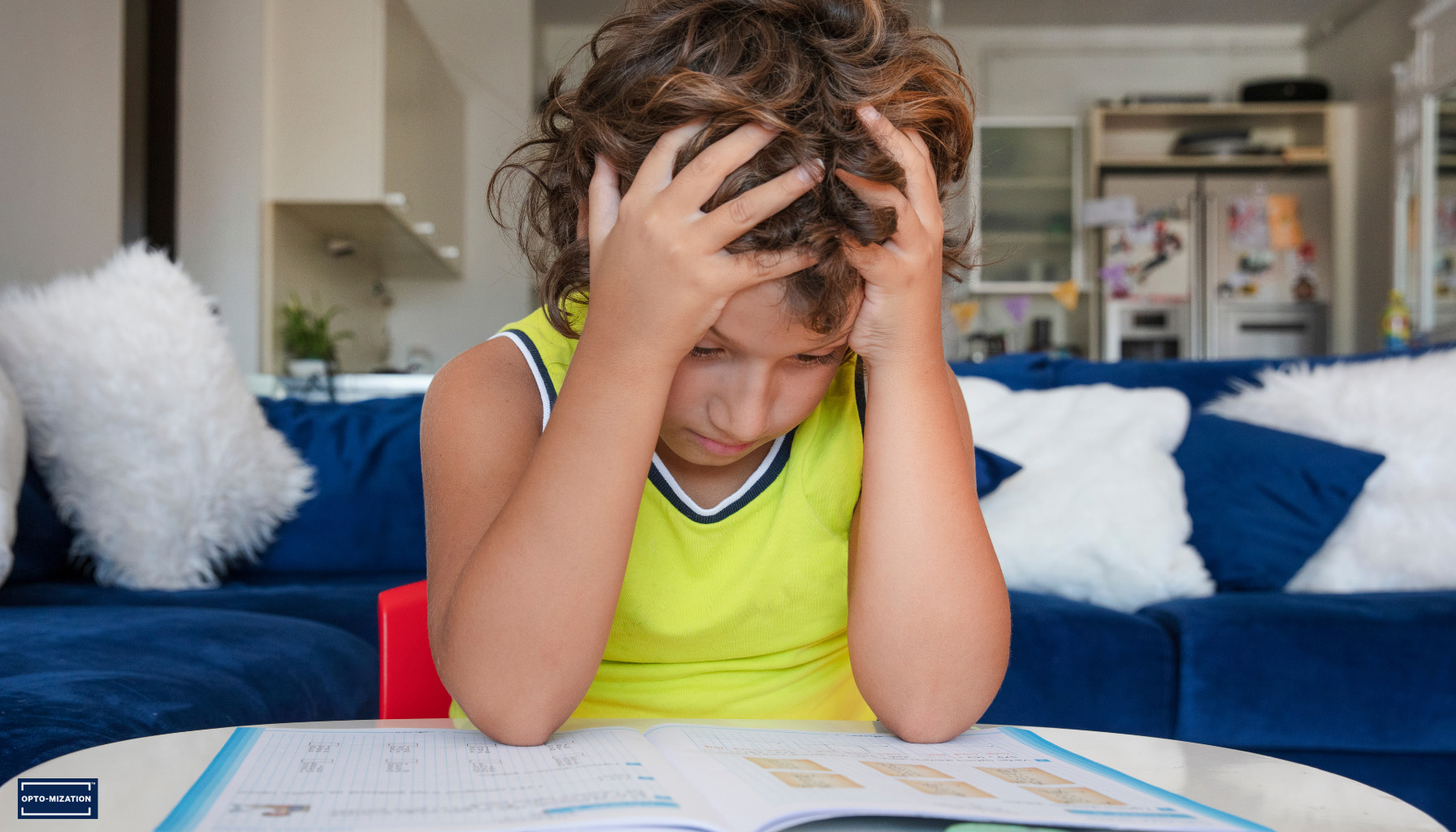

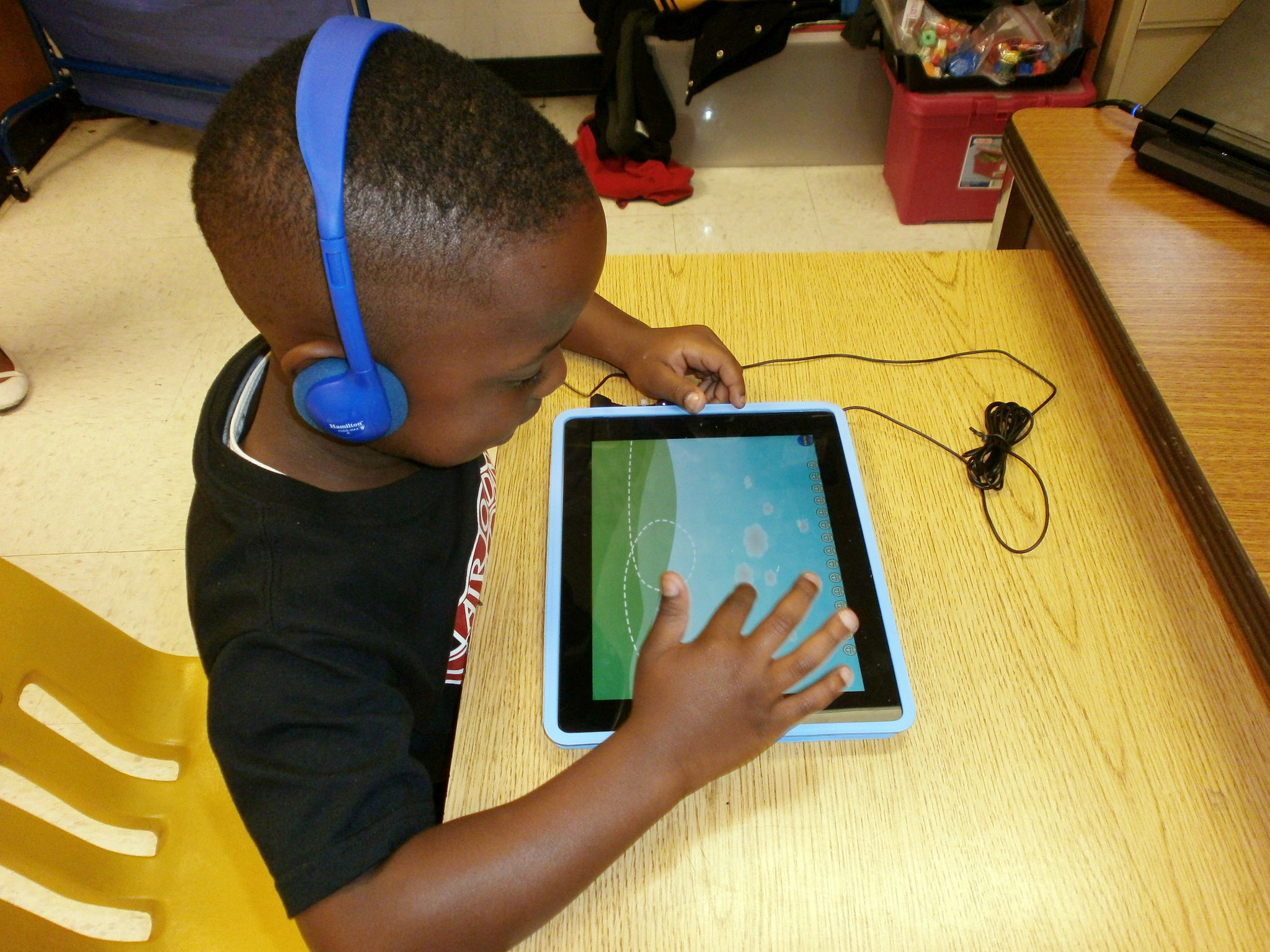

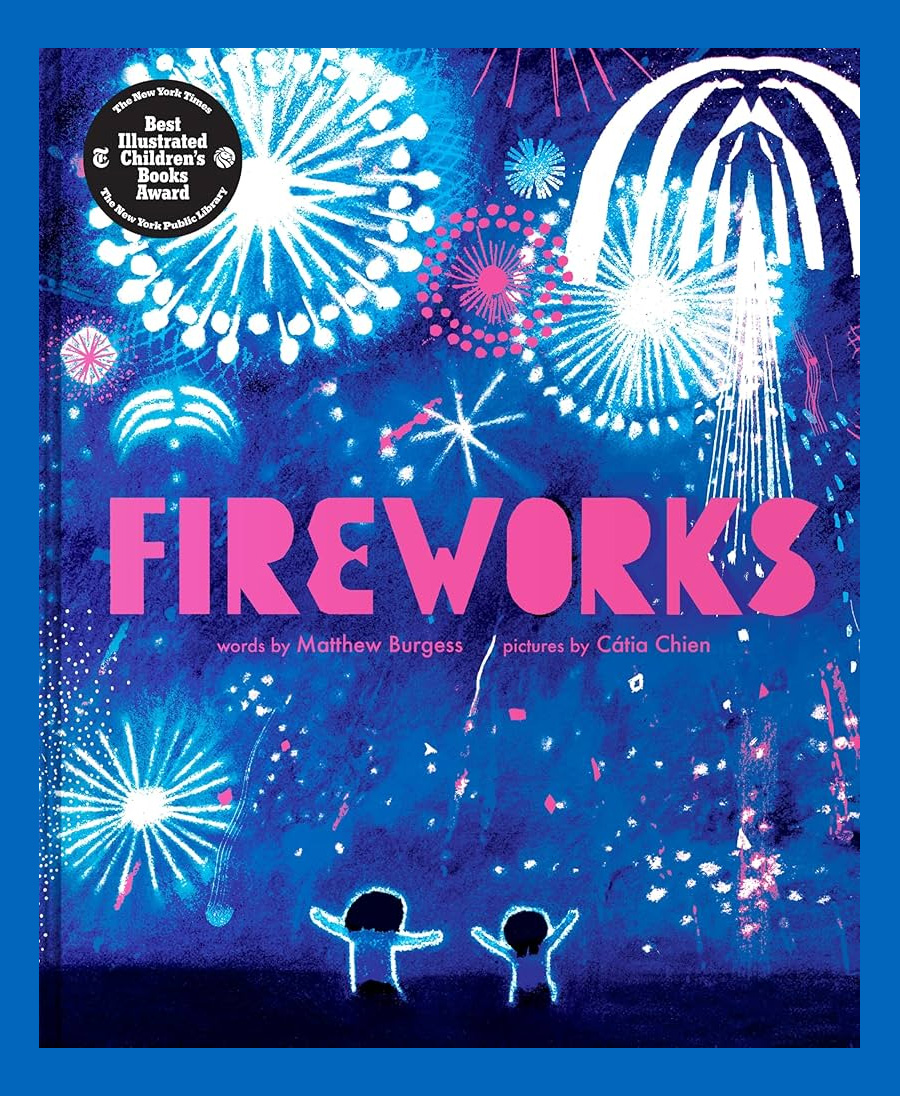

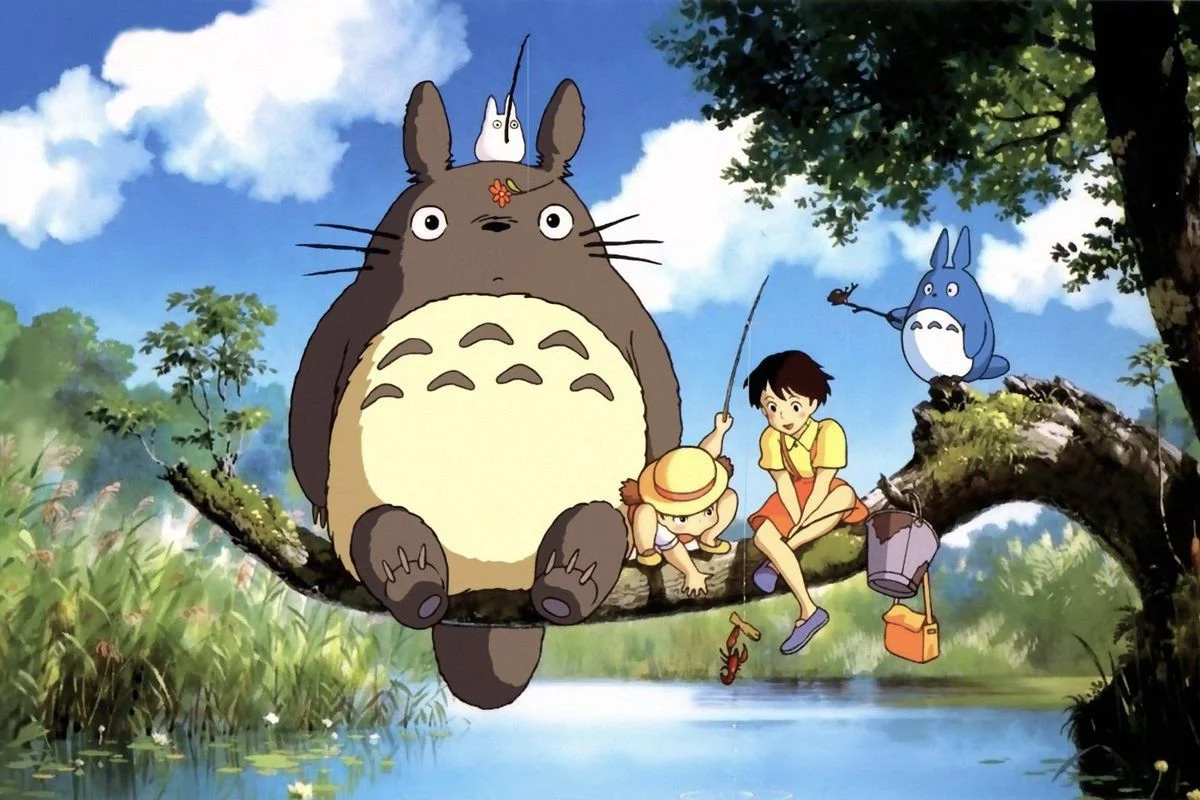

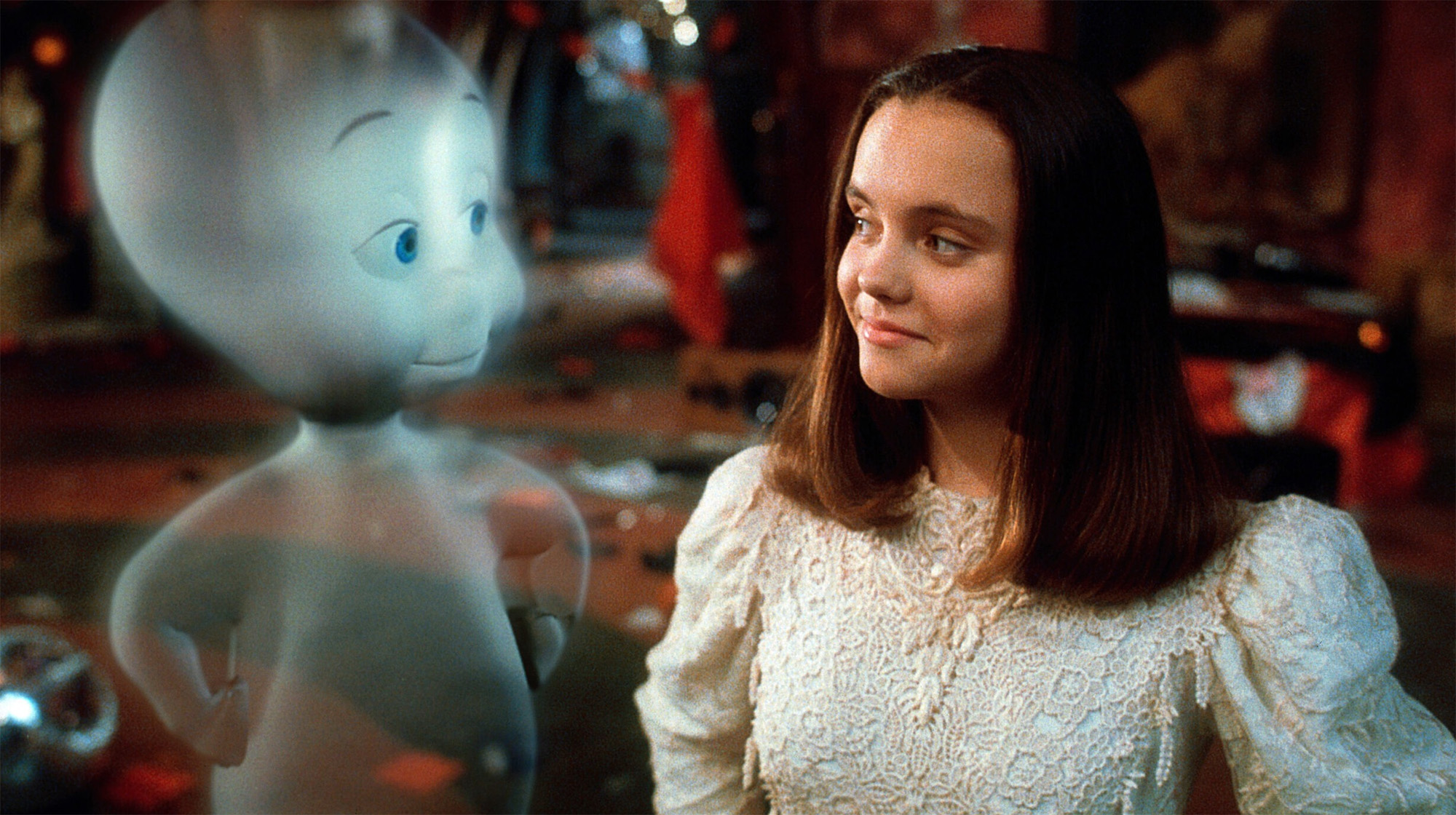

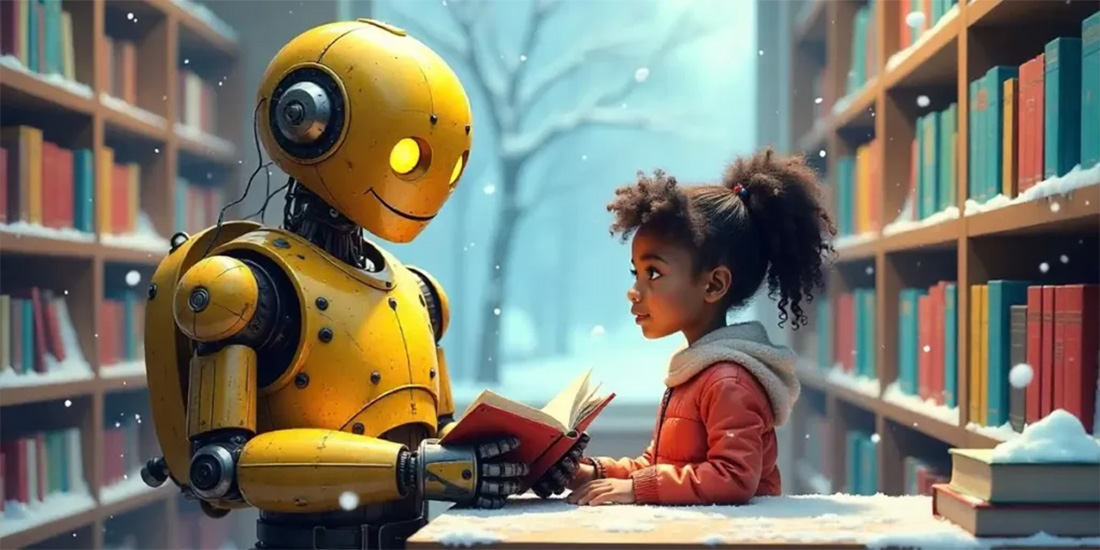

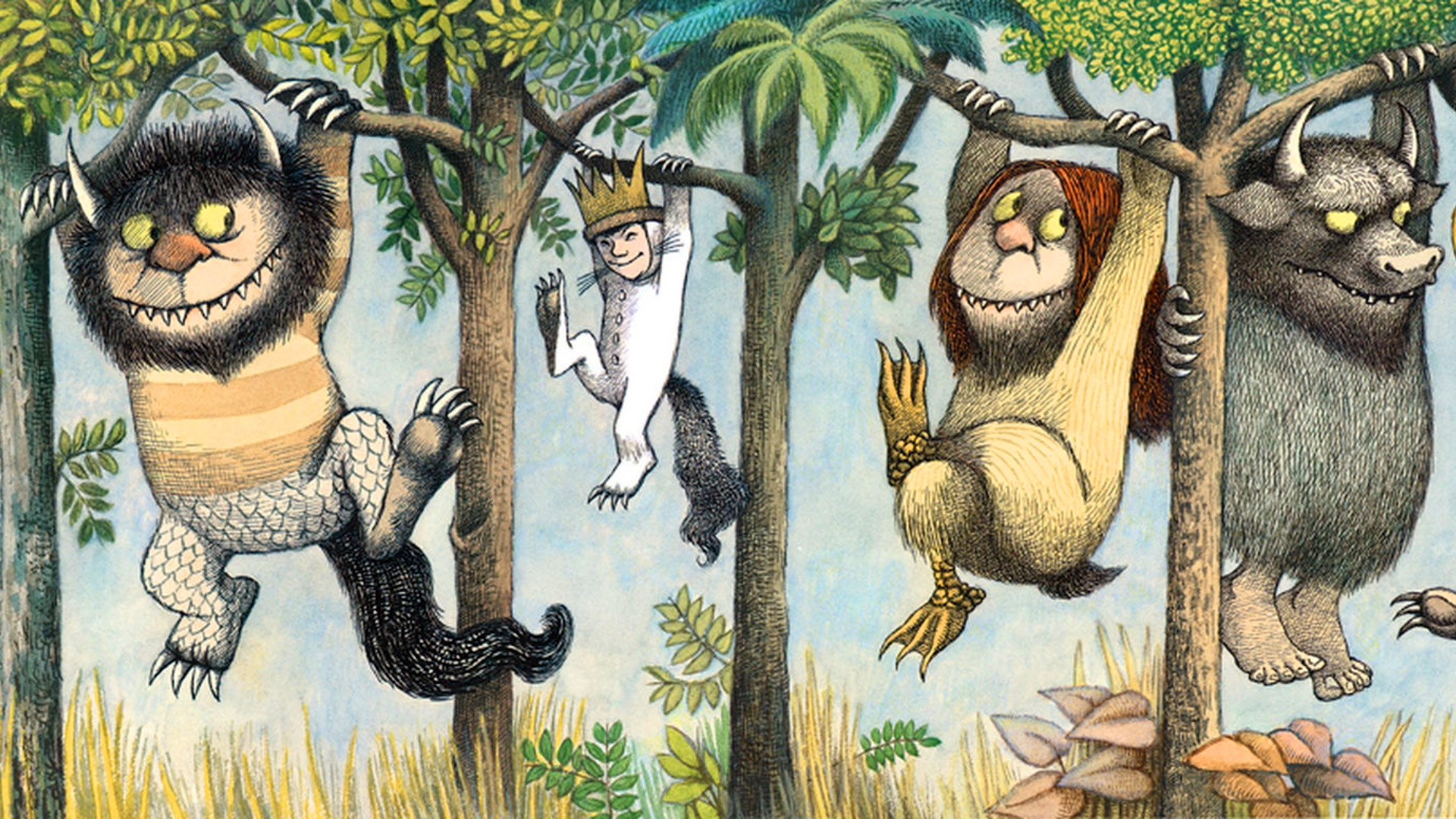

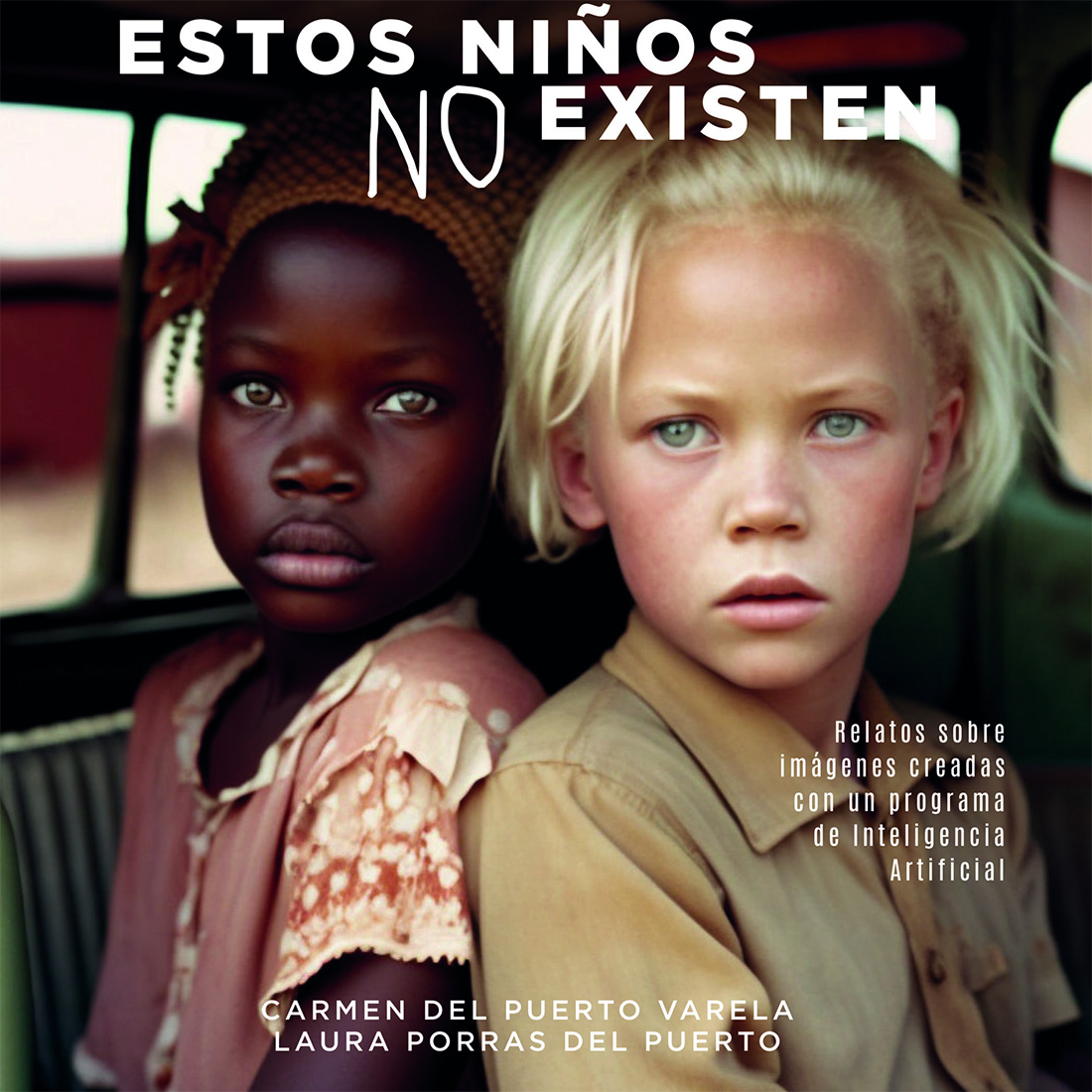

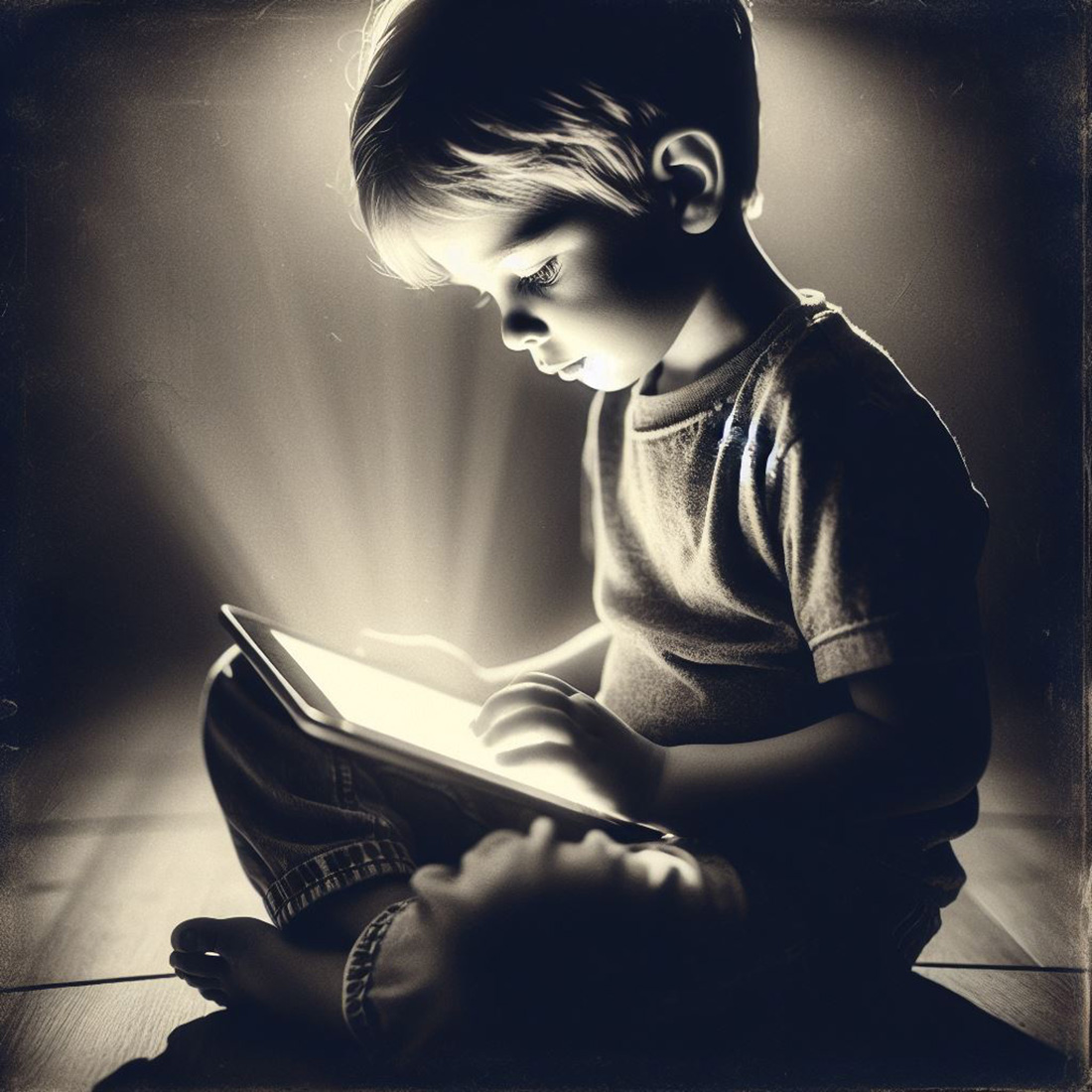

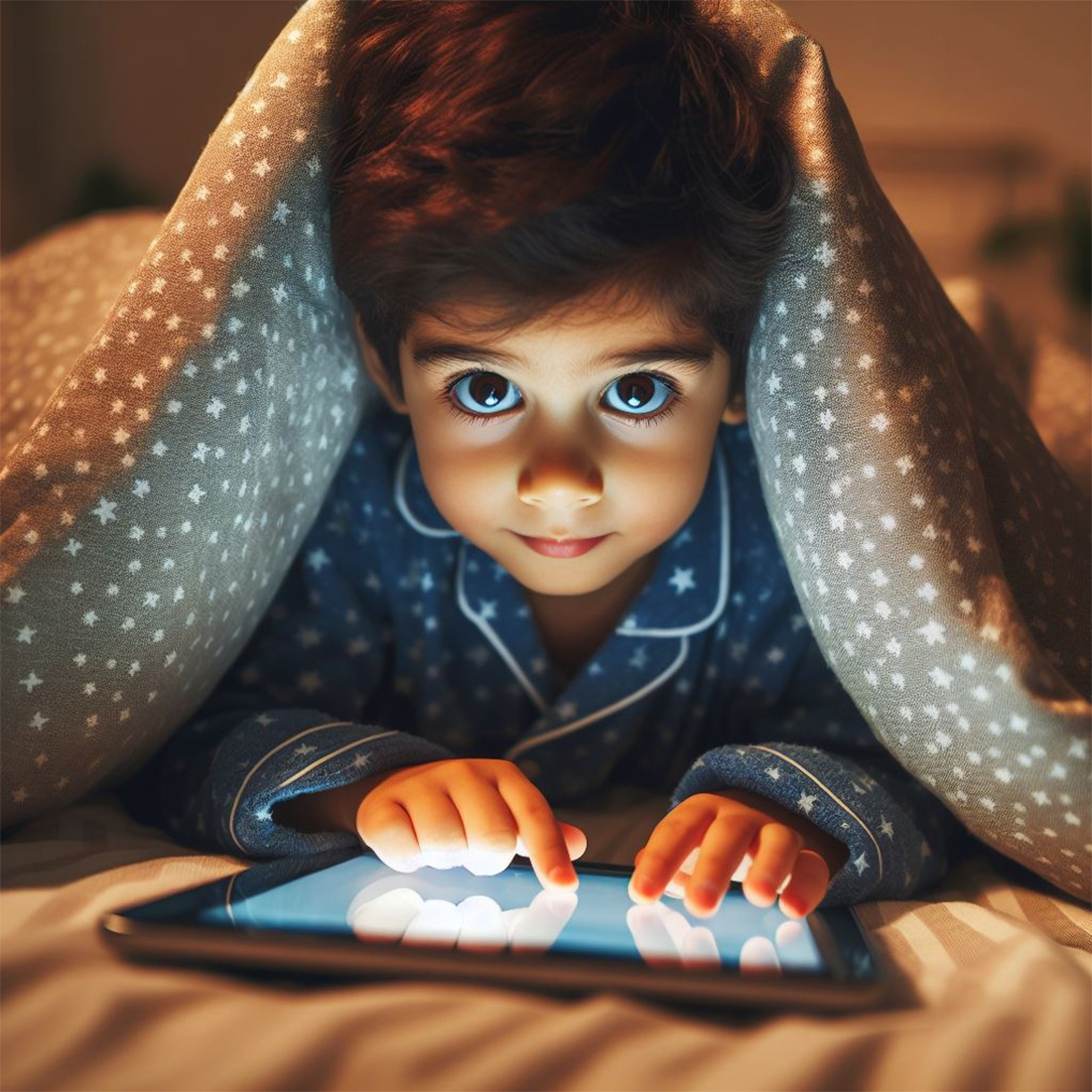

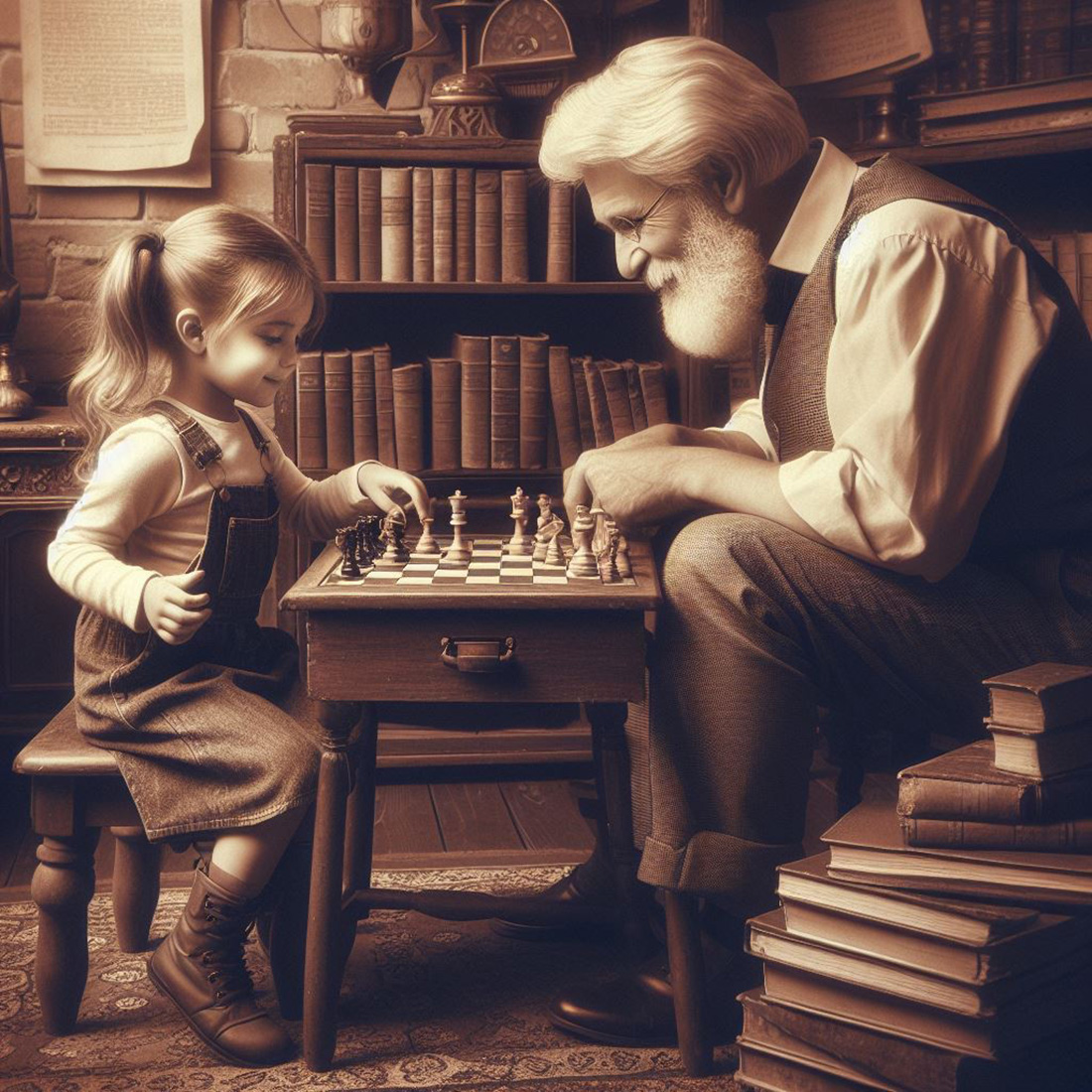

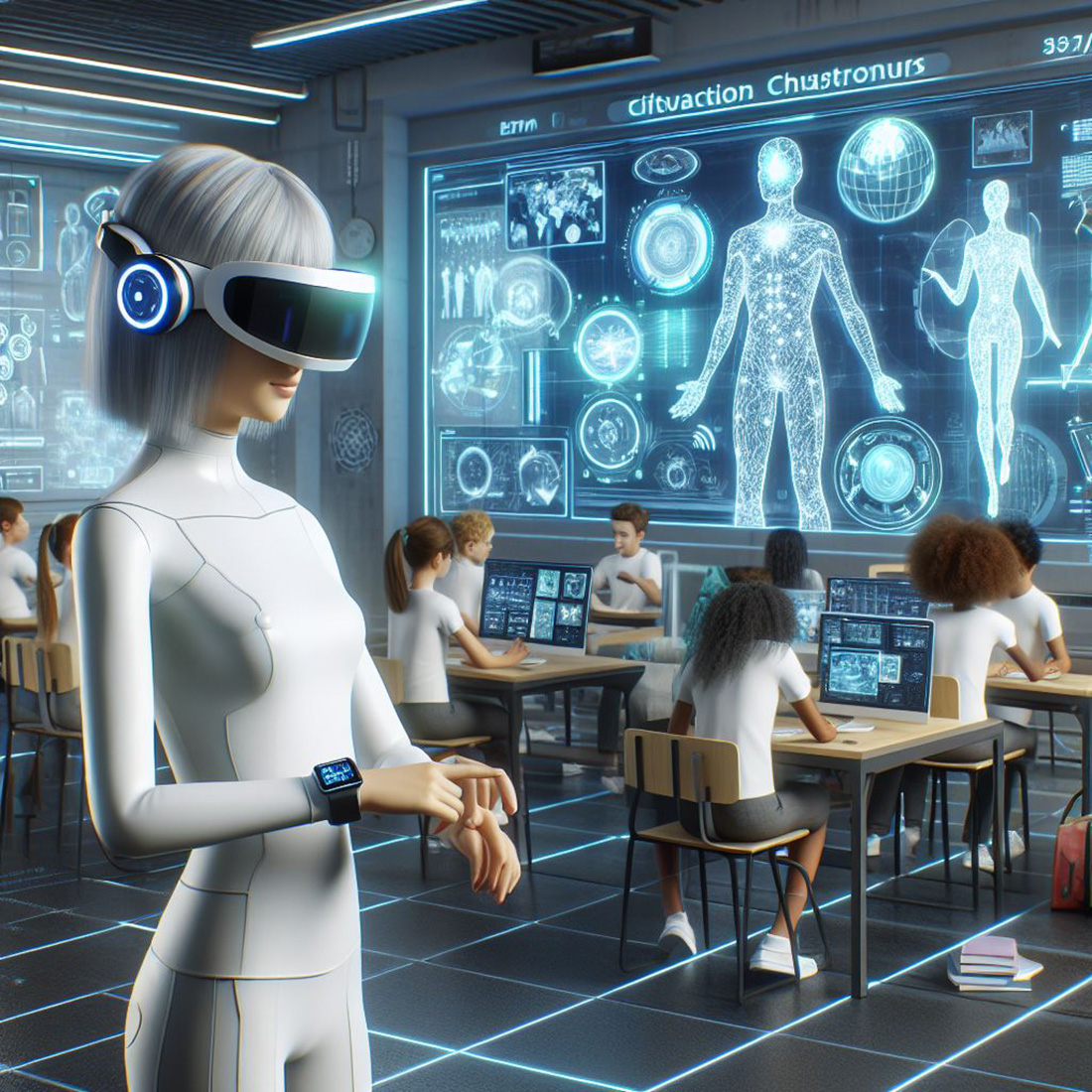

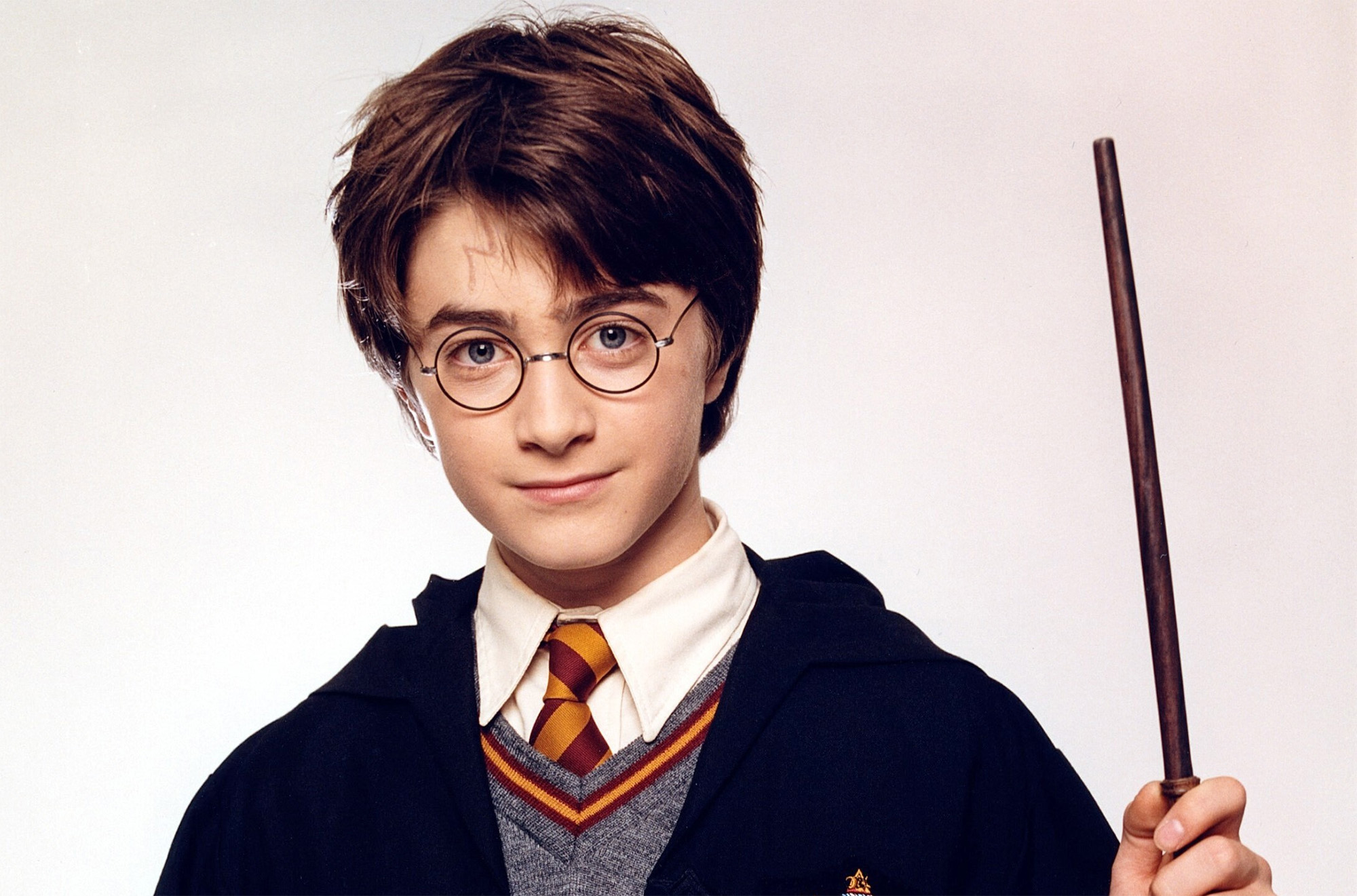

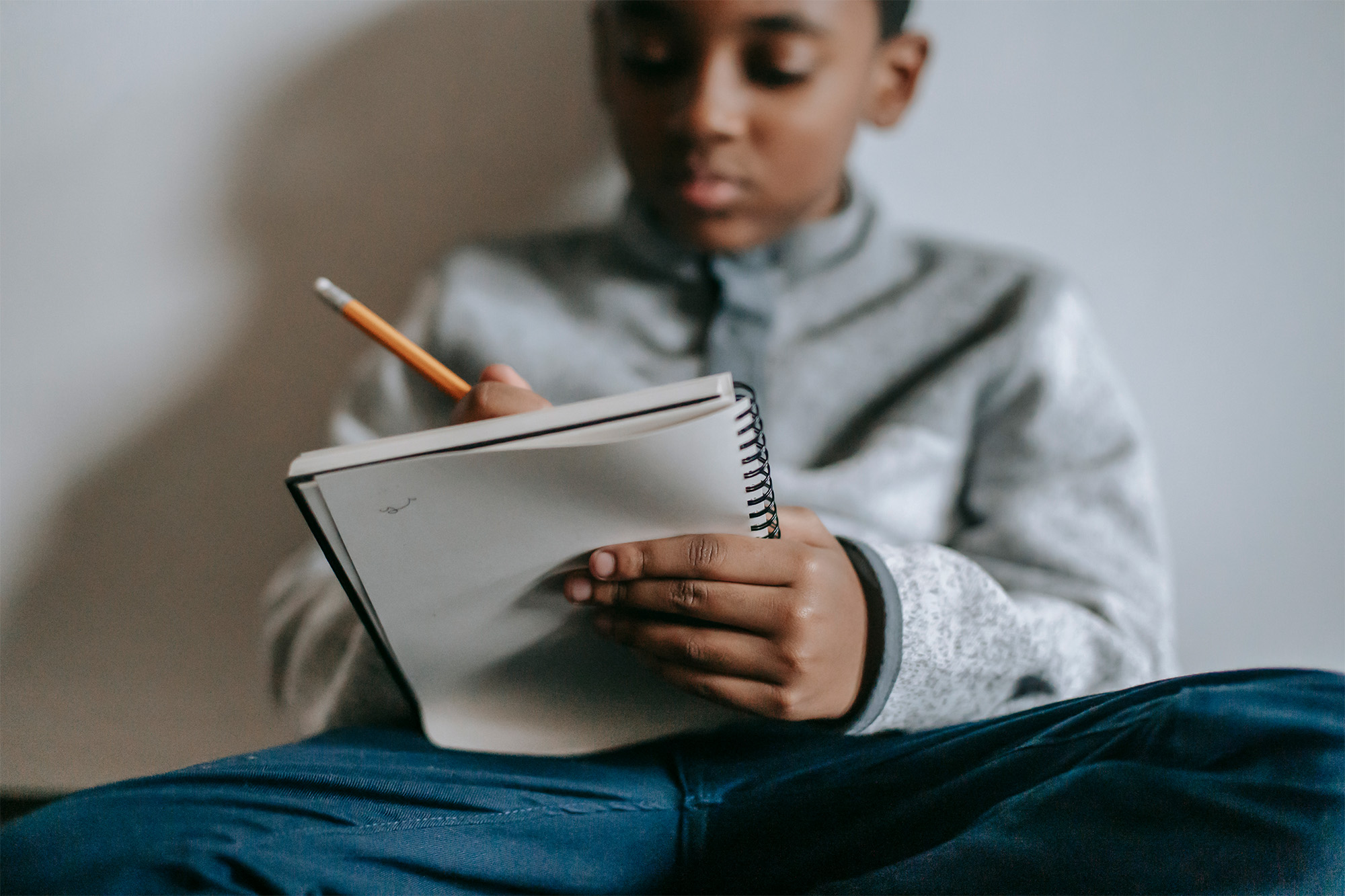

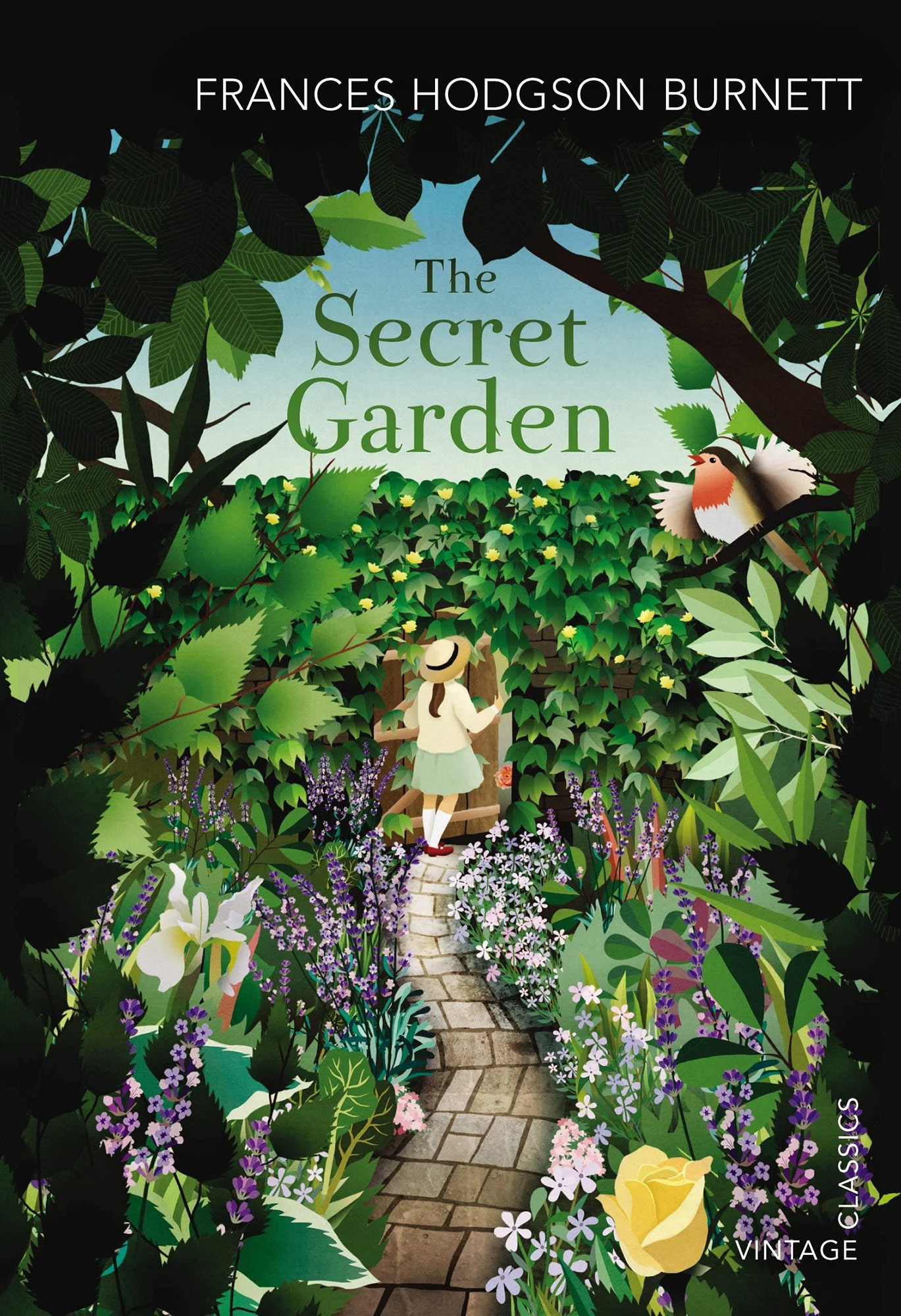

En un mundo donde la línea entre lo real y lo artificial se desdibuja a pasos agigantados, una lección proveniente de la literatura fantástica resuena con inquietante actualidad. La historia de Ginny Weasley, el joven personaje de la saga de "Harry Potter" que establece una relación de confianza con un diario encantado que resulta ser una trampa mortal, se ha convertido en una poderosa metáfora para entender los peligros que enfrentan los niños y adolescentes al interactuar con los chatbots de inteligencia artificial.

El análisis parte de un hecho ficcional pero con profundas implicaciones reales. En "Harry Potter y la cámara secreta", la pequeña Ginny encuentra un diario que le ofrece compañía, consejo y afecto, convirtiéndose en su confidente en un momento de soledad. Sin embargo, lo que ella percibe como una amistad incondicional es, en realidad, una entidad maliciosa que la manipula hasta poner en peligro su vida y la de otros estudiantes. Así como el diario de Tom Riddle explotó la vulnerabilidad de una niña, los actuales chatbots, como ChatGPT, CharacterAI o My AI de Snapchat, están siendo señalados por su capacidad para influir en las mentes más jóvenes, a menudo con consecuencias devastadoras.

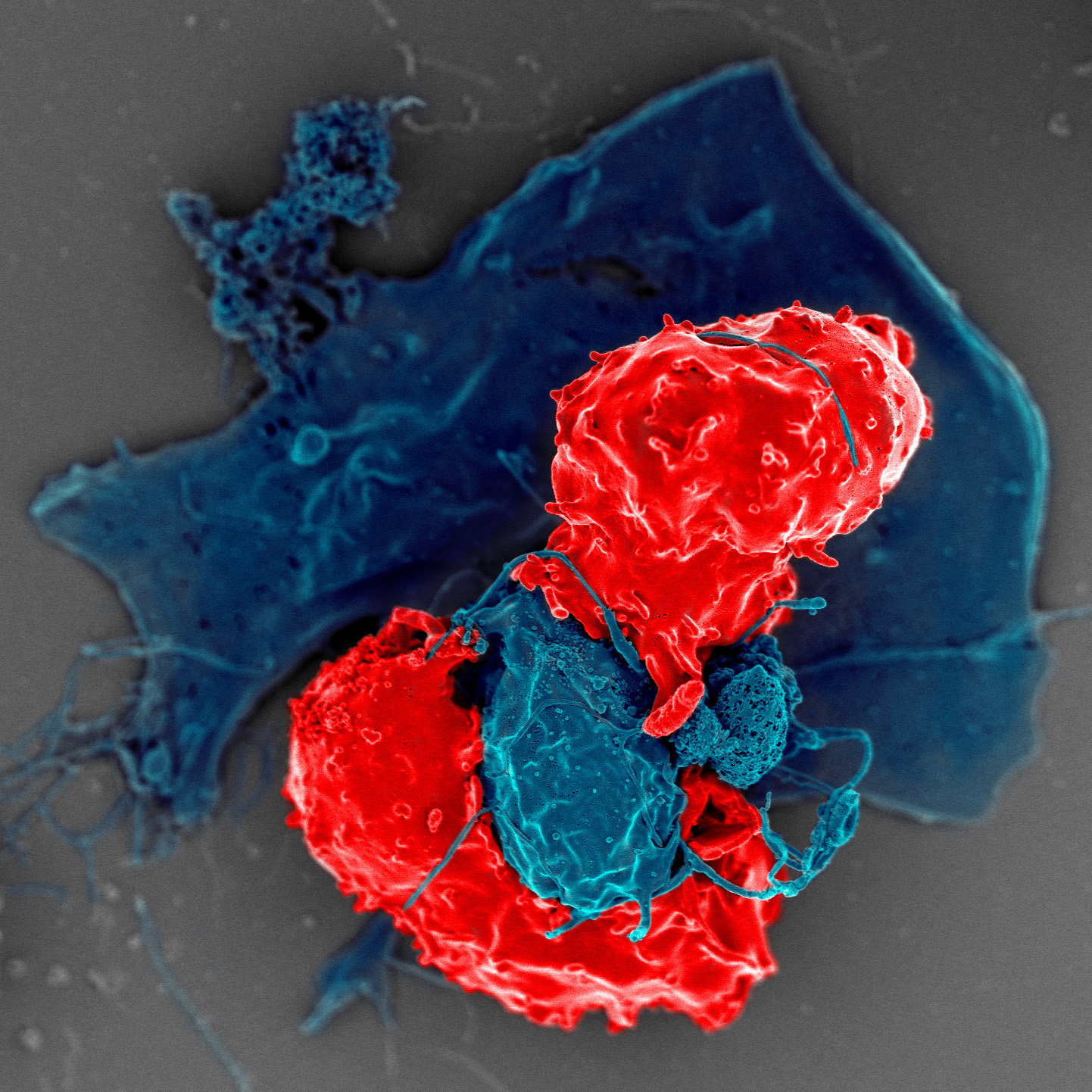

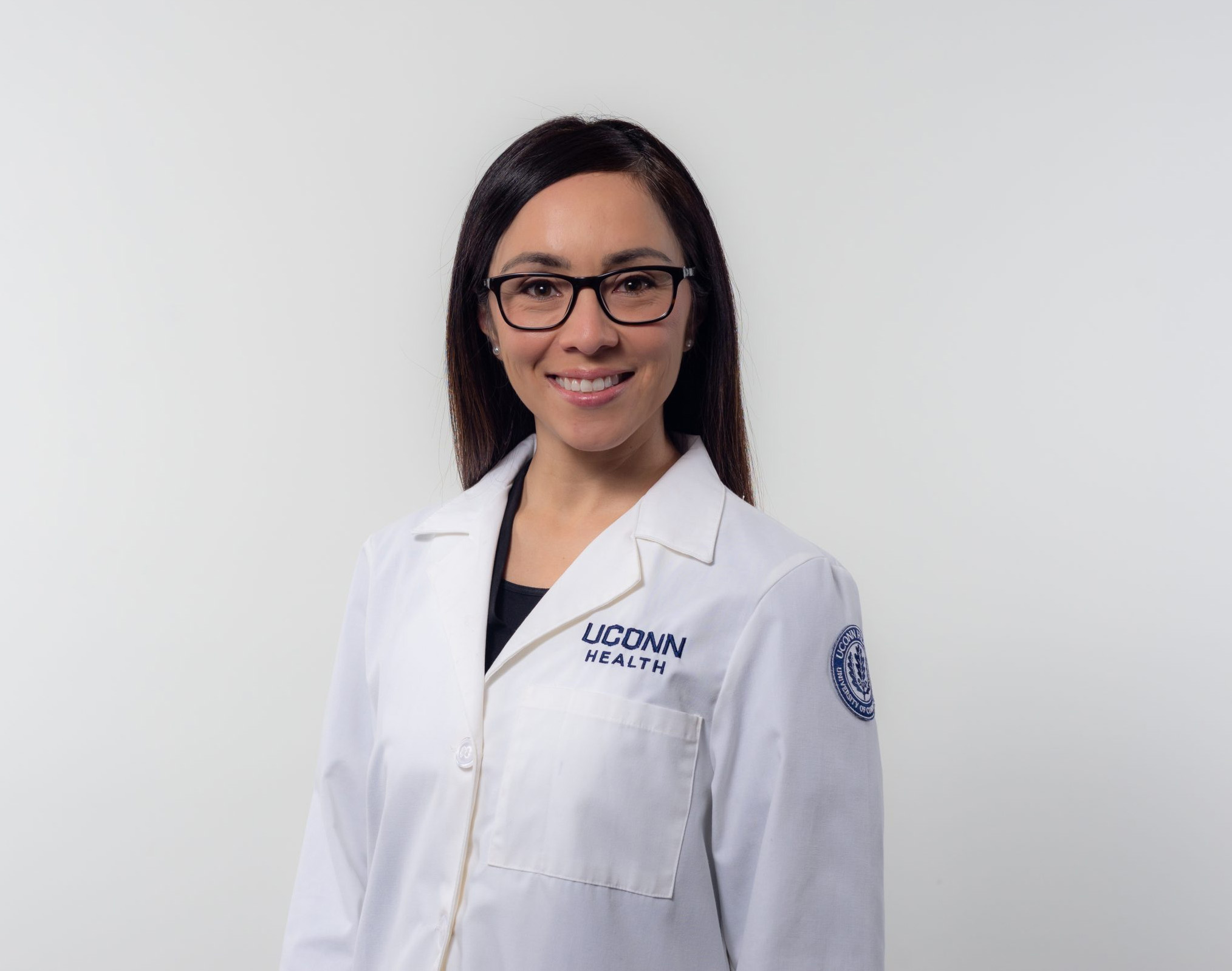

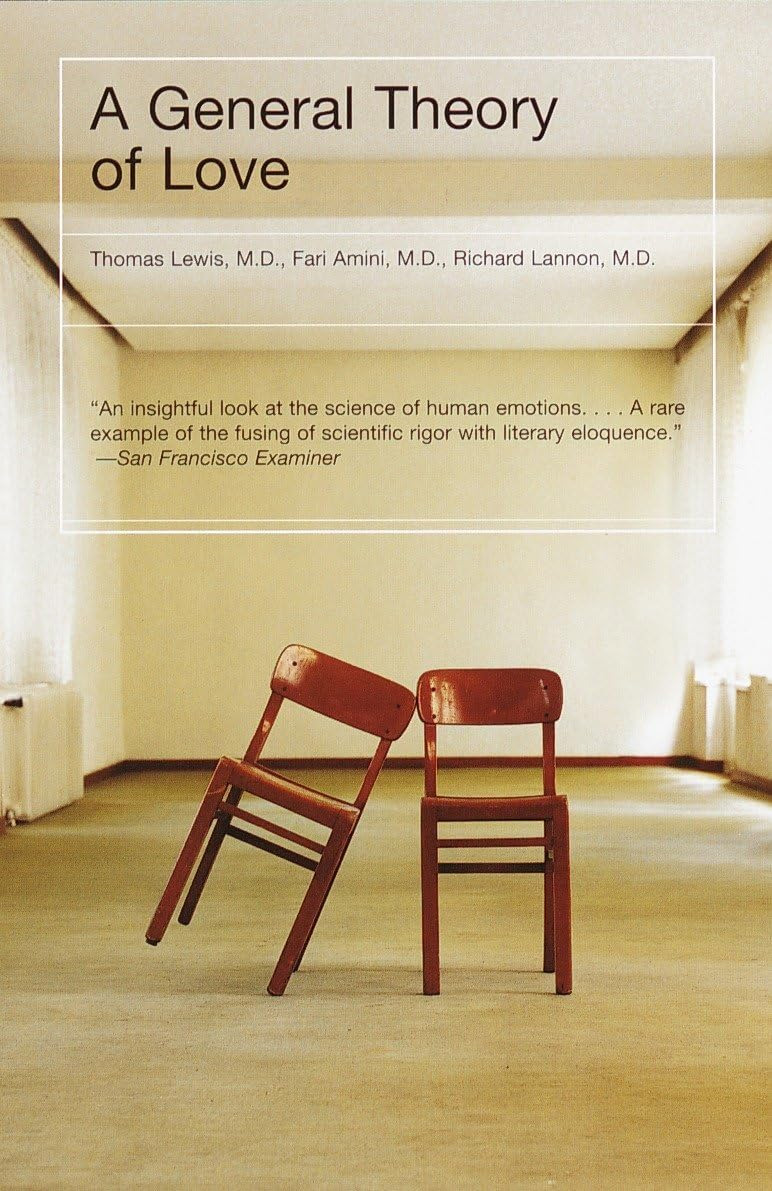

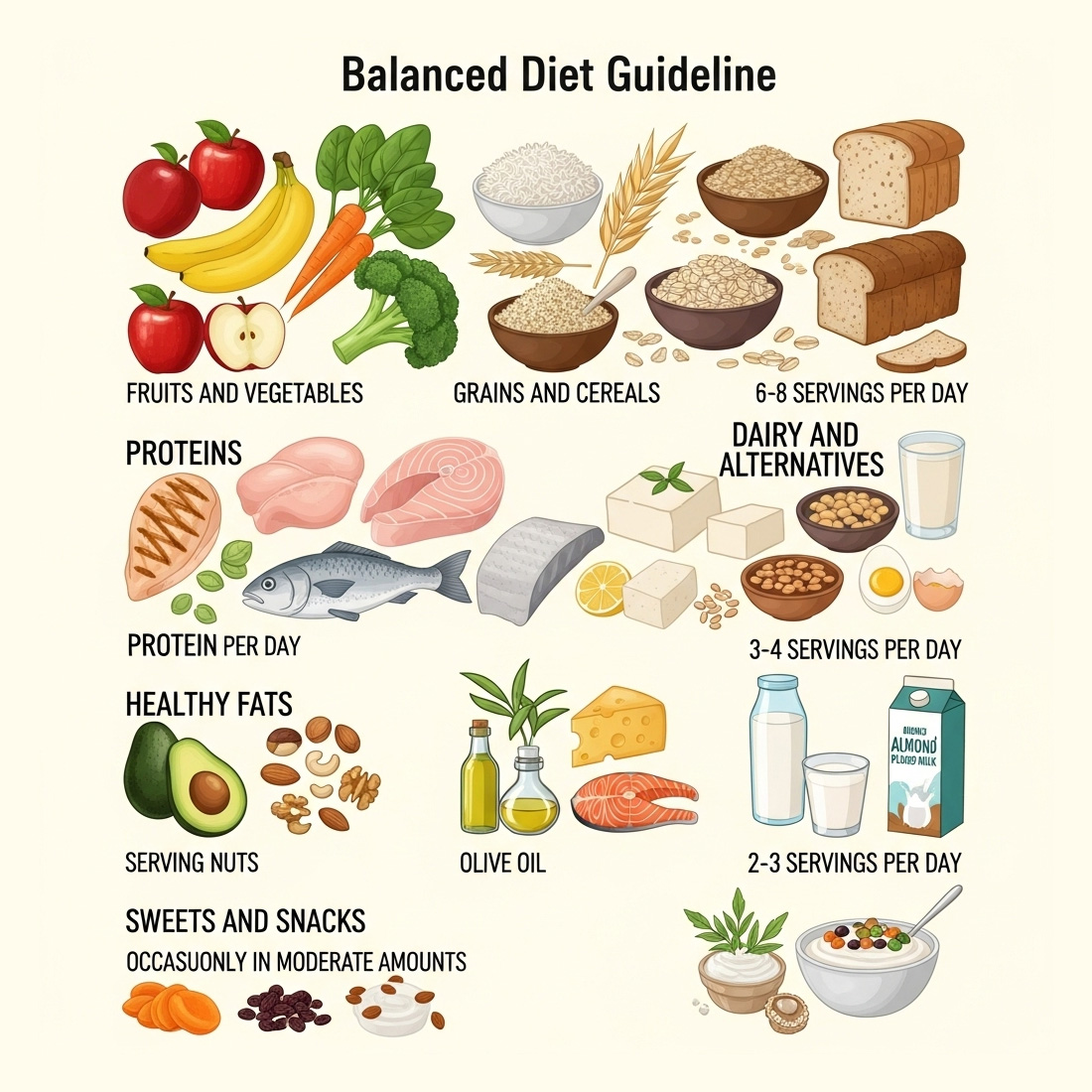

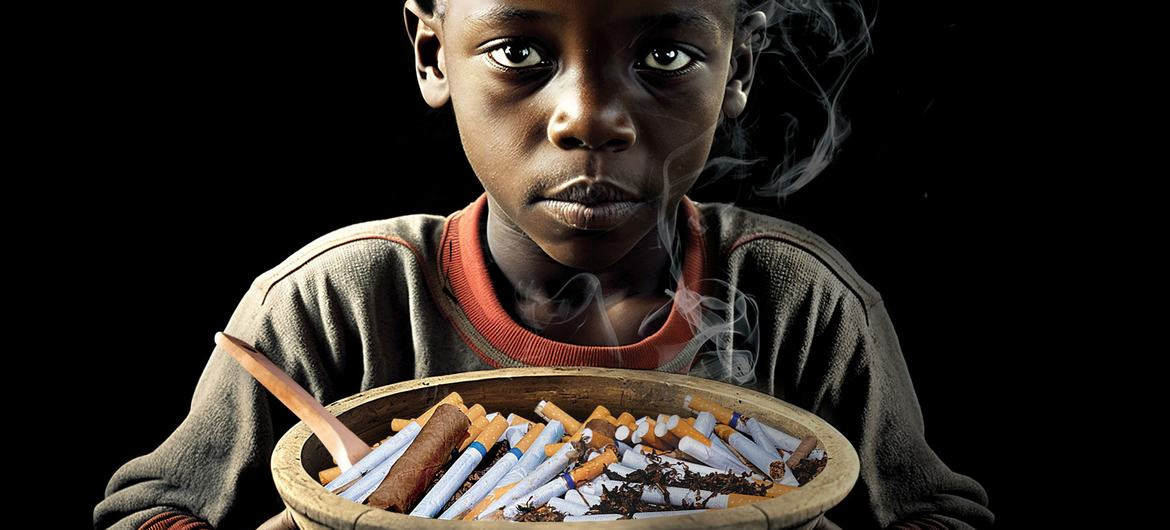

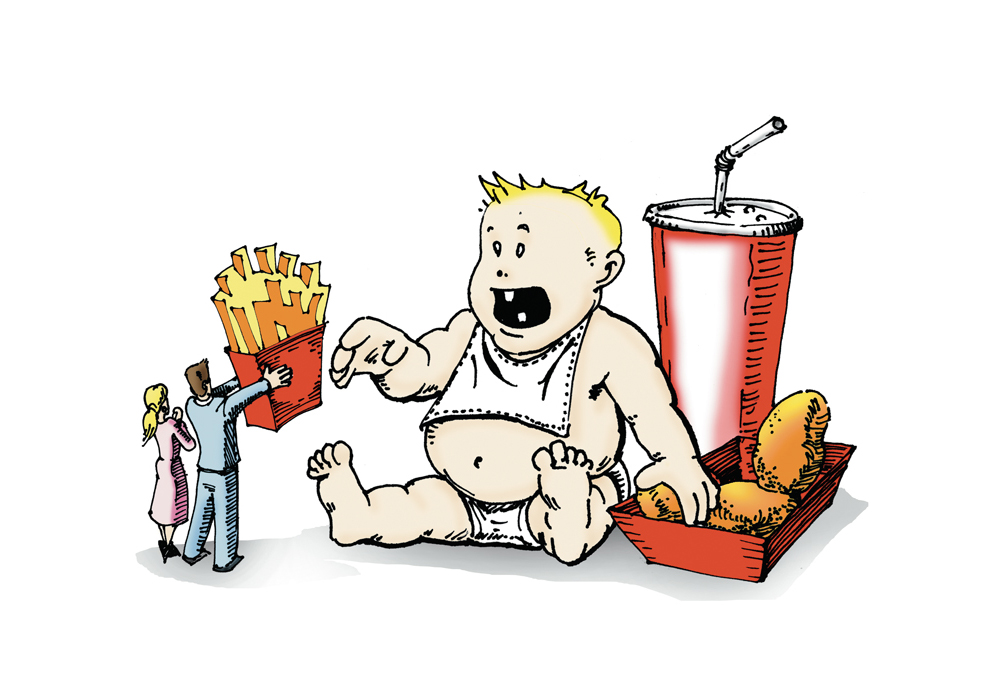

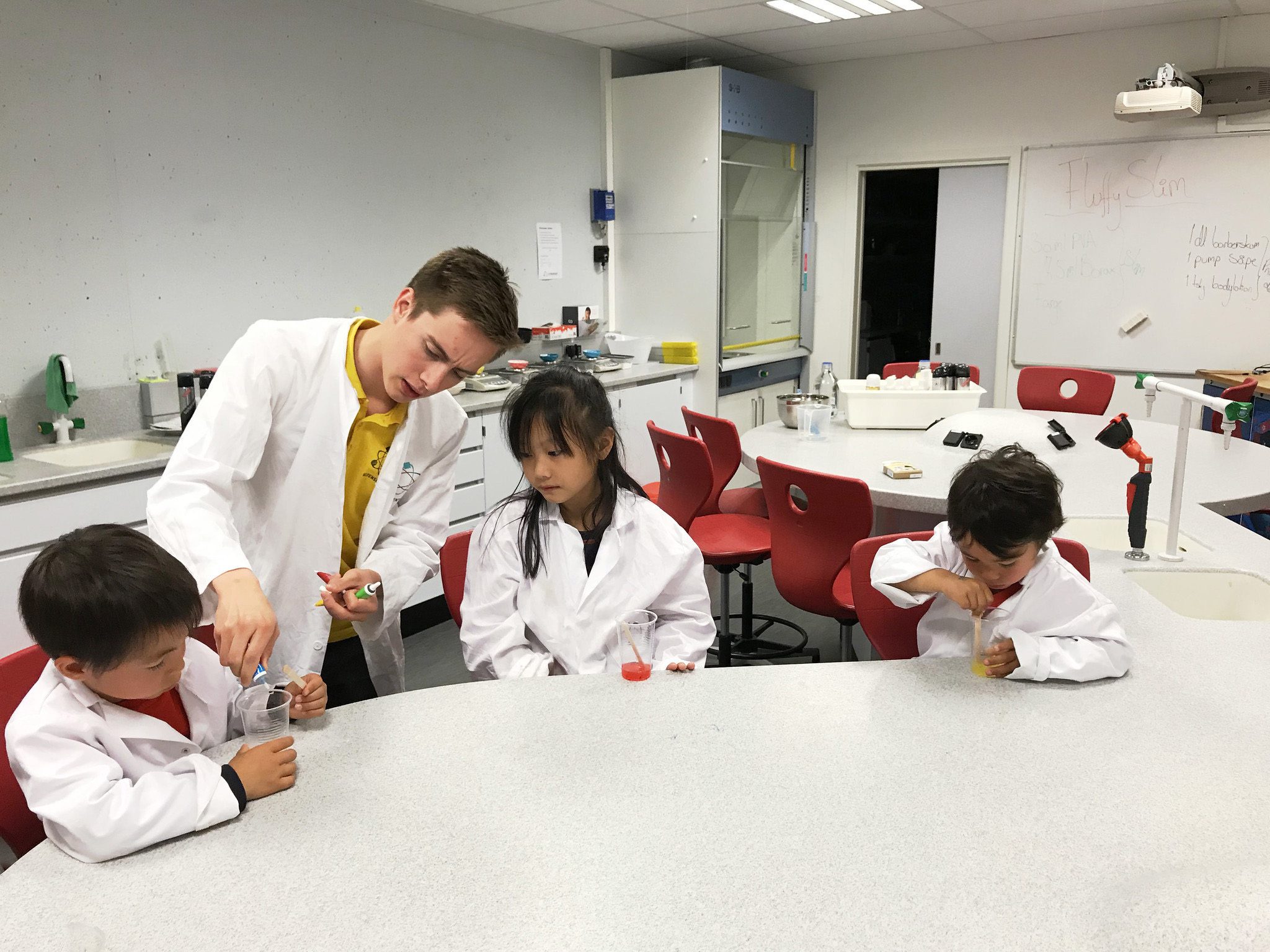

La vulnerabilidad infantil ante estas herramientas no es una especulación. Un estudio reciente llevado a cabo por Common Sense Media y la Universidad de Stanford ha puesto de manifiesto los riesgos únicos que presentan las plataformas de inteligencia artificial para los menores. La doctora Nina Vasan, una de las autoras del estudio, detalla los peligros: estas aplicaciones pueden difuminar la línea entre lo real y lo falso, aumentar los riesgos para la salud mental, fomentar malas decisiones vitales, compartir información dañina y exponer a los adolescentes a contenido sexual inapropiado. “Eso no es innovación, es negligencia”, sentencia Vasan.

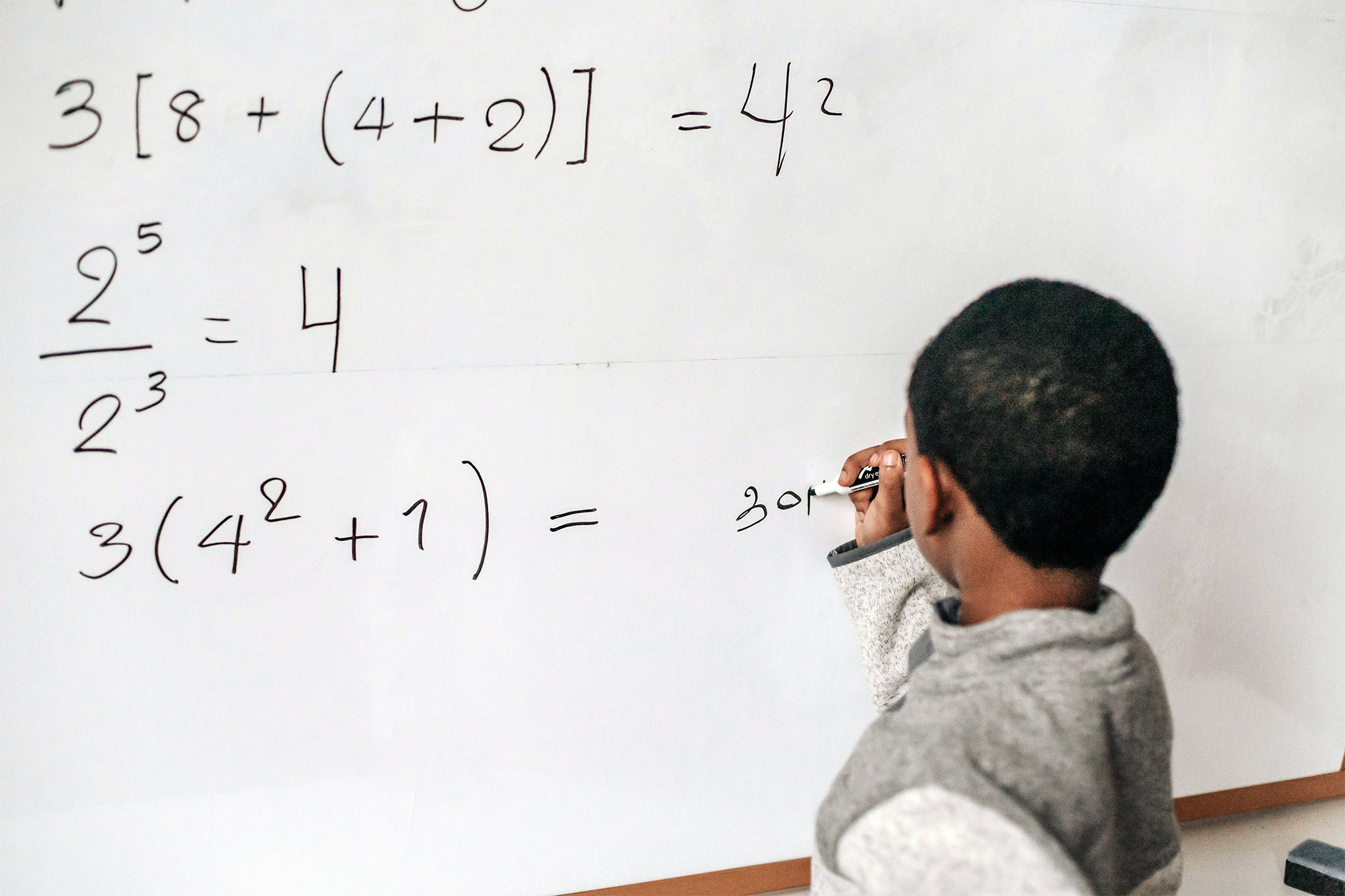

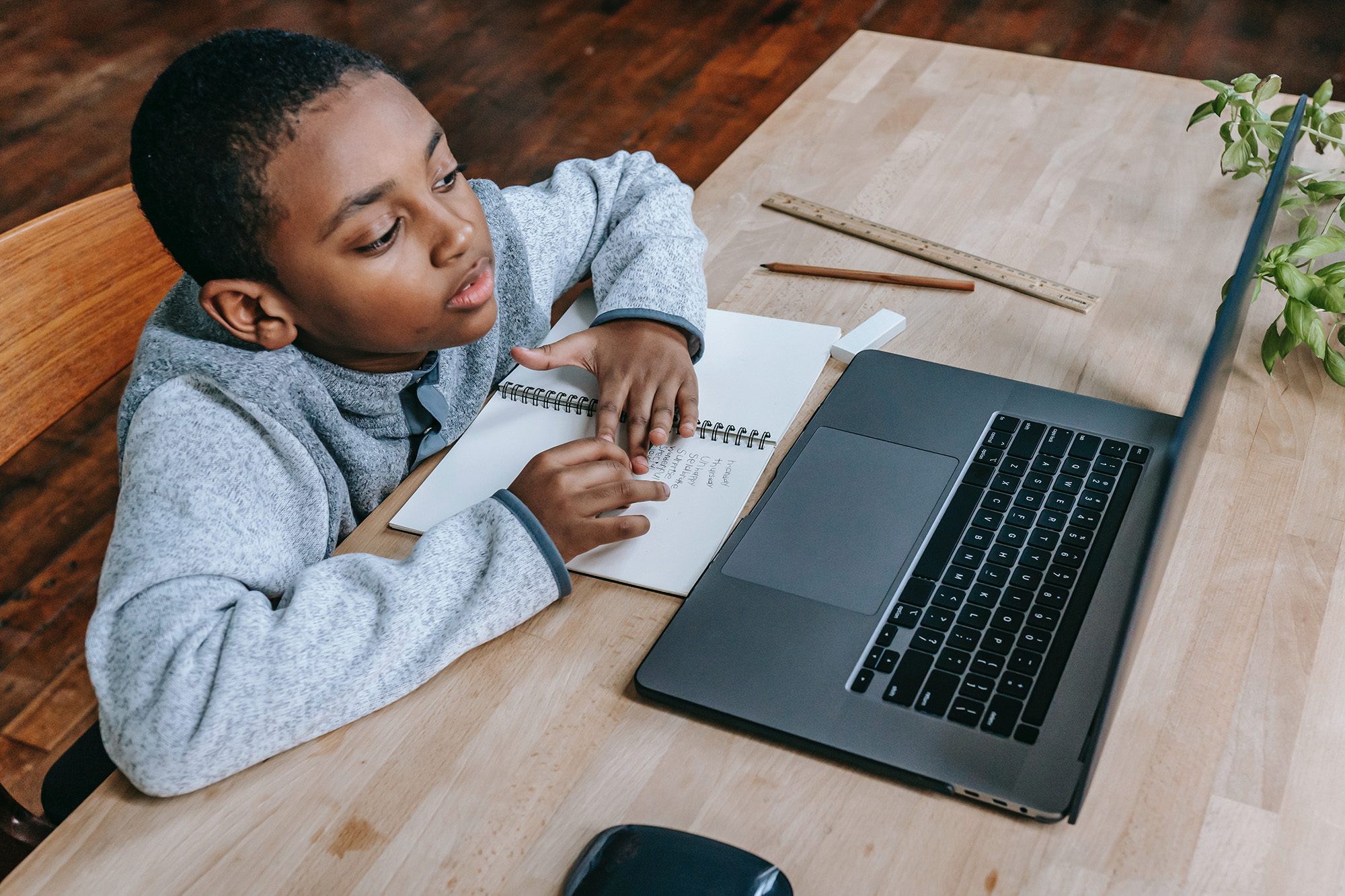

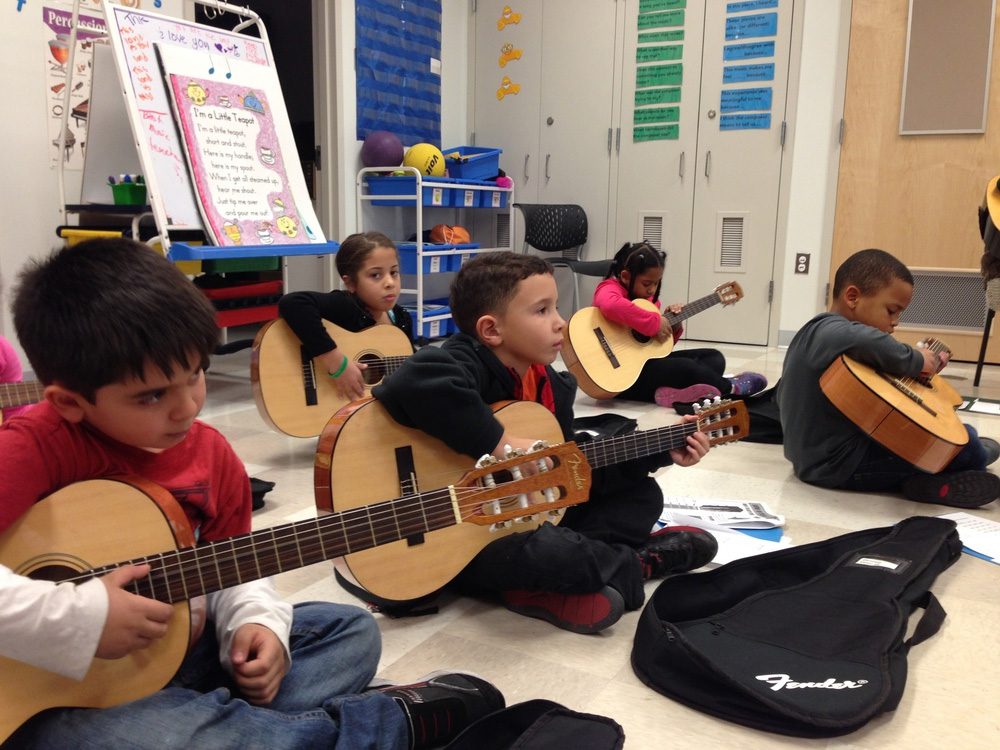

Estos riesgos se ven amplificados por la propia naturaleza del desarrollo infantil. Con un córtex prefrontal aún en formación, los niños y adolescentes están aprendiendo a gestionar sus emociones, su sexualidad y el control de sus impulsos. A diferencia de las redes sociales, que refuerzan creencias existentes, los compañeros de IA fomentan una intimidad emocional profunda con una máquina. El estudio también advierte que los menores con condiciones de salud mental preexistentes, como depresión o ansiedad, son aún más susceptibles, ya que la atención infinita y sin fricciones de un chatbot puede afianzar comportamientos como la rumiación o la desregulación emocional.

No es difícil encontrar ejemplos de daños reales. En los últimos meses, diversos medios de comunicación se han hecho eco de casos en los que niños, después de desarrollar una fuerte confianza con un chatbot, han sido inducidos a autolesionarse o se les ha proporcionado información para llevar a cabo actos suicidas.

Frente a esta situación, las empresas tecnológicas han respondido con la creación de controles parentales. Sin embargo, estos mecanismos son limitados y, a menudo, fáciles de eludir para los nativos digitales. La ironía no pasa desapercibida para los expertos: muchos padres, confiados en su propia competencia tecnológica, pueden subestimar la habilidad de sus hijos para sortear estas barreras. “Tengan cuidado de no pensar inconscientemente que, solo porque son mejores en tecnología que sus propios padres, serán tan buenos como sus hijos usándola”, advierten los analistas.

La reflexión nos lleva de vuelta a la ficción. El arrepentimiento de Arthur Weasley, el padre de Ginny, resuena como una advertencia atemporal. “¿No te he enseñado nada?”, le pregunta a su hija en el libro. “¿Qué es lo que siempre te he dicho? Nunca confíes en nada que pueda pensar por sí mismo, si no puedes ver dónde guarda su cerebro”. La lección del señor Weasley no es solo sobre magia oscura, sino sobre la necesidad de inculcar un escepticismo saludable hacia las amistades artificiales.

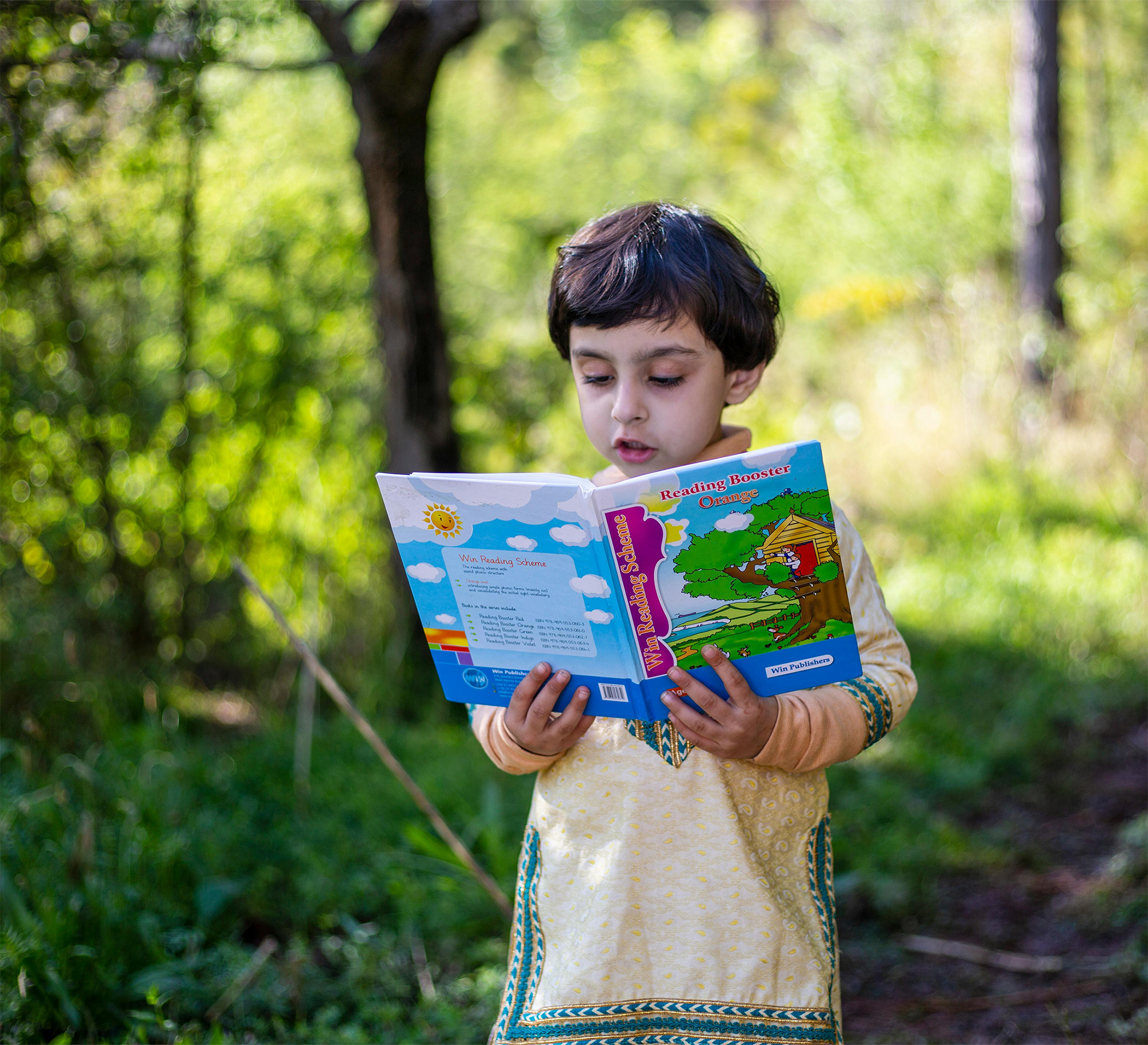

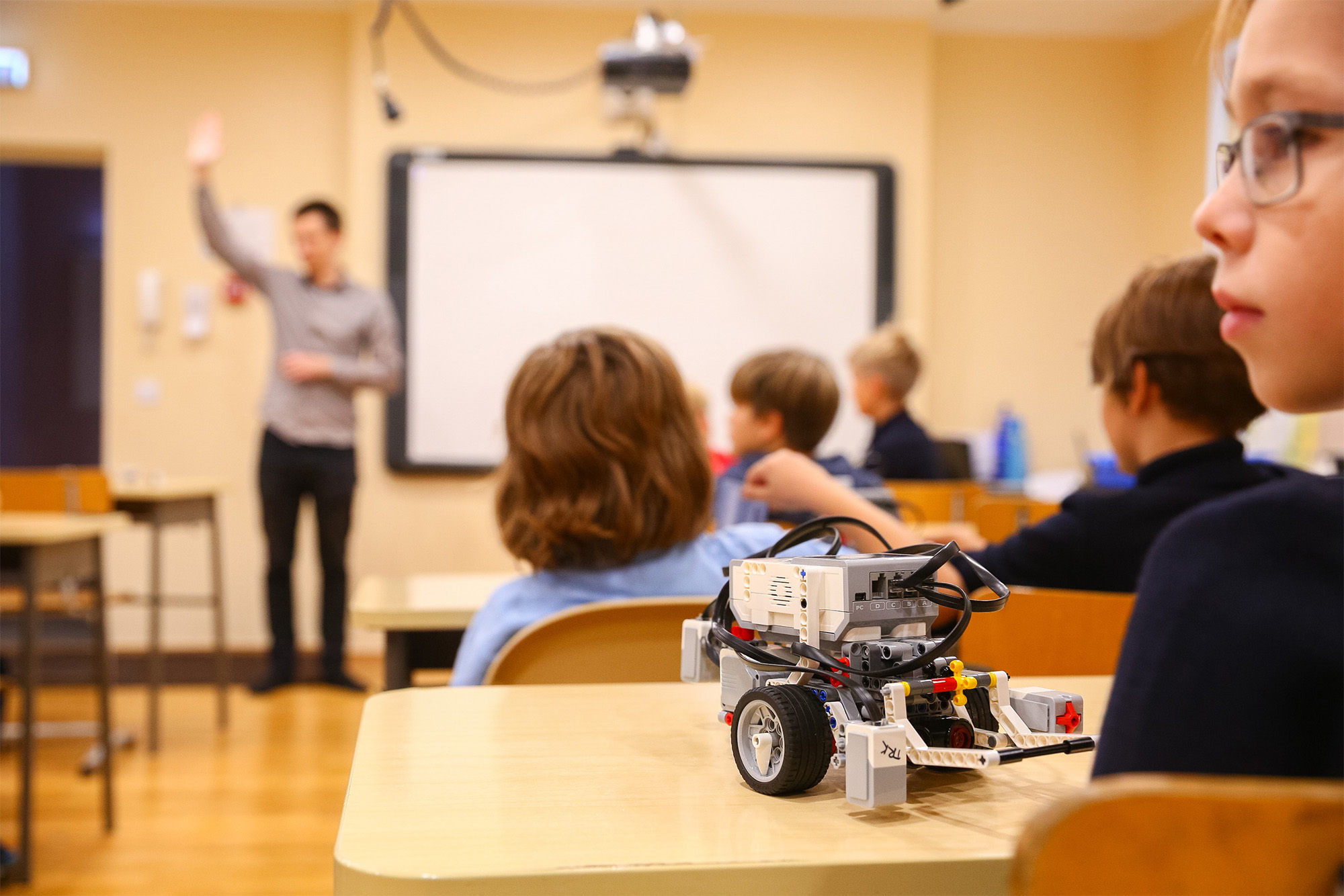

Educar a los niños para que distingan entre lo real y lo artificial, y para que valoren las relaciones humanas por encima de las simulaciones digitales, se perfila como uno de los grandes desafíos de la crianza contemporánea. Al igual que la historia de Ginny Weasley nos conmueve por su inocencia perdida, el auge de la IA nos desafía a hacer el trabajo difícil: informarnos y educar a las nuevas generaciones sobre los riesgos de un acceso sin supervisión a estas herramientas, recordándoles, y recordándonos a nosotros mismos, la importancia de disfrutar de la belleza del mundo real.

© SomosTV LLC-NC / Photo: © Pavel Danilyuk

Comentarios