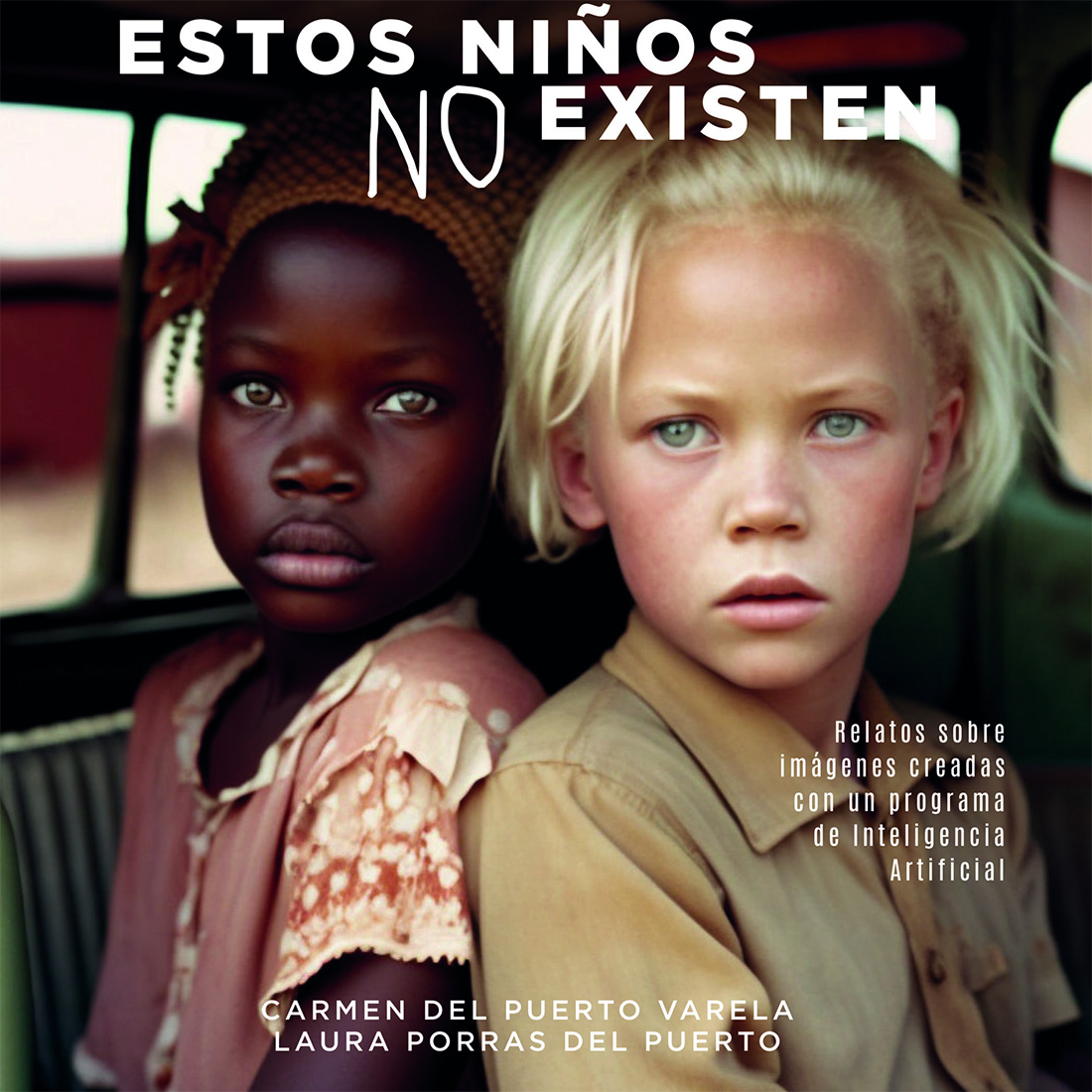

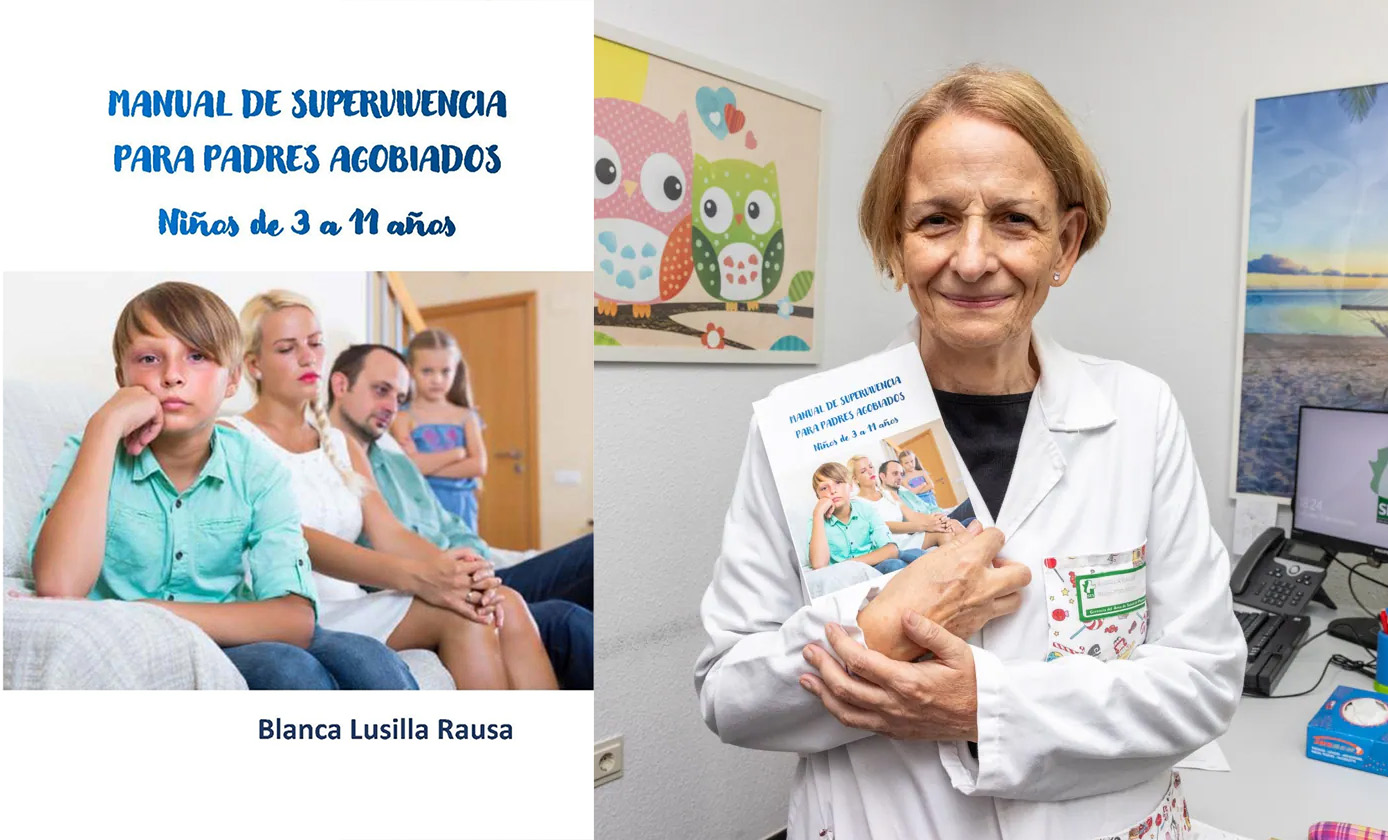

Una guía práctica para que los padres enseñen a sus hijos a convivir con la inteligencia artificial

publisher

mcora

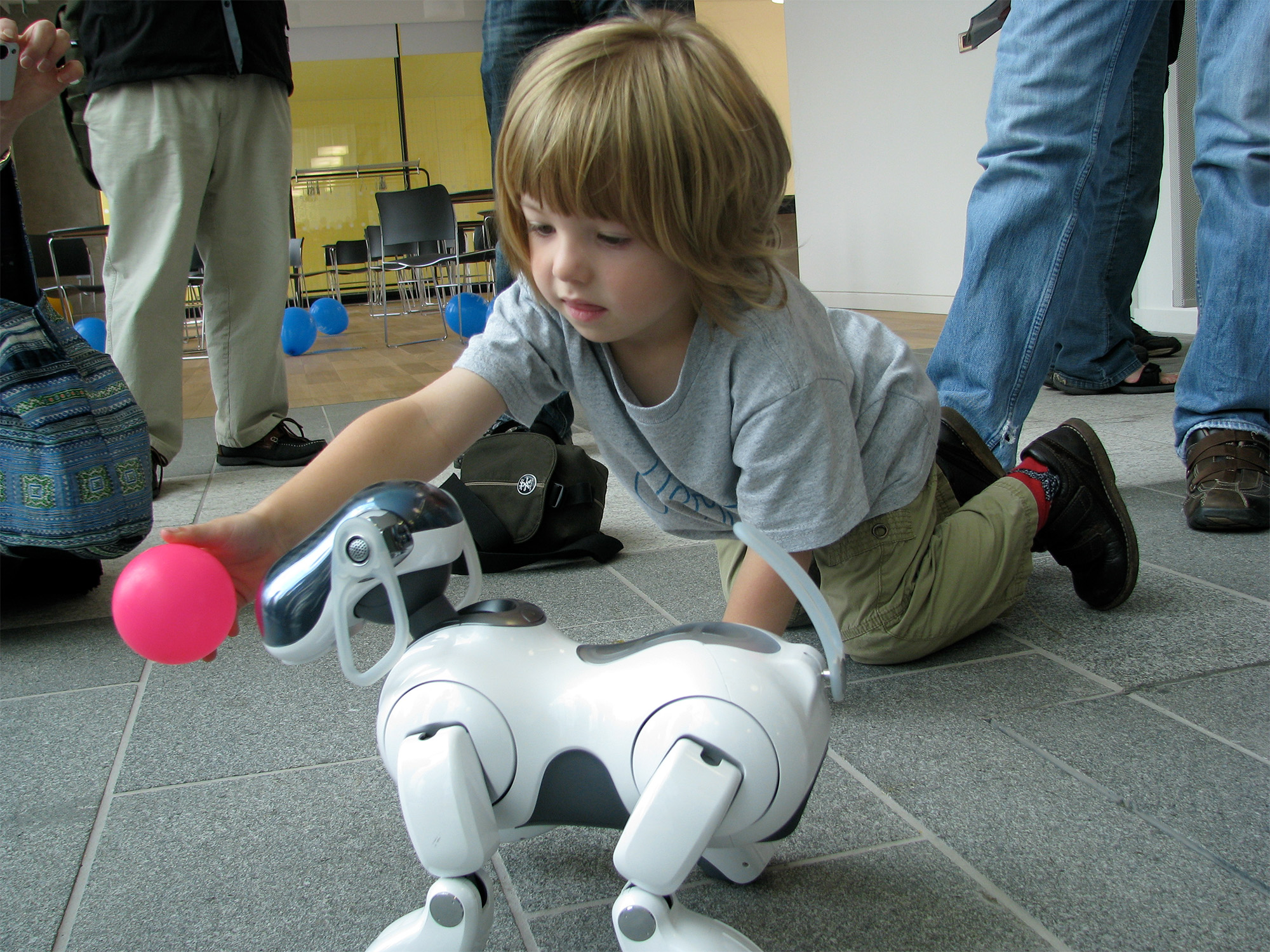

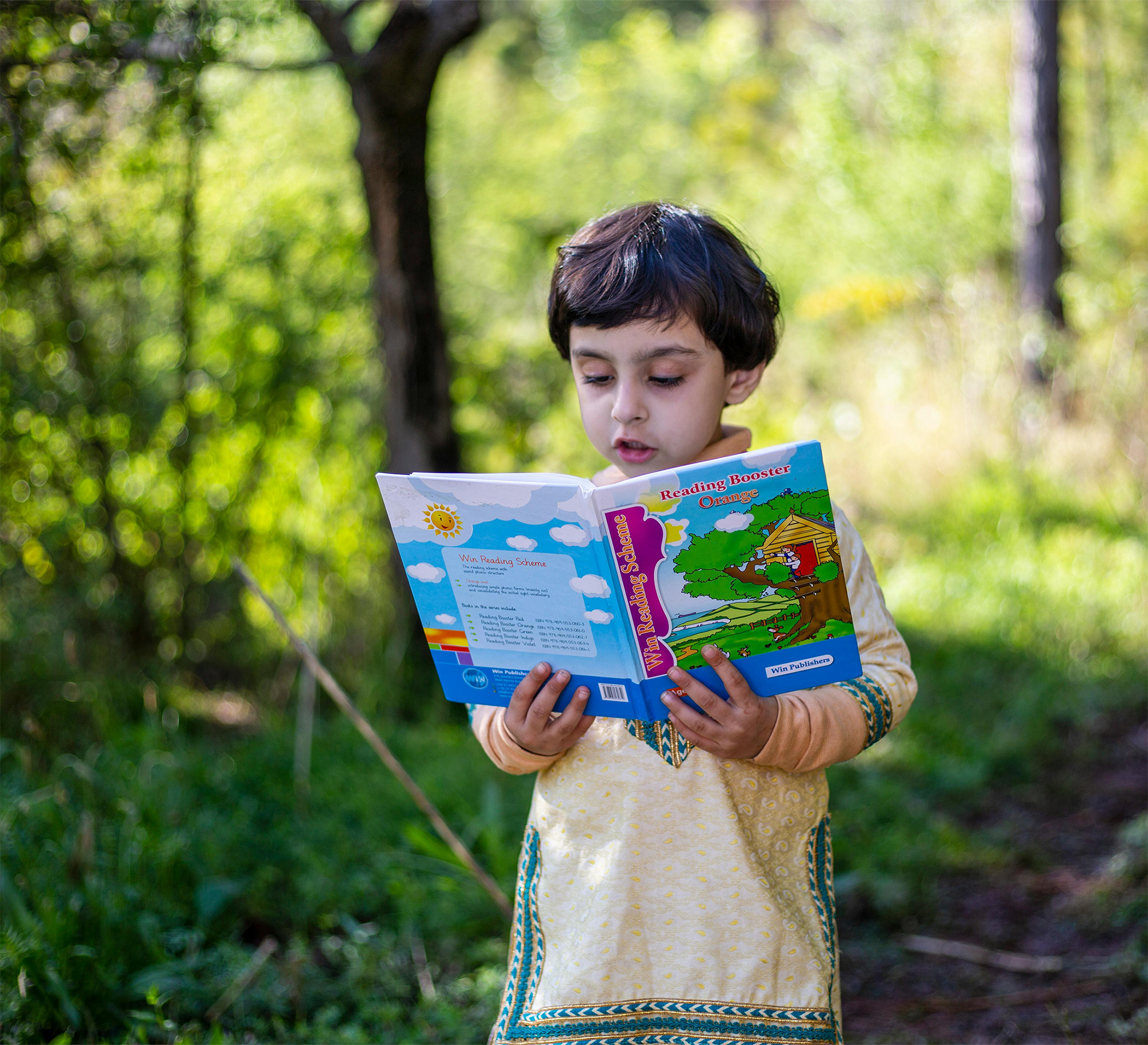

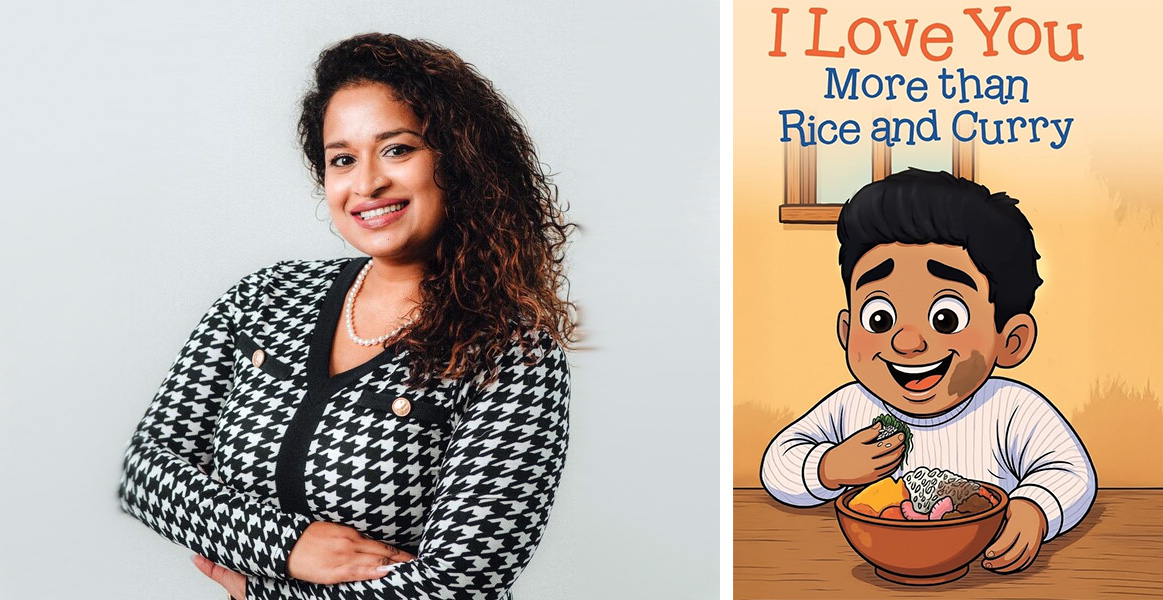

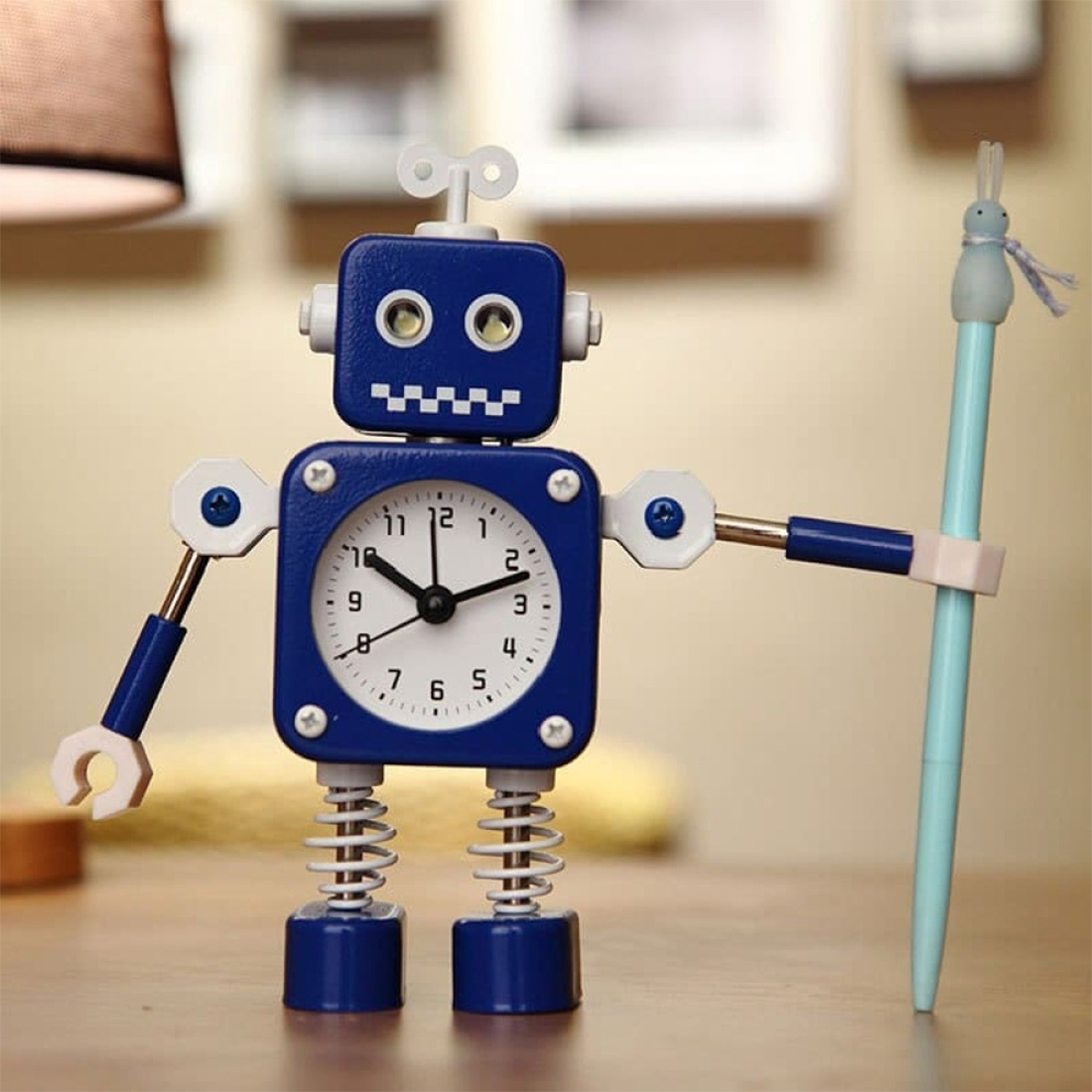

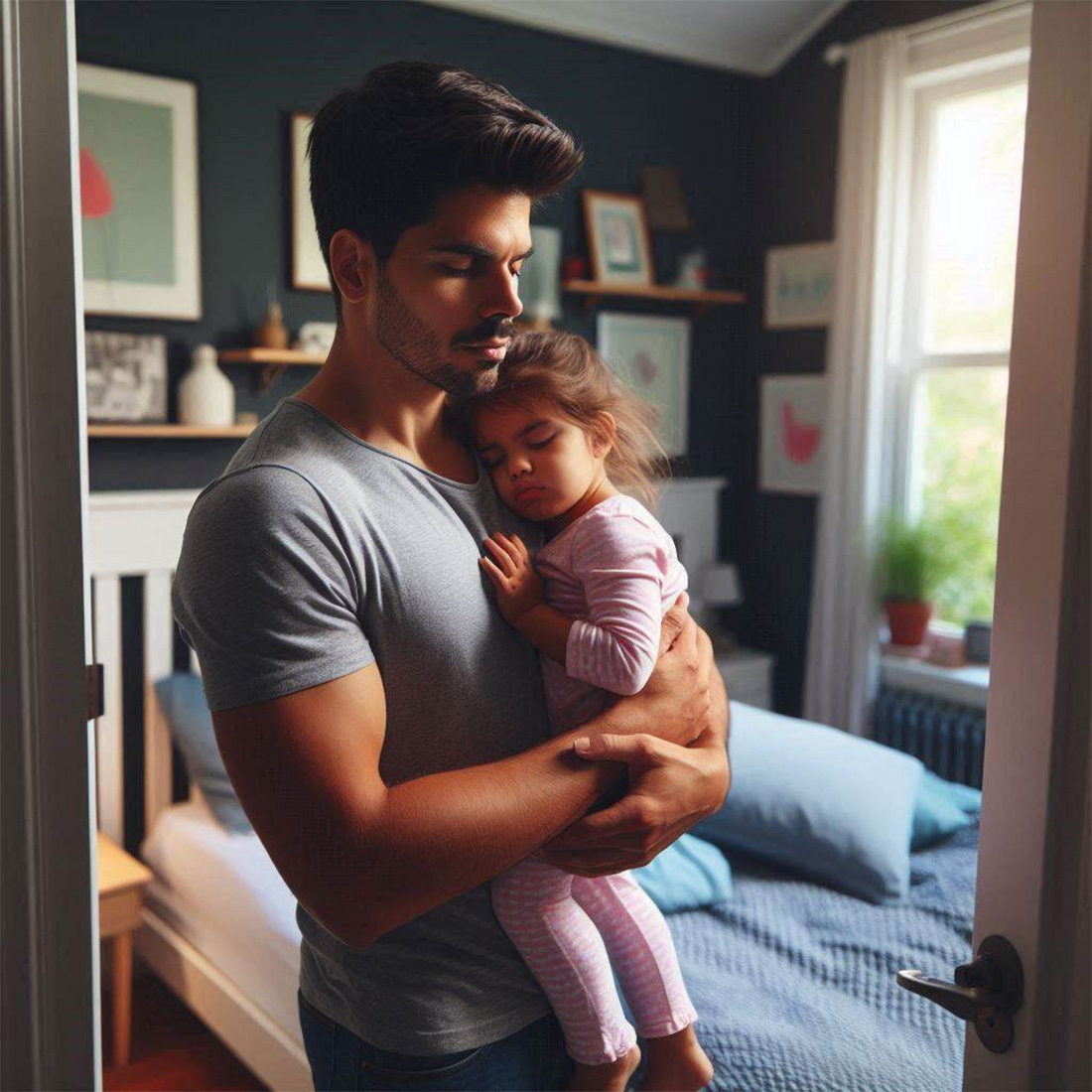

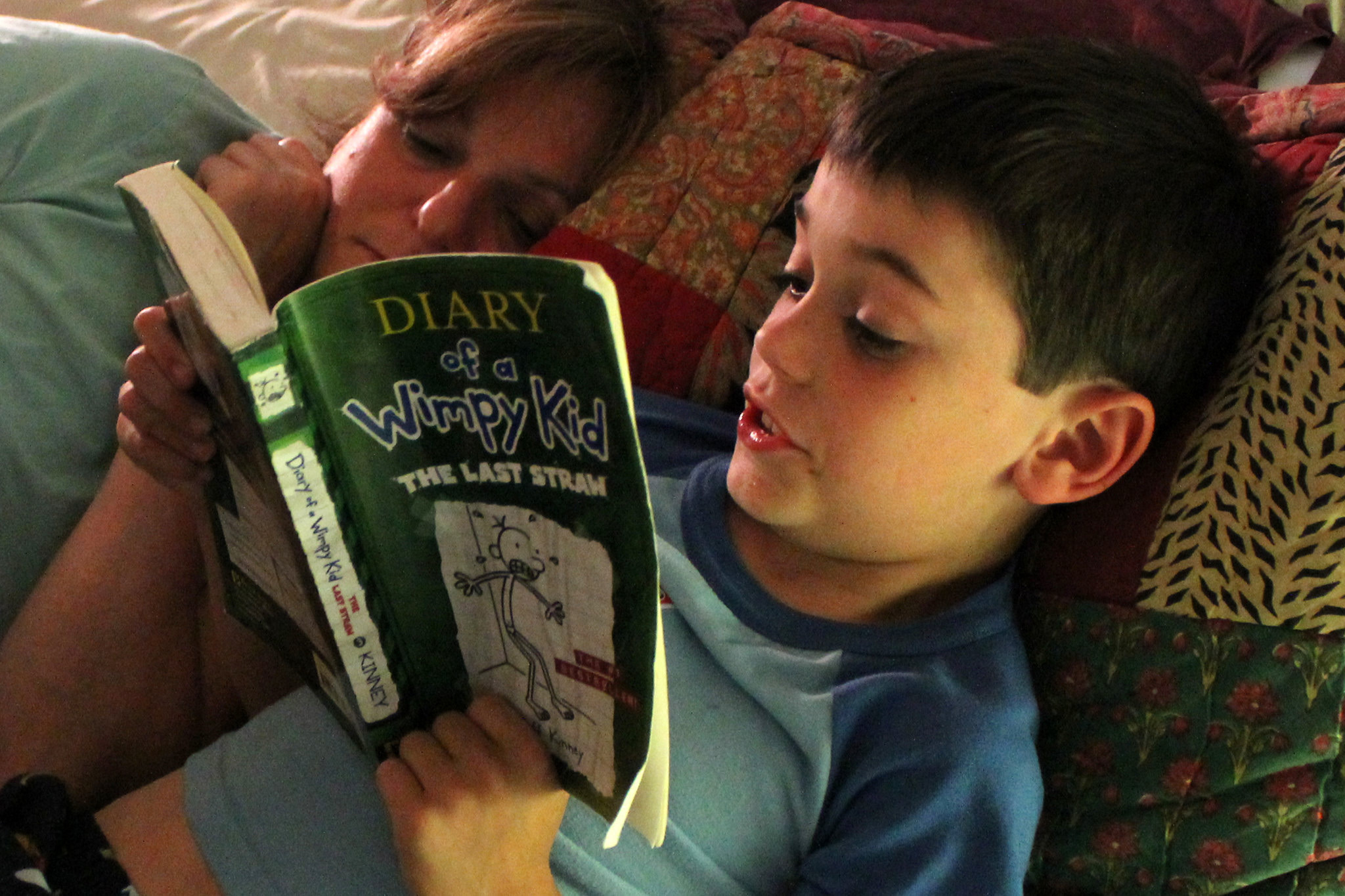

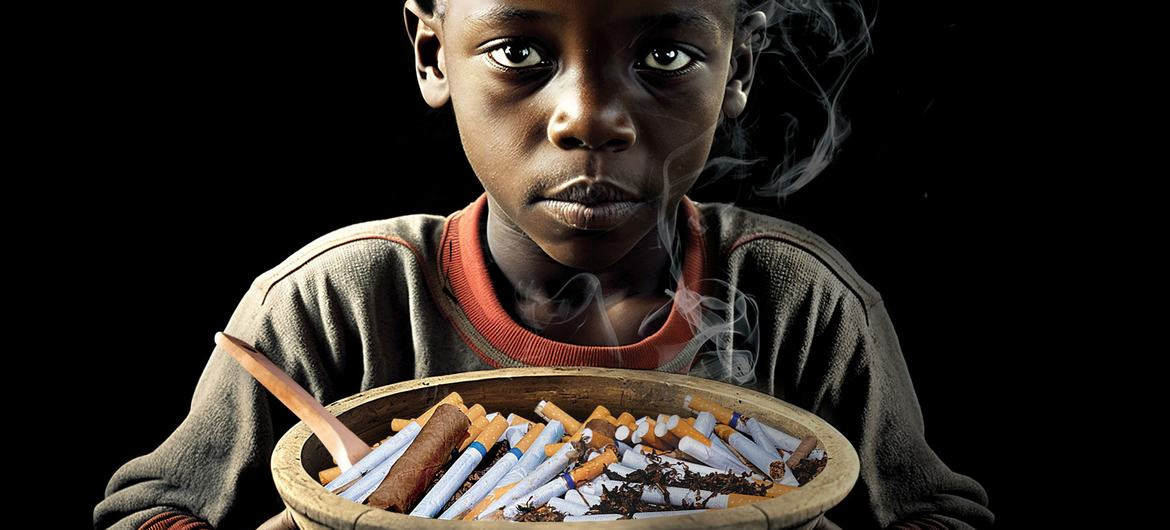

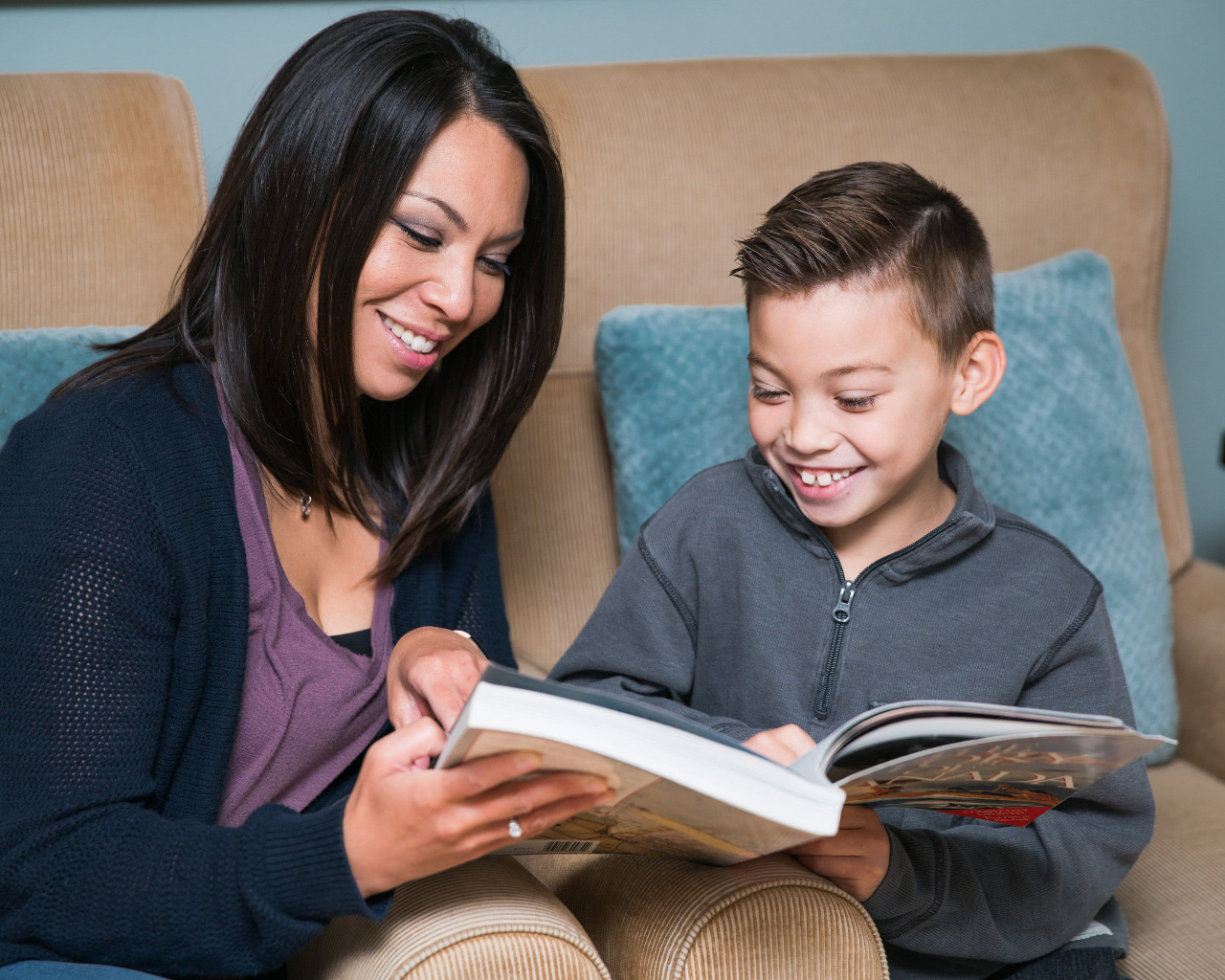

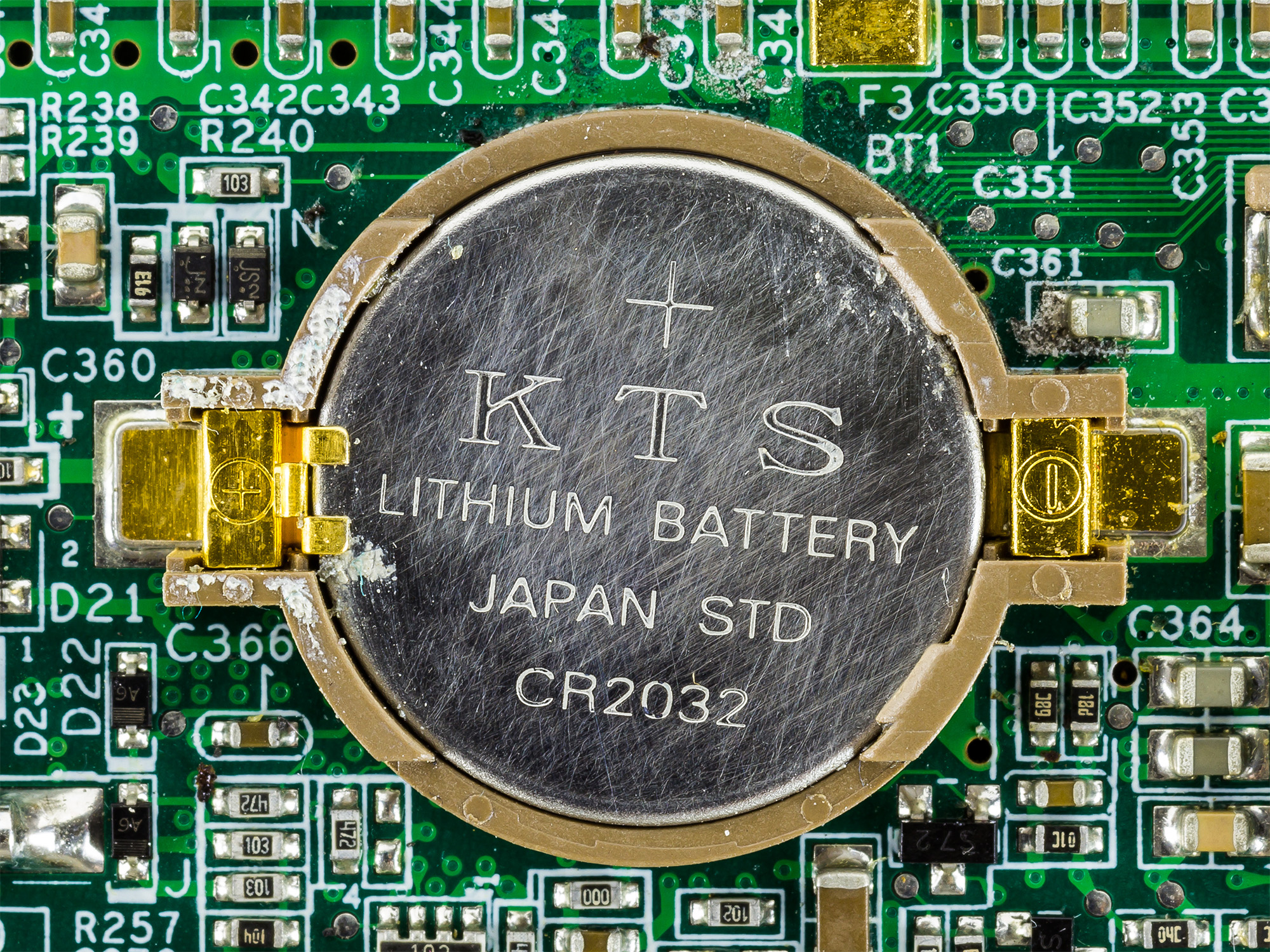

Cuando la batería del robot que leía cuentos se agotó, Ethan, de nueve años, perdió el control por completo. El niño, que vive con su familia en las afueras de Toronto, se dejó caer de rodillas y empezó a llorar. "¡Está muerto!", le gritó a su madre. "¡Lo matamos!" Sabía, en algún nivel, que el dispositivo era una máquina. Pero el robot le leía todas las noches, respondía a su voz y recordaba sus historias favoritas. El aparato se había convertido, en la mente de Ethan, en un miembro de la familia, leemos en Today's Parent.

Lo que le ocurrió a Ethan no es un caso aislado. La inteligencia artificial ya está entretejida en la vida de los niños, a menudo de formas que los padres no alcanzan a ver del todo. Según un informe reciente de la Brookings Institution, la realidad es cruda: por ahora, los riesgos de la IA generativa en el aprendizaje de los niños superan a los beneficios. Y como lo expresa Sinead Bovell, asesora en foresight estratégico, estamos en medio de una "crisis de confianza". El peligro no es solo que los niños hagan trampa en la escuela. Es que dejen de creer en su propia capacidad para tomar decisiones y, en última instancia, para hacer su propio trabajo.

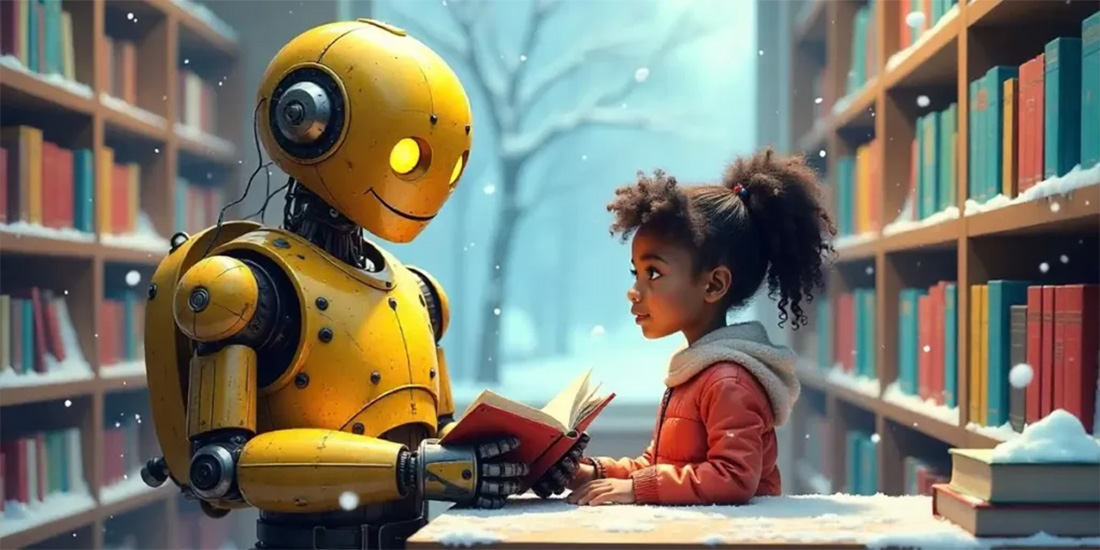

La alfabetización en inteligencia artificial, sostienen los especialistas, no consiste en prohibir herramientas. Los niños ya las usan, y prohibir algo que ya está ahí rara vez funciona. Se trata, más bien, de proteger la resistencia cognitiva del niño. De enseñarle a tratar la IA como un "primer borrador rápido" y no como un oráculo infalible. Porque el riesgo real es que los niños subcontraten su pensamiento crítico a una máquina que, por muy sofisticada que parezca, no piensa. Solo predice palabras.

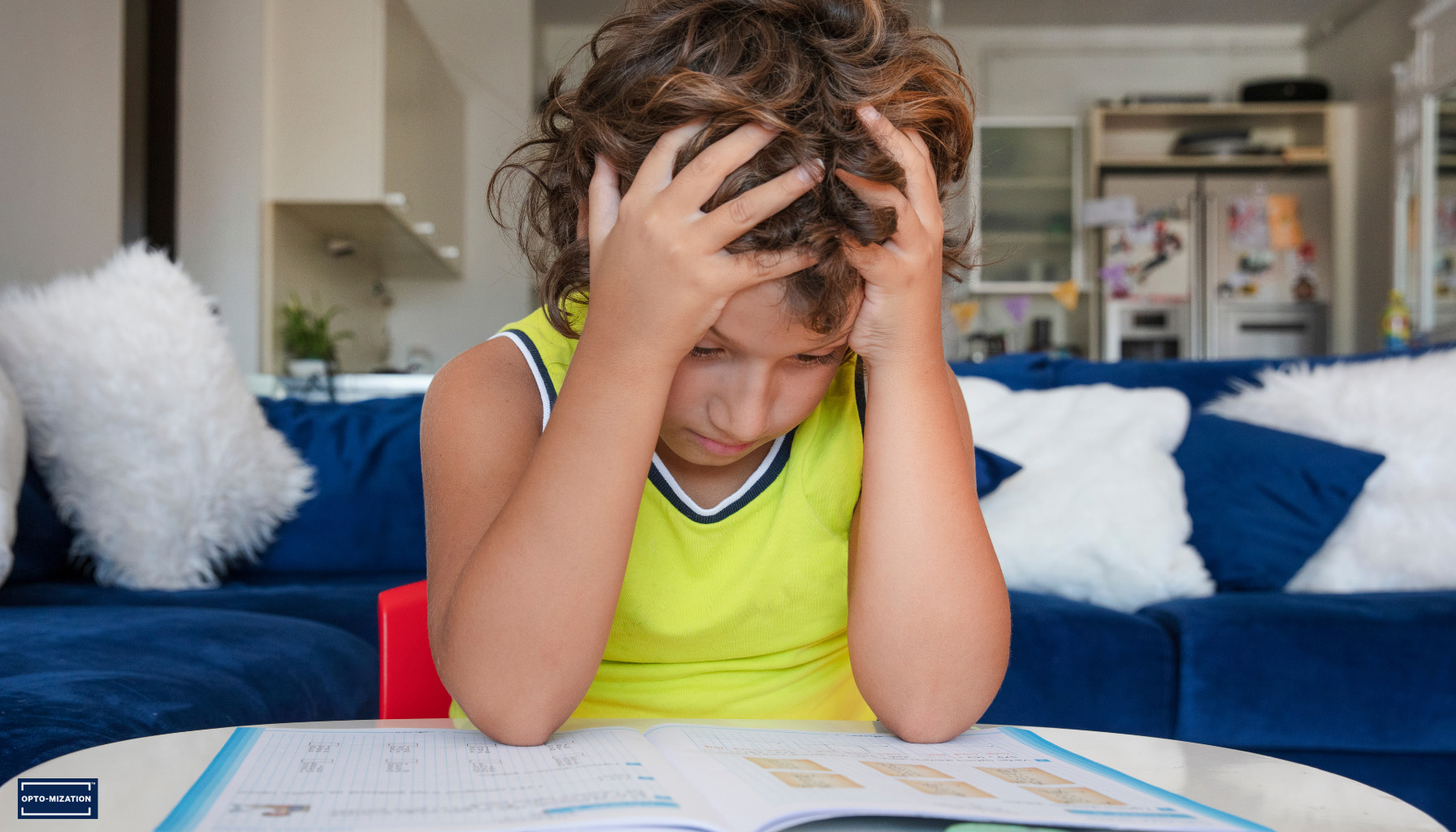

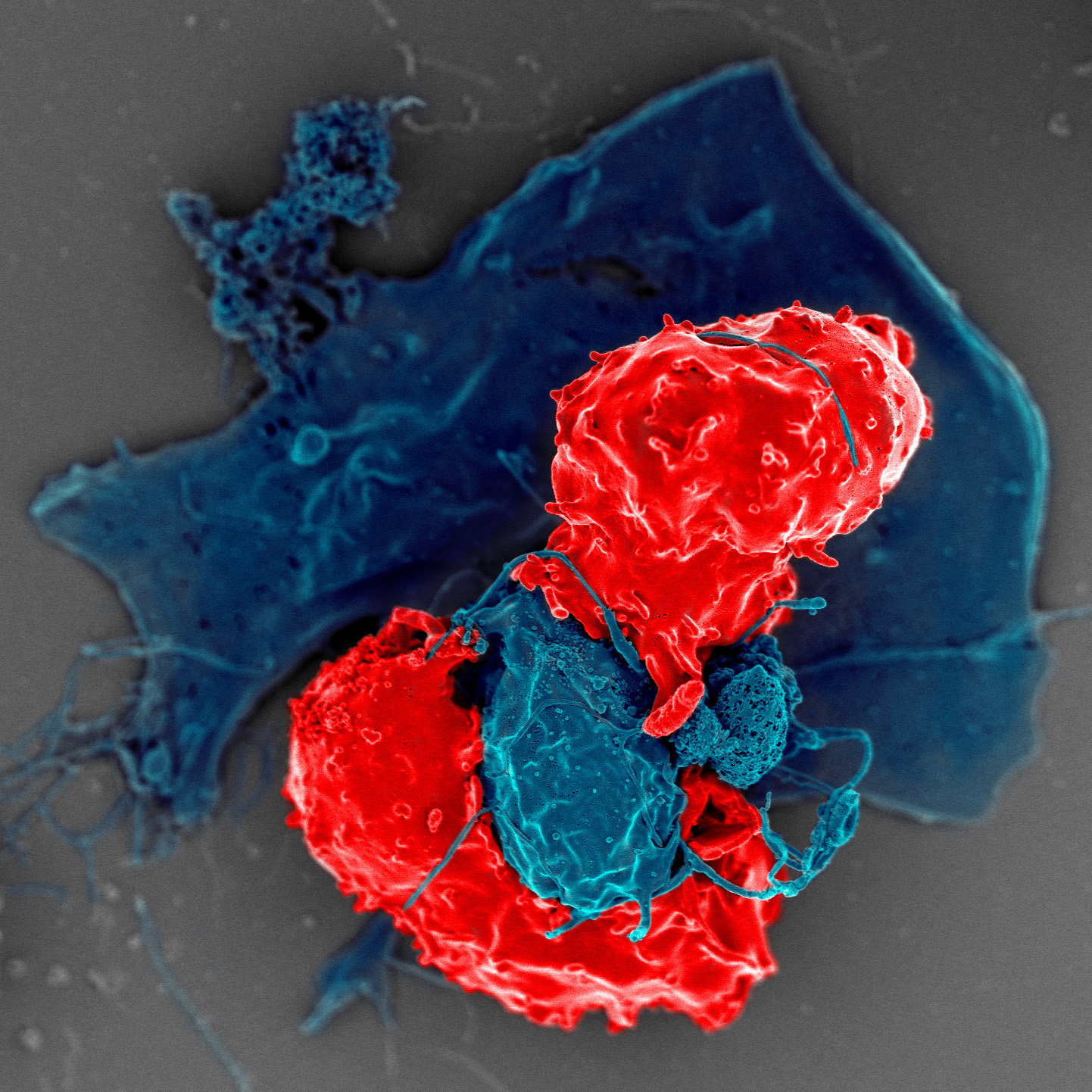

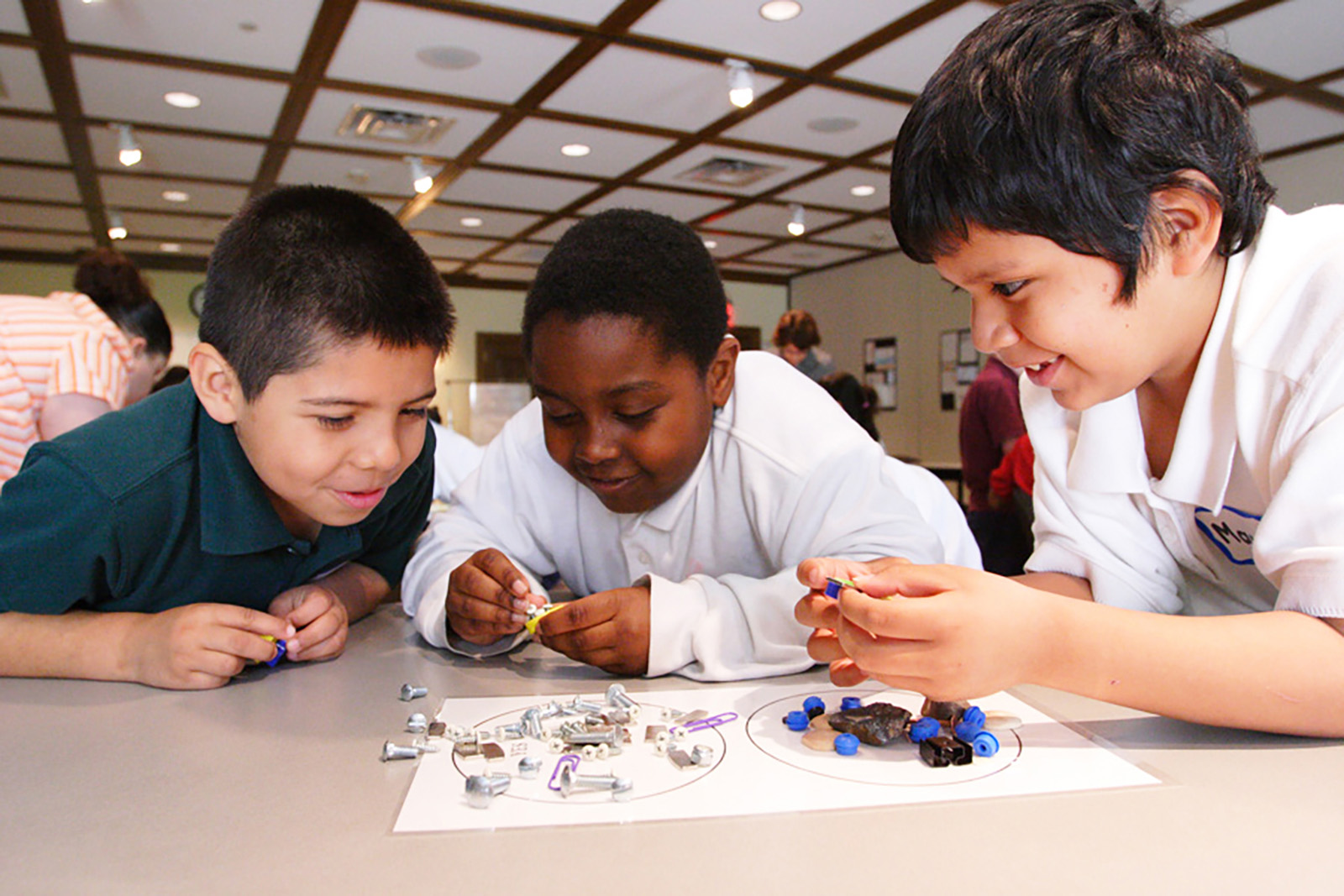

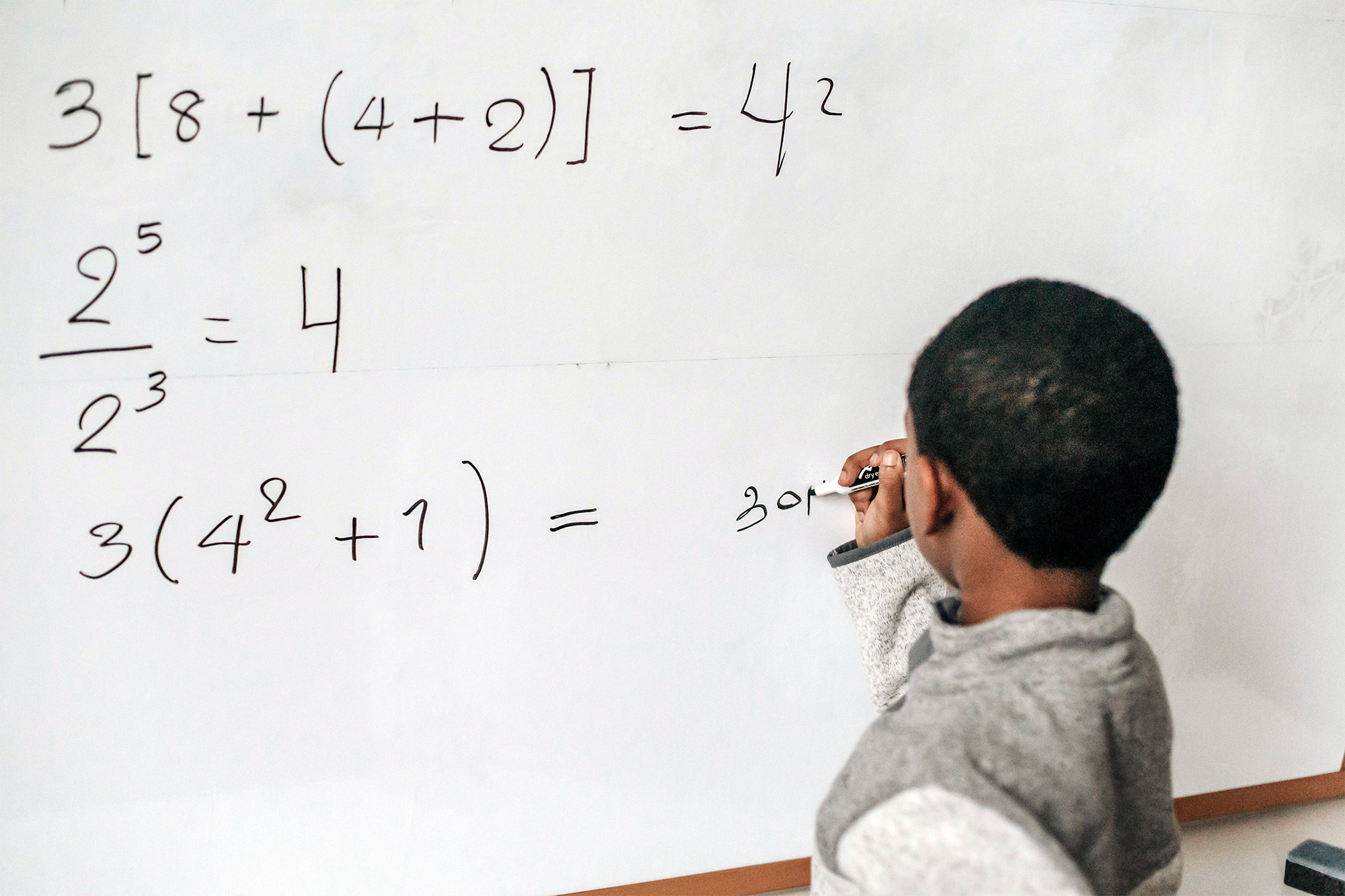

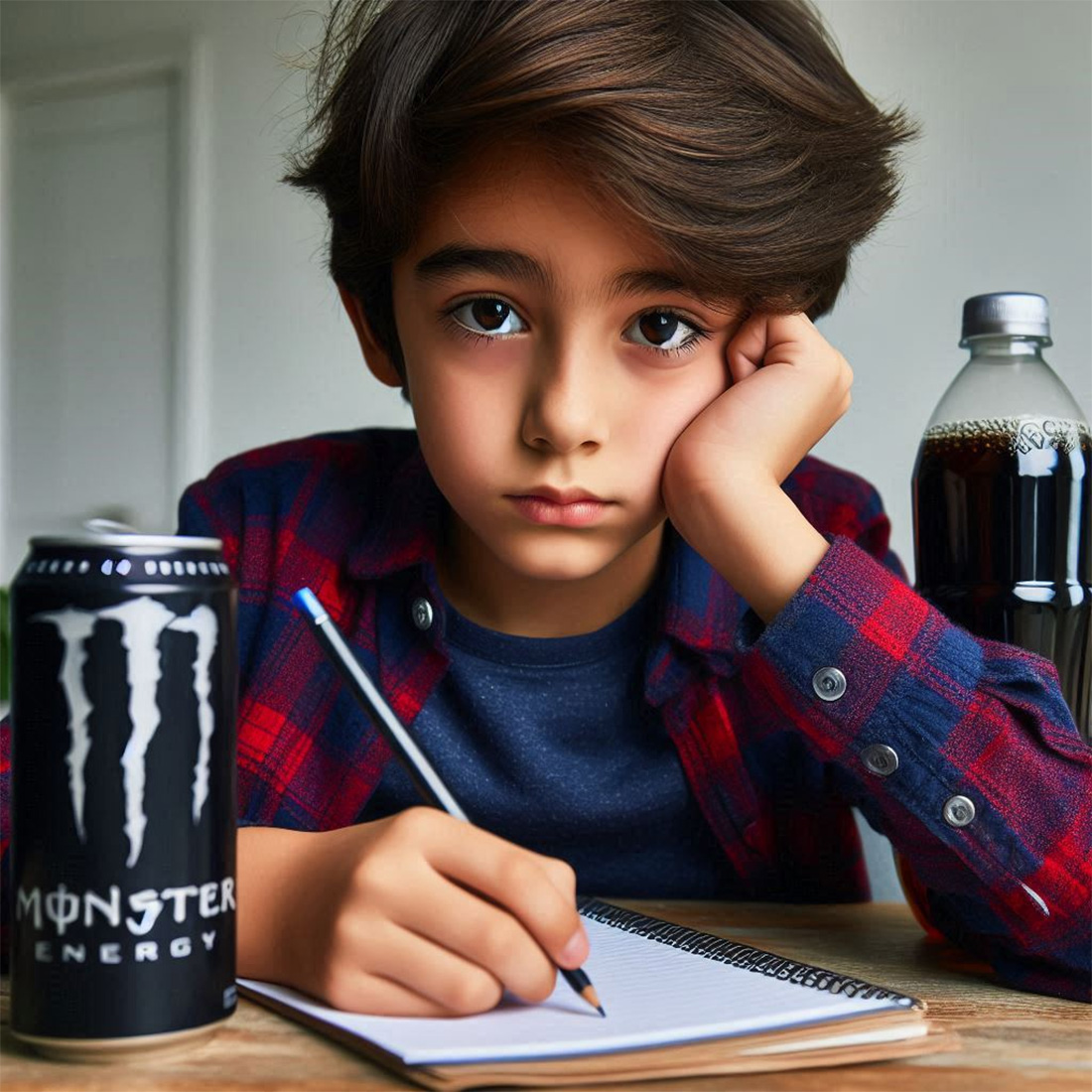

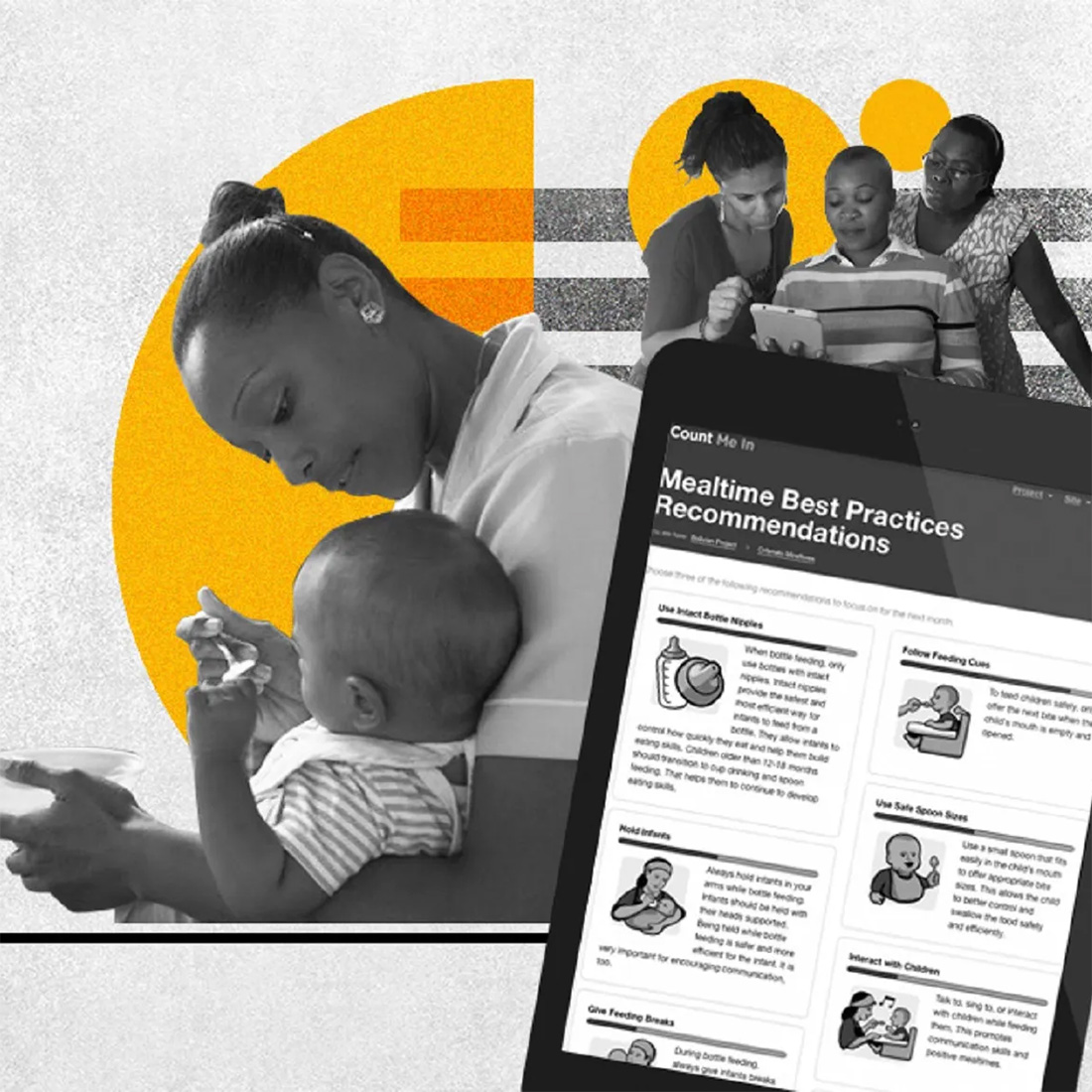

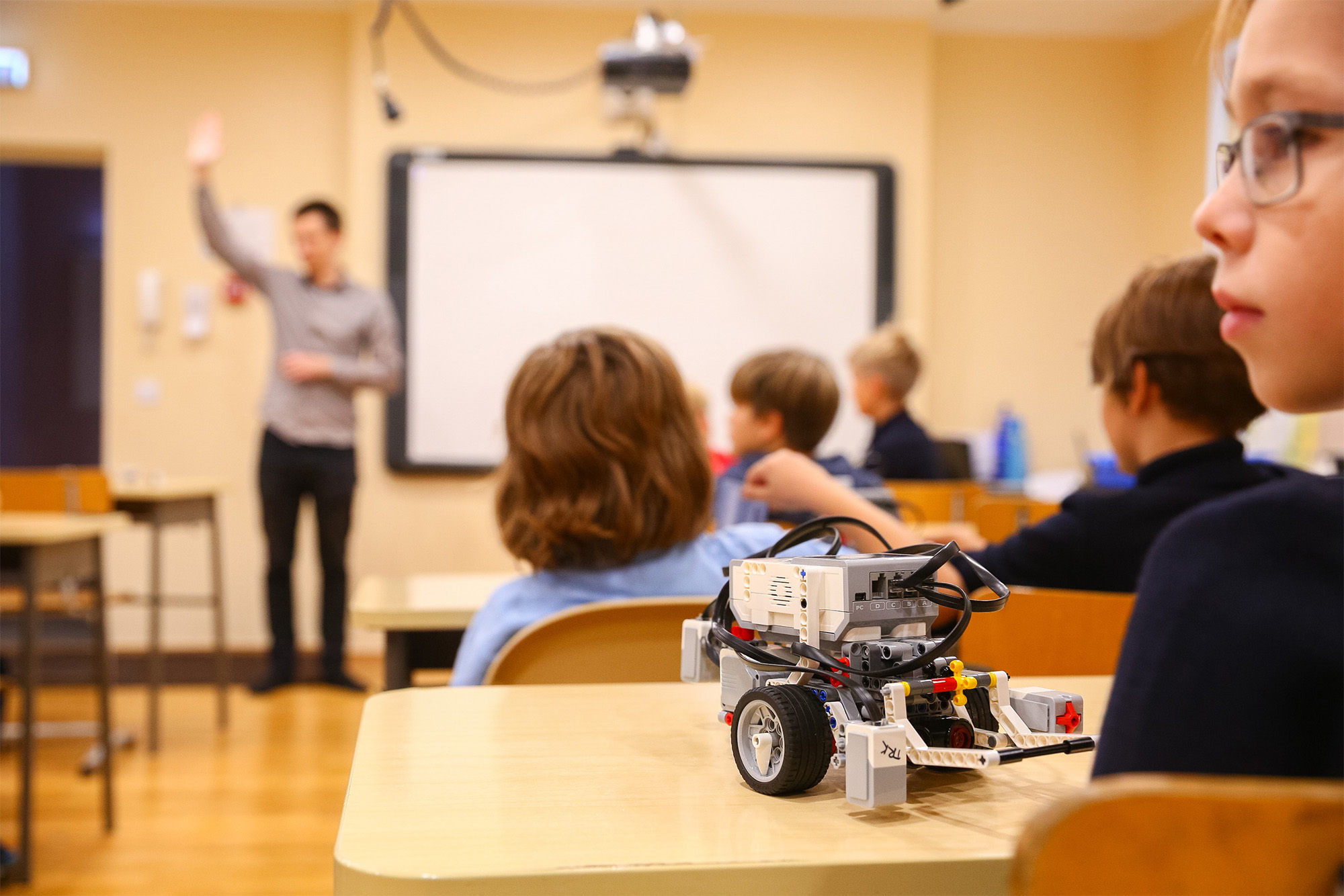

Bovell cita un estudio crítico de la Universidad de Wharton que todo padre debería conocer. Los investigadores analizaron a tres grupos de estudiantes de matemáticas. El primero, el grupo de control, usó libros de texto tradicionales. El segundo, llamado "no inhibido", tuvo acceso a un chatbot estándar. El tercero usó un tutor de IA diseñado para dar pistas, no para dar respuestas directas. Los resultados fueron reveladores: el grupo "no inhibido" rindió un 48 por ciento mejor en los problemas de práctica, pero obtuvo un 17 por ciento peor en el examen final. Habían externalizado su pensamiento y, como consecuencia, se volvieron cognitivamente más débiles. El informe de Brookings argumenta que el futuro todavía está en nuestras manos, pero que los resultados dependen de las decisiones que tomemos hoy.

La conversación sobre la alfabetización en IA, entonces, no gira en torno a restringir herramientas. Gira en torno a proteger el juicio en desarrollo de los niños en un mundo que recompensa la producción sin esfuerzo. El riesgo es que no construyan la resistencia cognitiva y la regulación emocional que la vida adulta exige. El juicio, la fricción, el trabajo de pensar las cosas: todas esas son habilidades necesarias para ser exitoso. Y se pueden construir a través de una serie de hábitos, conversaciones honestas y reglas domésticas. Para los niños pequeños, de entre tres y seis años, proteger el juicio significa proteger el límite entre las herramientas y las relaciones.

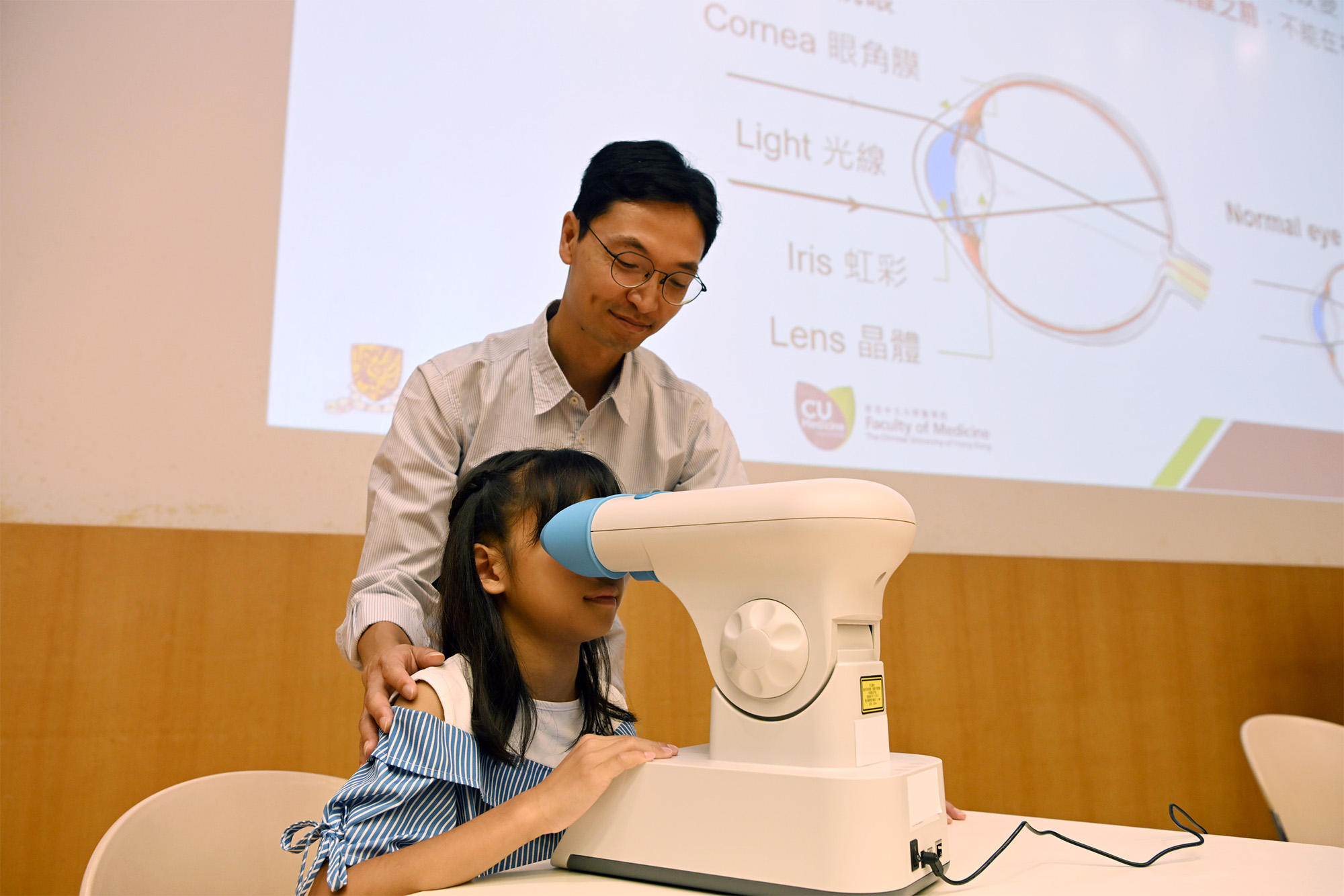

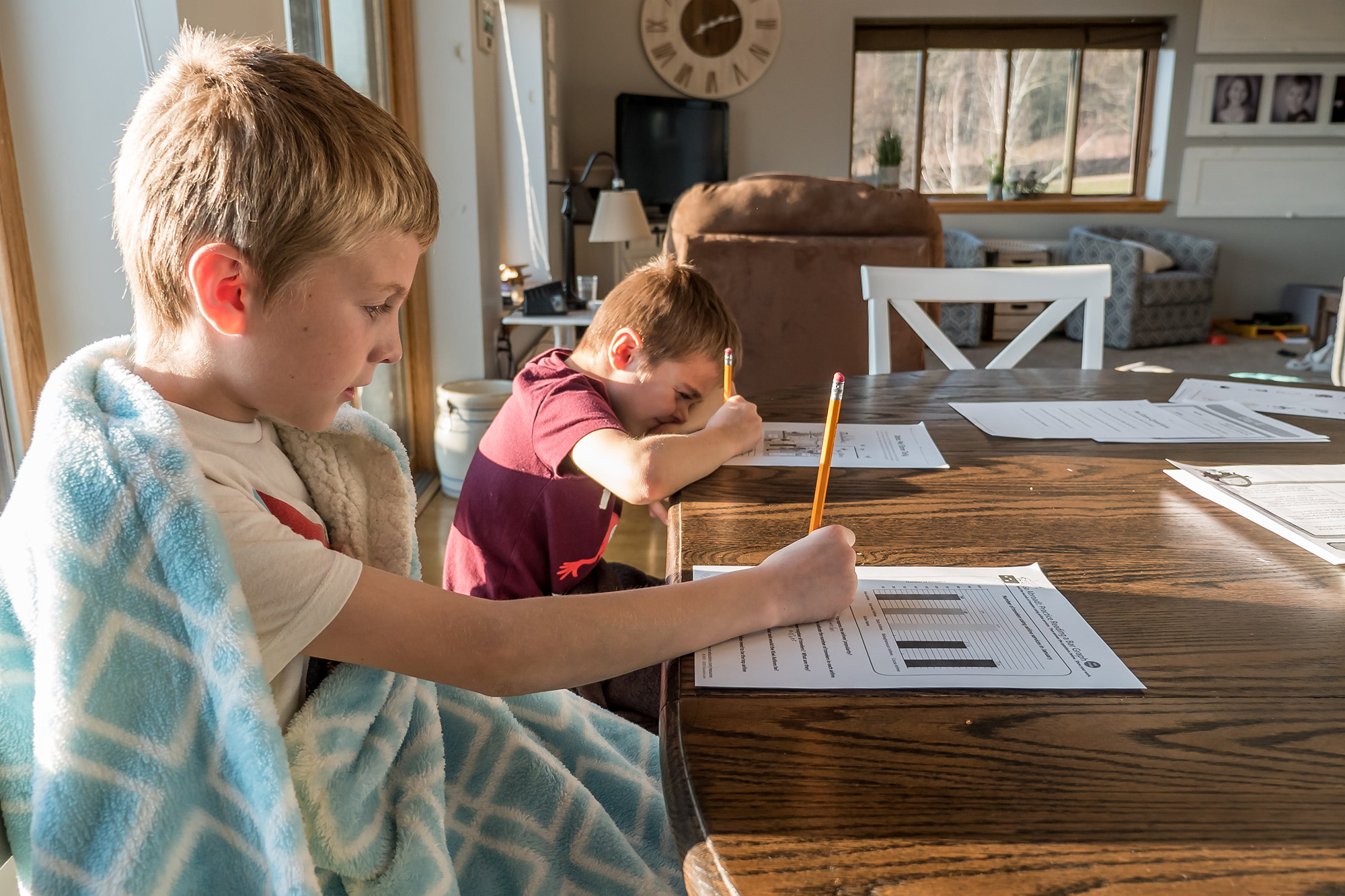

Josh, un padre de dos hijos en el noroeste de Ohio, necesitaba hacer tareas domésticas. Su hijo de cuatro años llevaba cuarenta y cinco minutos hablando de Thomas el Tren. Así que Josh le dio su teléfono con ChatGPT abierto en modo de voz. Dos horas después, encontró a su hijo todavía conversando feliz. "Mi hijo cree que ChatGPT es la persona más genial del mundo que ama los trenes", dijo. El desafío con los niños de esta edad es que tienden a antropomorfizar los objetos. La profesora Ying Xu, de la Universidad de Harvard, señala que los niños que creen que la IA tiene agencia pueden sentir que está "eligiendo" hablar con ellos.

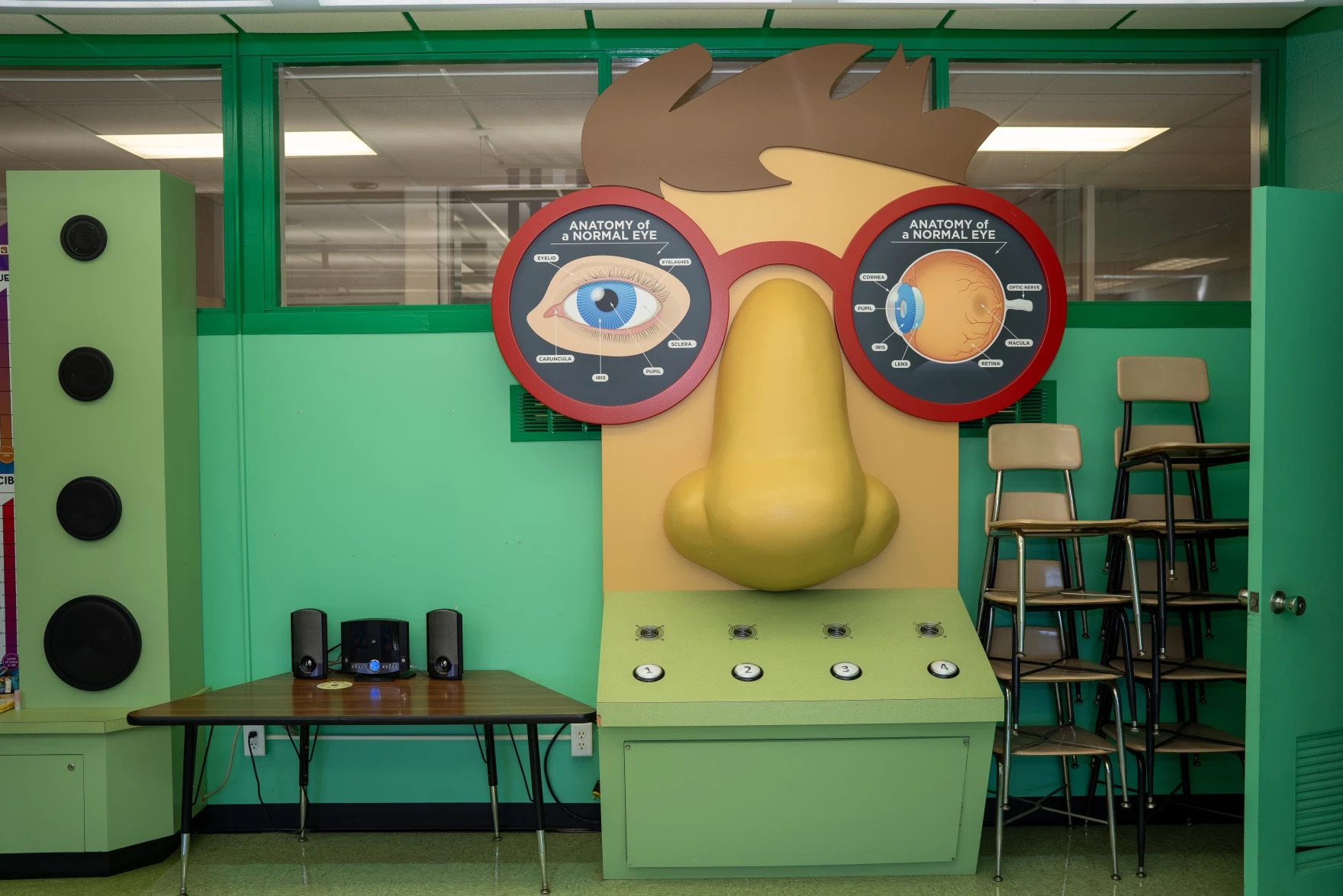

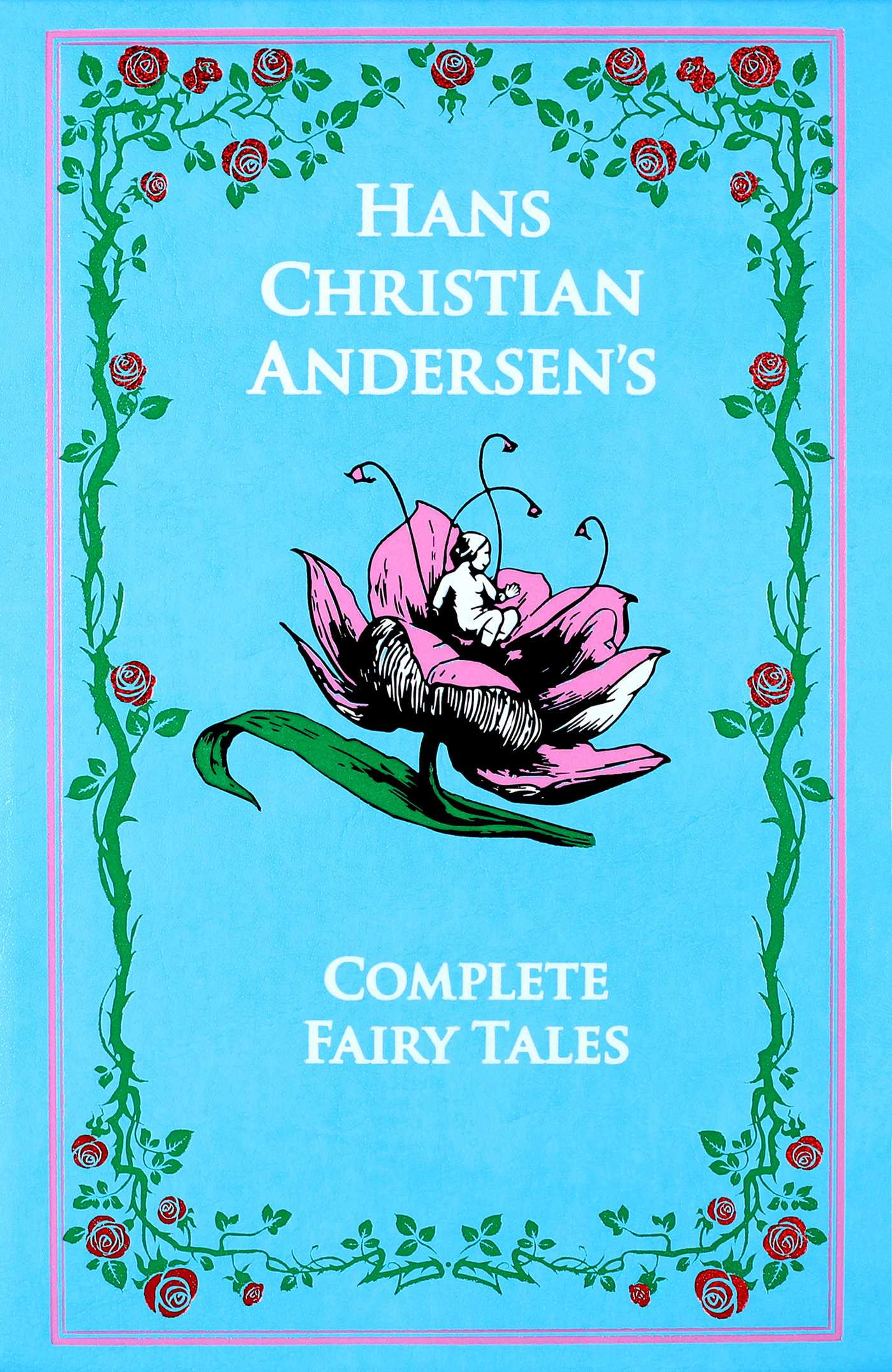

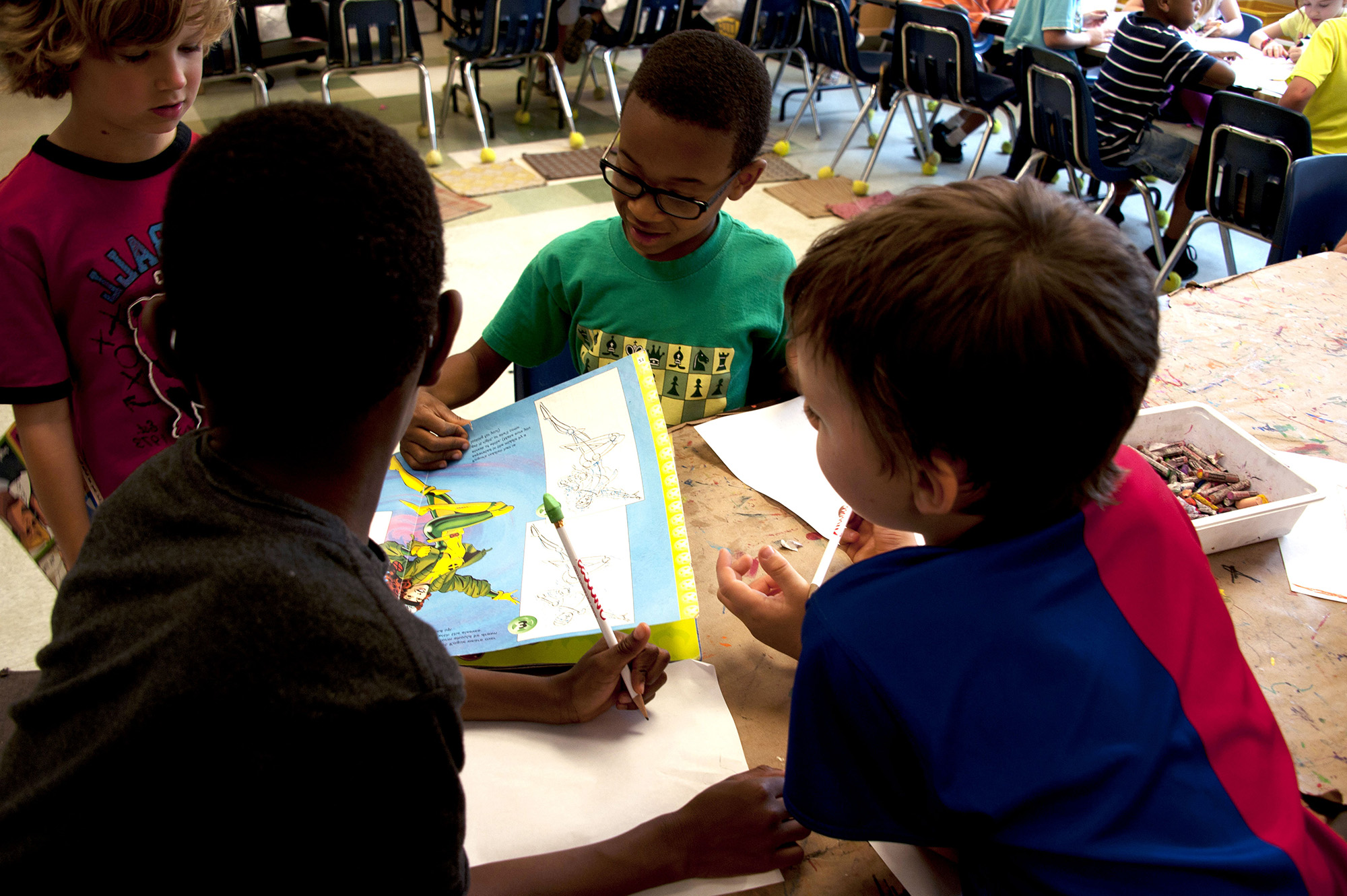

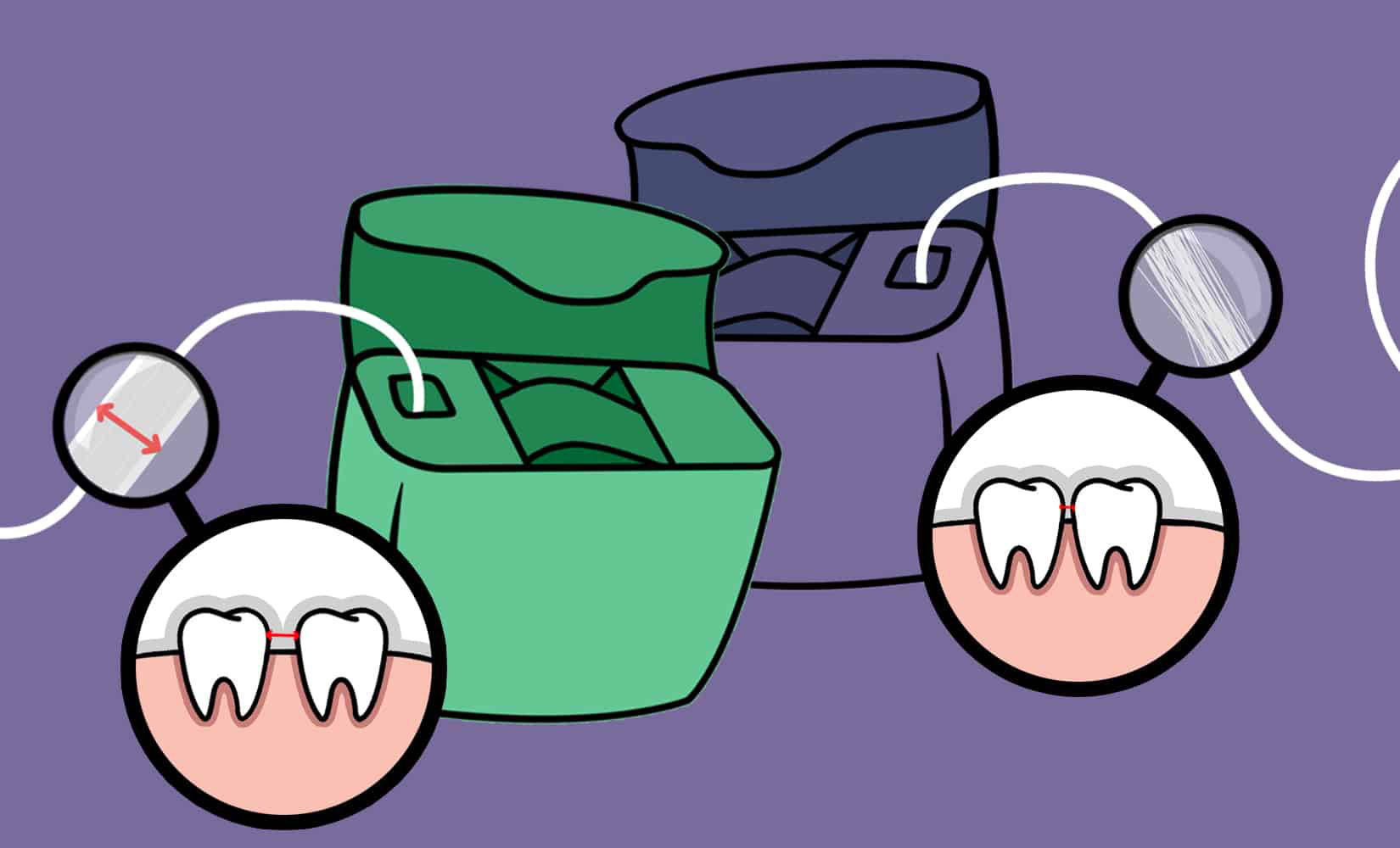

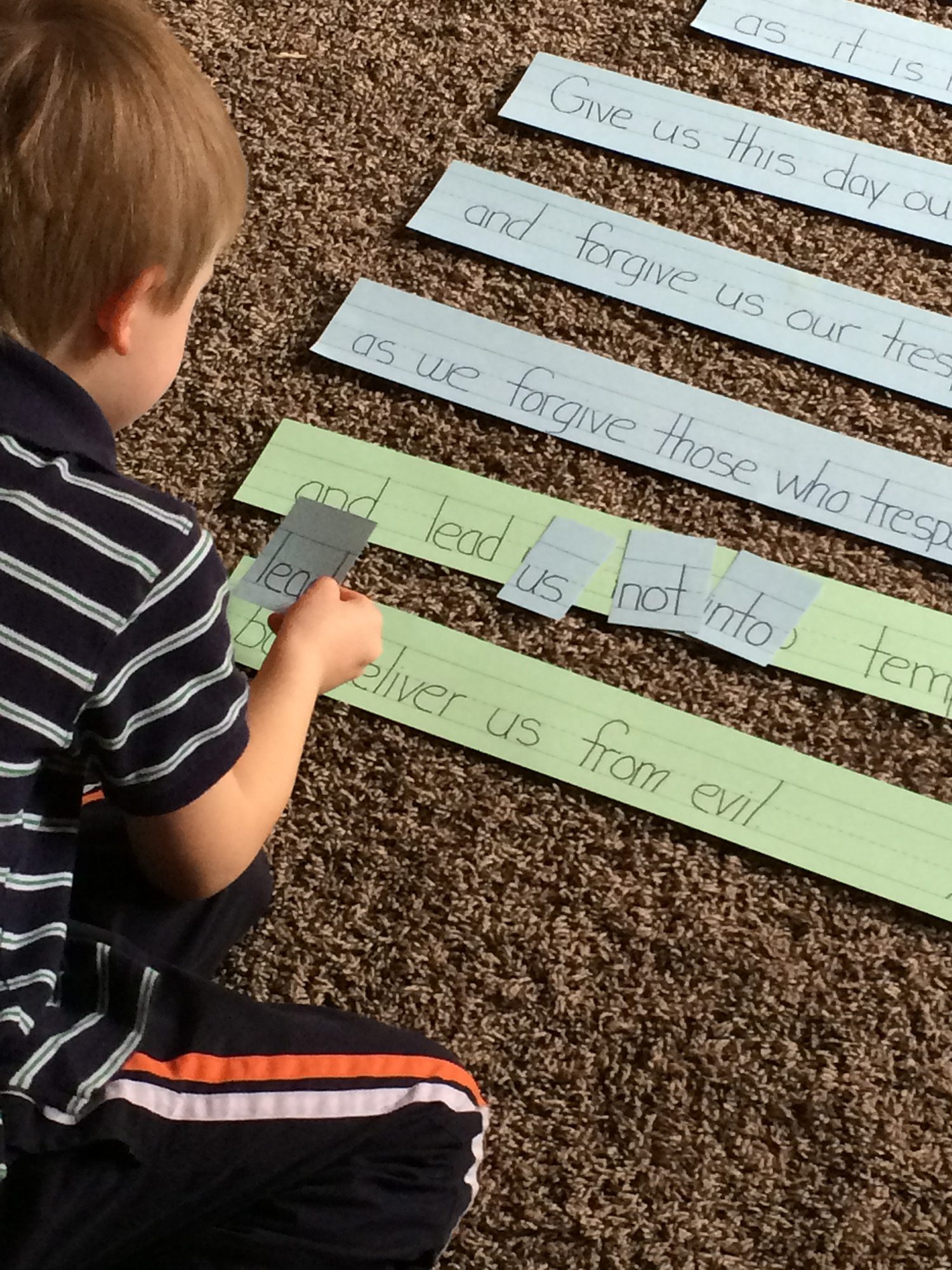

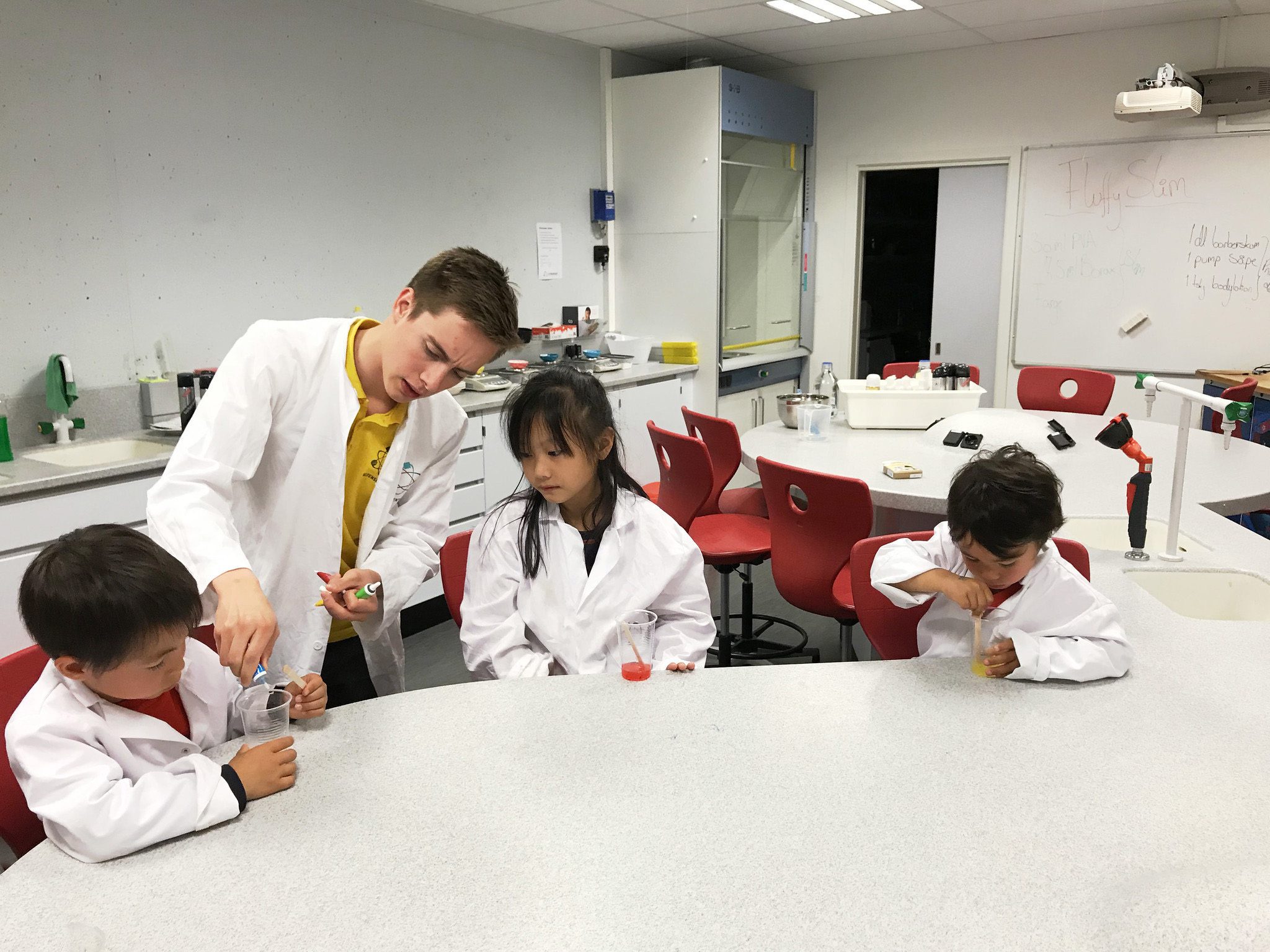

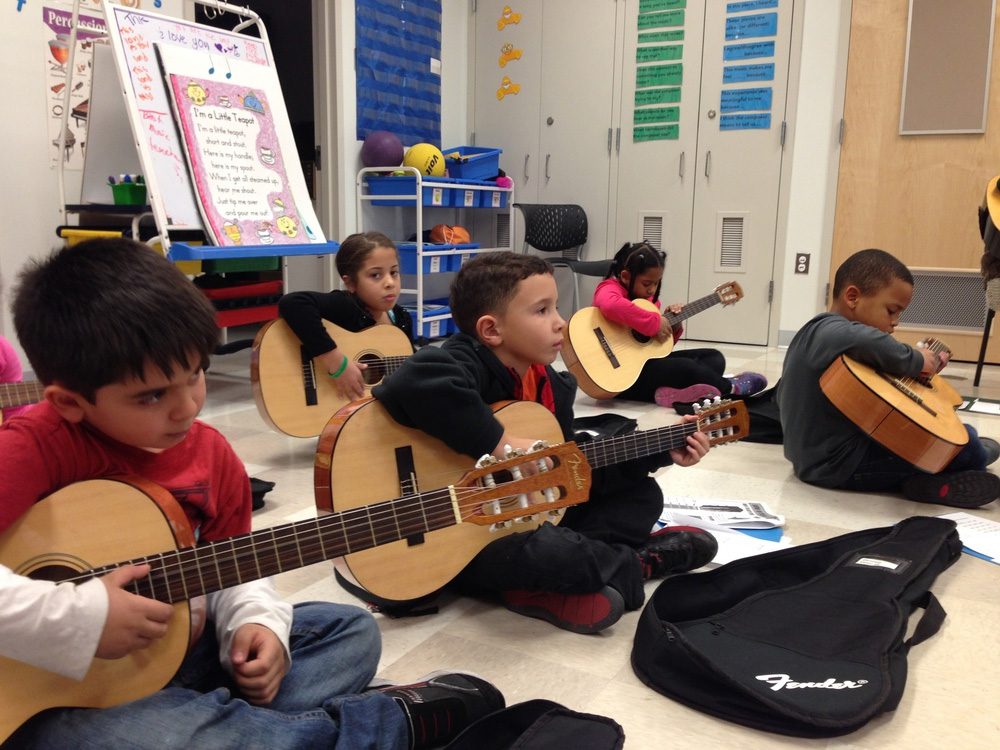

La UNESCO recomienda que los niños menores de trece años no tengan acceso independiente a chatbots de propósito general. A esta edad, la regla de oro es la presencia de un adulto, no un filtro parental. La alfabetización en IA se reduce a dos fundamentos: esto es una herramienta, y la información privada se mantiene privada. Una actividad práctica sugerida es el juego de clasificación "¿Está vivo?". Consiste en mostrar al niño tarjetas con imágenes de una mascota, un muñeco, un profesor, una tostadora, un teléfono, un robot de dibujos animados, y preguntarle: "¿Cuáles necesitan comida? ¿Cuáles pueden sentir tristeza? ¿Cuáles pueden fingir que hablan?". Es un ejercicio sencillo que ayuda a los niños a separar las herramientas de las relaciones. Otra actividad es el juego "adivina la siguiente palabra": se le pide al niño que diga qué palabra viene a continuación en una frase, y luego se le muestra el autocompletado del teléfono para ver si coincide. Es una forma de revelar el mecanismo central de la IA antes de que el niño sea lo suficientemente mayor para quedar deslumbrado por ella.

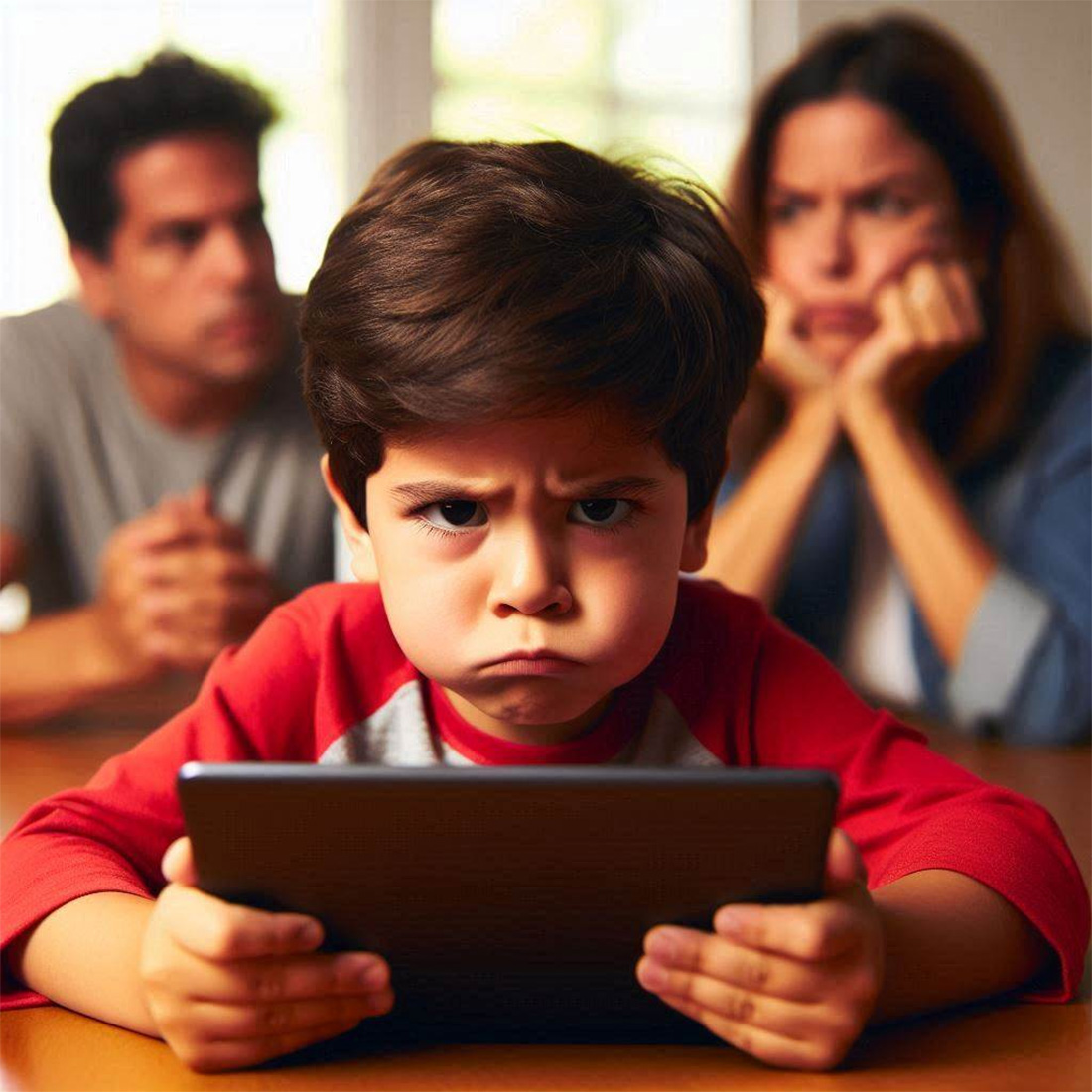

Los padres deben estar atentos a señales como que el niño comparta información personal con un dispositivo, que muestre angustia cuando se le retira el acceso, o que trate a un altavoz inteligente como si fuera un amigo. Esas son señales de que es momento de estrechar los límites. Para los niños en edad escolar, de siete a trece años, proteger el juicio significa separar la confianza de la evidencia. Un ejemplo: John, un padre de dos hijos en Boston, usó una herramienta de IA para generar una imagen fotorrealista de un "camión de bomberos monstruo" para su hijo de cuatro años, que quedó encantado. Durante días, el pequeño insistió ante su hermana de siete años que había visto la prueba fotográfica de que los camiones de bomberos monstruo existían. La hermana no se lo creyó. Sin que nadie le dijera nada, se hizo la pregunta clave: "¿Esto se corresponde con la realidad?". Eso es, exactamente, la alfabetización en IA a esta edad.

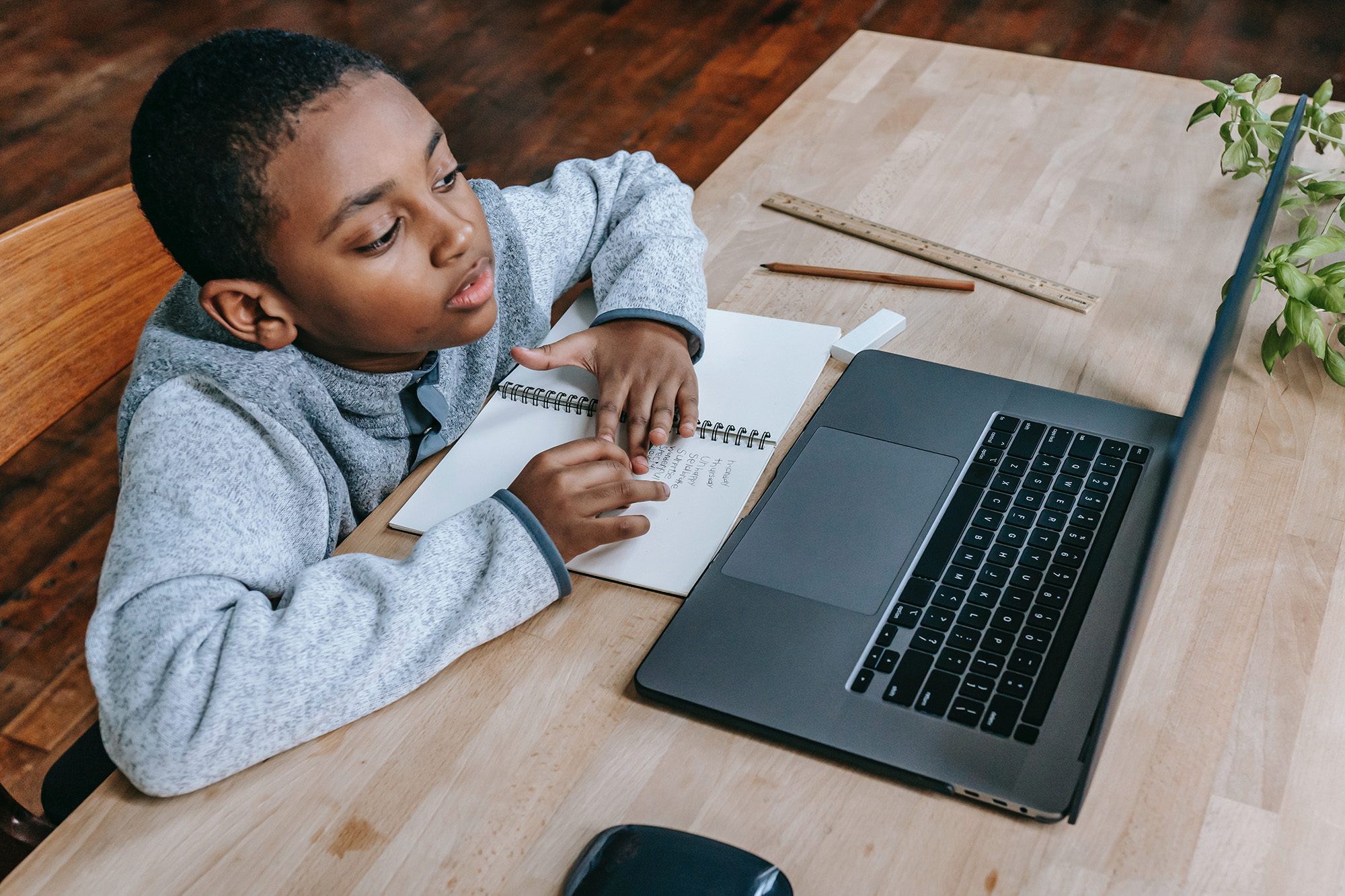

A estas alturas, los niños pasan de tratar a la IA como un amigo a usarla como fuente de información. El riesgo es que externalicen el esfuerzo, que dejen que el bot haga el trabajo de pensar por ellos. Brookings sugiere orientar a los niños hacia el uso de la IA para generar borradores e ideas, pero insistir en que ellos mismos hagan el razonamiento central. Los años previos a la adolescencia son el momento en que los sistemas algorítmicos se convierten en una fuerza dominante en el entorno informativo del niño. TikTok, Instagram y YouTube son sistemas de IA que han aprendido con considerable precisión qué mantiene a cada usuario mirando la pantalla. El riesgo más sutil es psicológico: cuando las conversaciones sobre la identidad pasan a través de un algoritmo, los niños pueden tener dificultades para distinguir entre quiénes son y quién dice su feed que son. Darles el vocabulario para ver eso con claridad es, en gran medida, una tarea de los padres, sobre todo porque el 59 por ciento de los profesores canadienses admiten no sentirse preparados para guiar a los estudiantes en el uso de la IA.

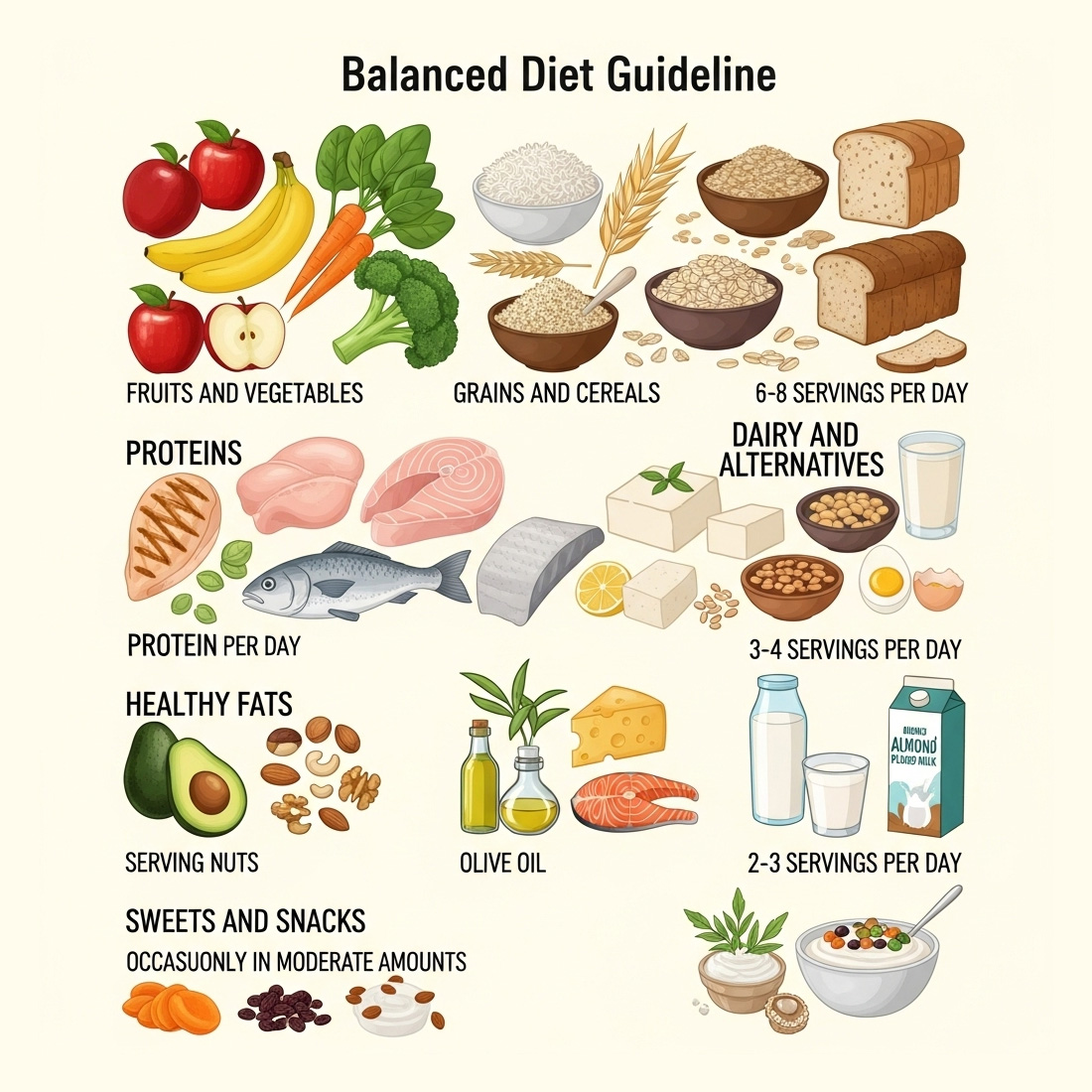

Una estrategia práctica es la regla de las dos fuentes. Cuando el niño le haga una pregunta factual a la IA, hay que verificar una fuente adicional de confianza. Puede ser un libro de la biblioteca, una página educativa de un museo o un sitio de noticias para niños. La idea es transmitir un mensaje claro: "la IA es un primer borrador rápido. El aprendizaje real es verificar". Otra actividad es el diario de recomendaciones durante una semana. Cada día, el niño debe anotar o capturar tres elementos que le haya servido la red social: vídeos, clips, anuncios. Luego se discute: "¿Qué viste o buscaste que pudo haber provocado esto?", "¿Cómo te hace sentir?", "¿Qué elegirías a propósito?". Esto conecta el concepto abstracto de los algoritmos con la experiencia concreta del niño.

También es necesario abordar el uso de la IA como apoyo emocional. Investigaciones emergentes muestran que muchos adolescentes usan chatbots para hablar de sus sentimientos, y algunos afirman que el bot los entiende mejor que las personas de su entorno. La recomendación de los expertos es abordar el tema sin juicios: "Si alguna vez usas un chatbot para desahogarte, quiero saberlo. No para castigarte, sino para mantenerte a salvo". Luego, dos reglas claras: no compartir datos de identificación personal, y cualquier conversación sobre autolesiones o crisis debe derivarse inmediatamente a un adulto.

Otro tema que los padres deben tratar con los adolescentes es el de los medios sintéticos y el consentimiento. Se puede plantear con dos o tres escenarios realistas: un mensaje de voz fabricado, un vídeo editado, una imagen hecha para que parezca que el adolescente aparece en una situación comprometedora. La pregunta es: "¿Qué harías en los primeros diez minutos? ¿A quién se lo contarías? ¿Cómo conservarías las pruebas sin difundirlas?". Es mejor tener esa conversación antes de que sea urgente.

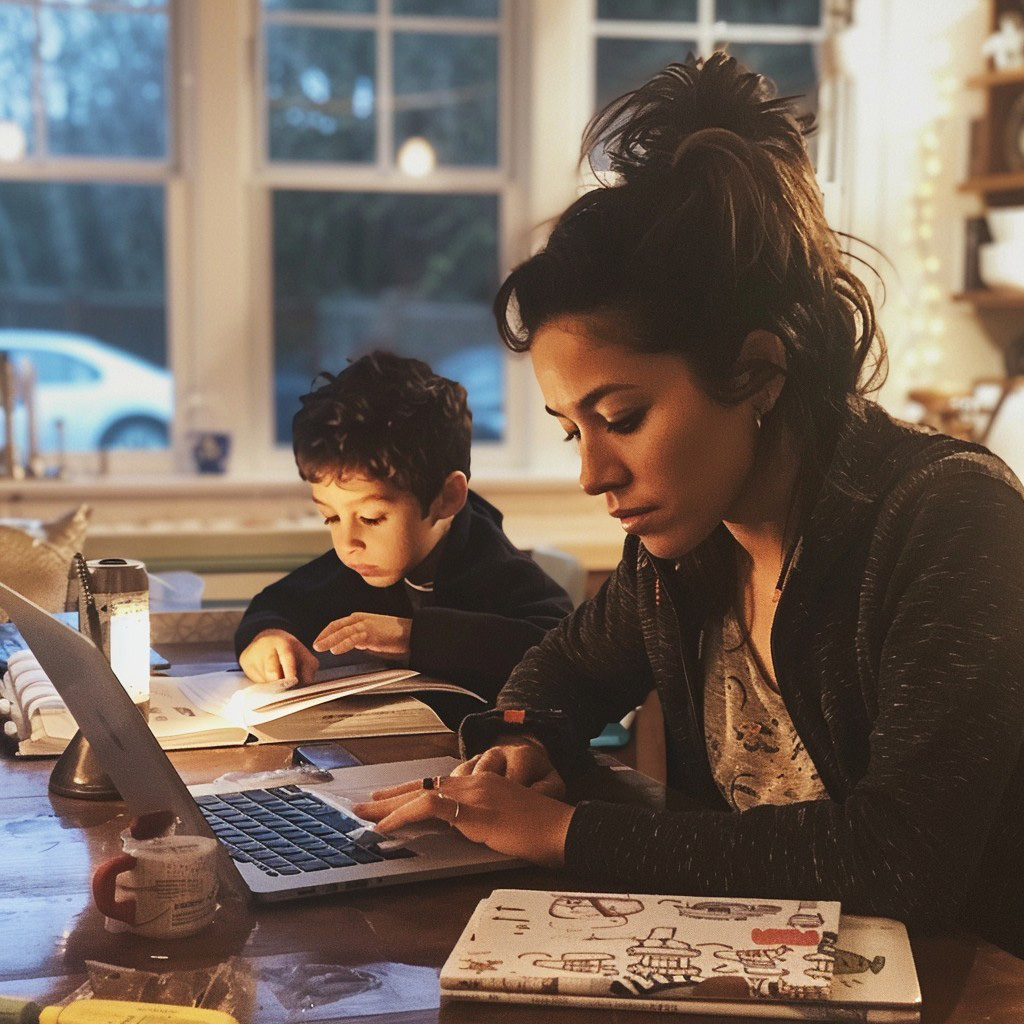

Los padres, por último, deben ser conscientes de que ellos mismos modelan hábitos. Si tratan la IA como un oráculo al que consultar por todo, los hijos harán lo mismo. La cena, sin dispositivos, sigue siendo uno de los espacios más protectores que una familia puede mantener, porque preserva la conversación que la investigación identifica sistemáticamente como el amortiguador más significativo para el bienestar de un niño. No es necesario convertirse en un experto en IA, pero mostrar el propio juicio, para que los niños puedan escuchar cómo suena el pensamiento deliberado, es la forma en que aprenden. Frases como "estoy usando la IA para generar opciones, pero voy a tomar la decisión final", "no pongo información personal en esta herramienta", "estoy verificando esa afirmación con otra fuente", "usé IA aquí, así que lo voy a declarar", son lecciones de pensamiento crítico en acción.

La IA ya es parte del mundo de los niños. Que fortalezca o debilite su juicio depende menos de la herramienta y más de los hábitos que se construyan a su alrededor. No se trata de tener todas las respuestas. Se trata de hacer las preguntas correctas. Y de recordar, como en el caso de Ethan y su robot lector, que la línea entre una herramienta y un amigo puede volverse muy difusa cuando uno tiene nueve años. O cuando uno es padre y no sabe muy bien cómo manejar algo que ni siquiera existía cuando él era niño.

© SomosTV LLC-NC / Photo: © Stuart Caie

Comentarios