Universidad de Cambridge recomienda regulación urgente para proteger a la infancia de juguetes con IA

publisher

mcora

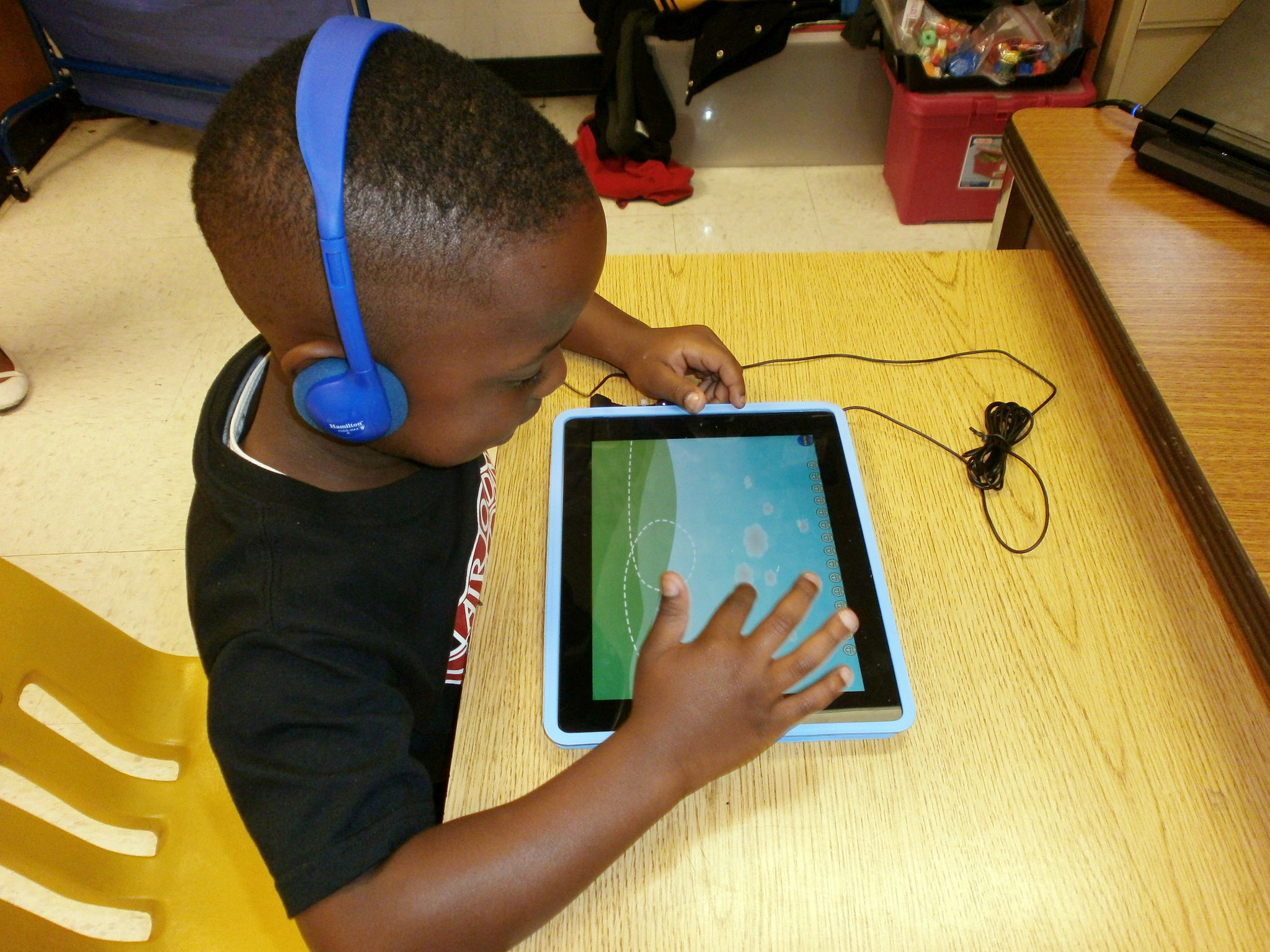

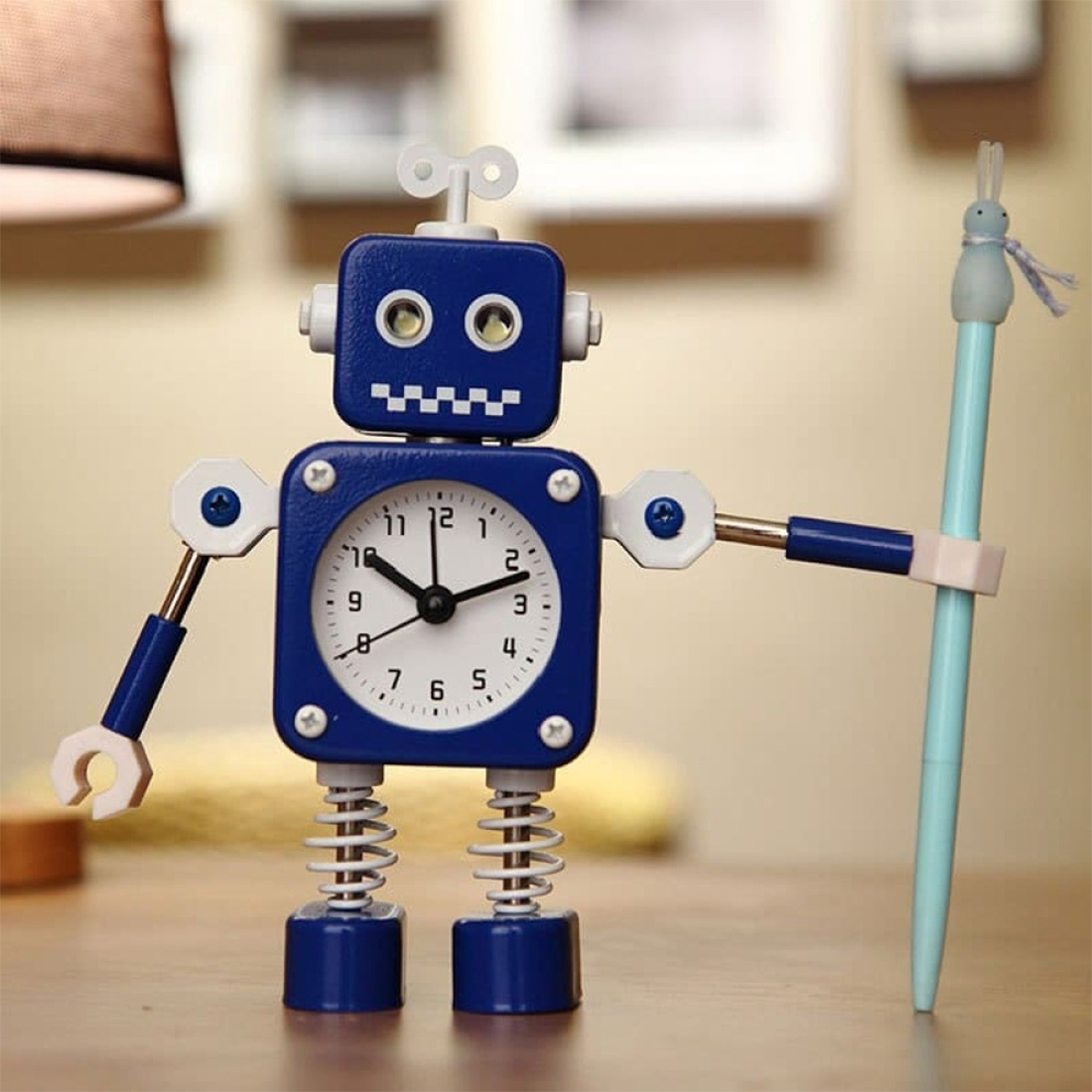

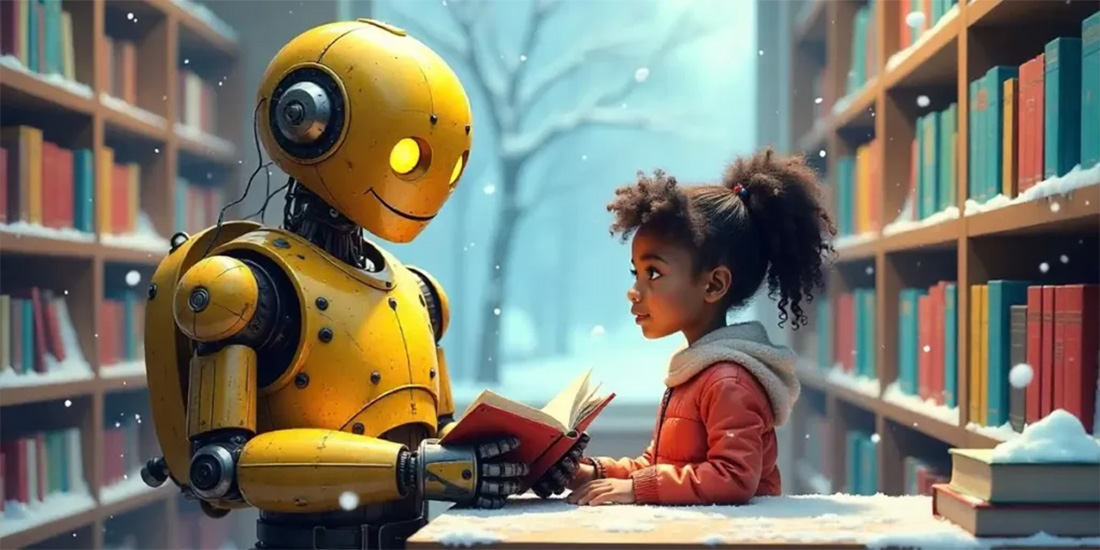

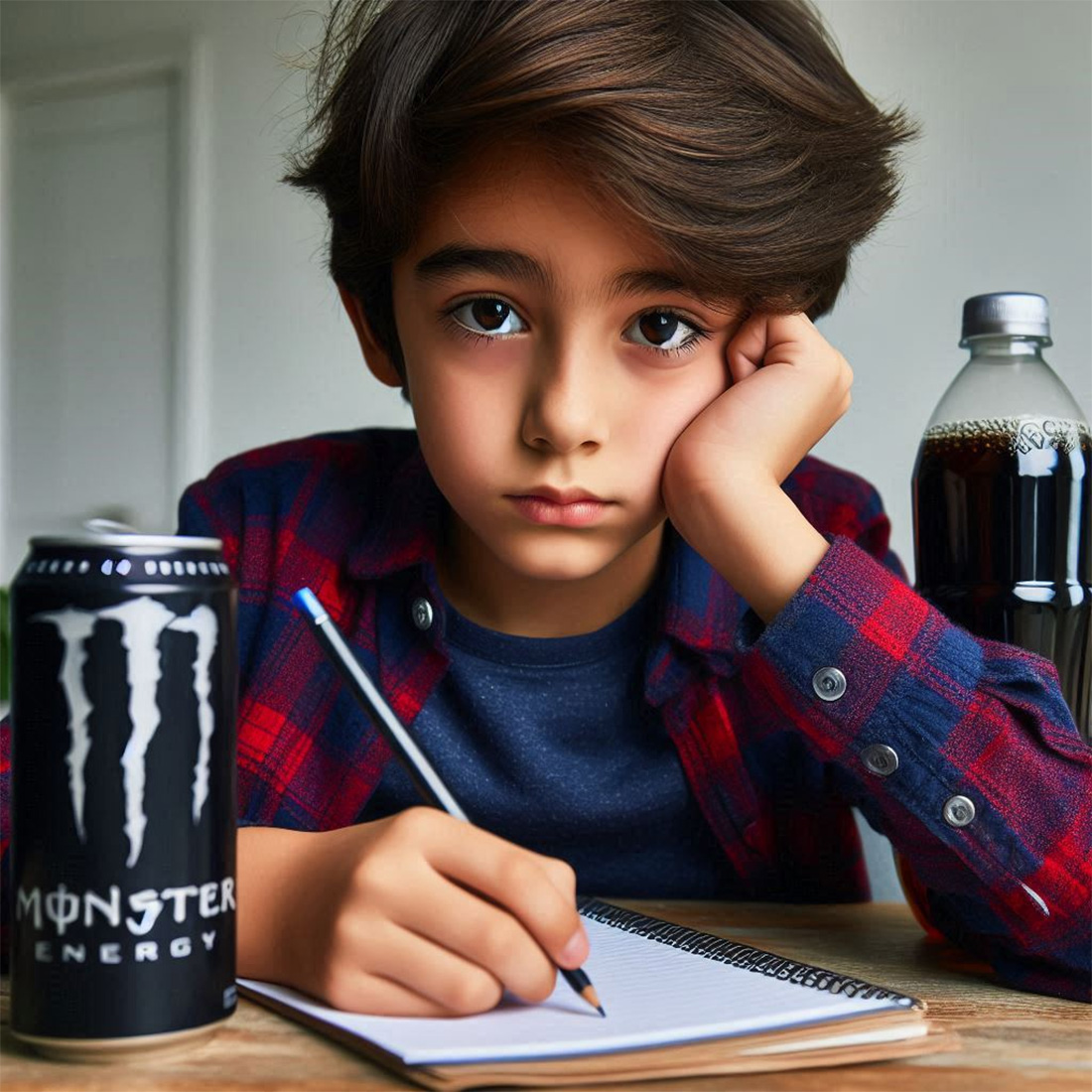

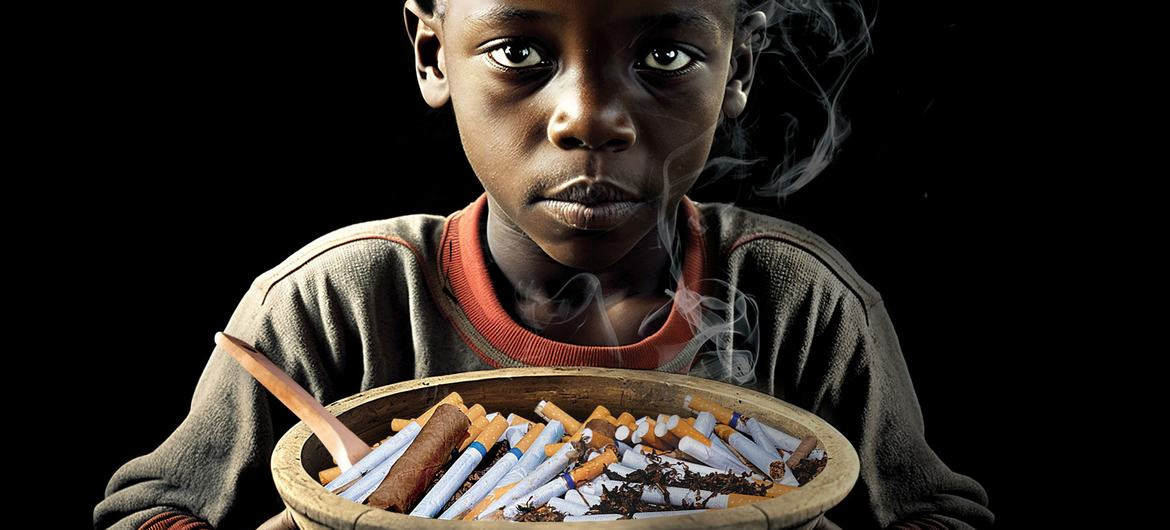

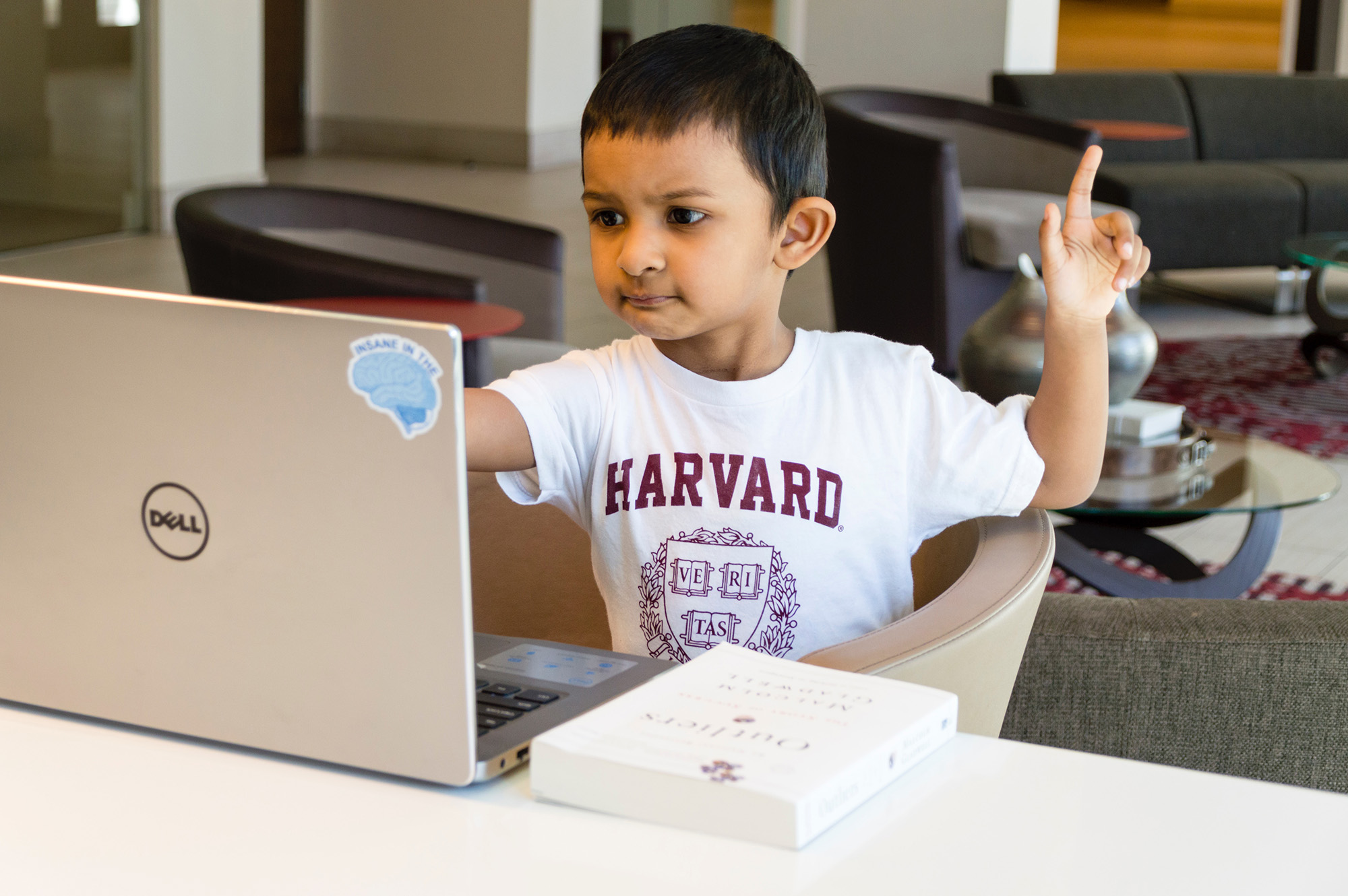

Los juguetes de inteligencia artificial diseñados para conversar con niños pequeños podrían necesitar una regulación más estricta y estándares de seguridad más claros, según una nueva investigación que examina cómo estas tecnologías interactúan con menores de cinco años.

El estudio, dirigido por investigadores de la Universidad de Cambridge, advierte que muchos juguetes con IA – comercializados como compañeros interactivos o herramientas educativas – están entrando en hogares y entornos de primera infancia con evidencia limitada sobre sus efectos en el desarrollo temprano.

Los autores argumentan que salvaguardas más claras, una mayor transparencia en torno al uso de datos y etiquetas de seguridad específicas podrían ayudar a padres y educadores a evaluar mejor los riesgos.

Los investigadores afirman que los resultados revelan tanto beneficios potenciales como limitaciones notables de los juguetes con IA en entornos de primera infancia.

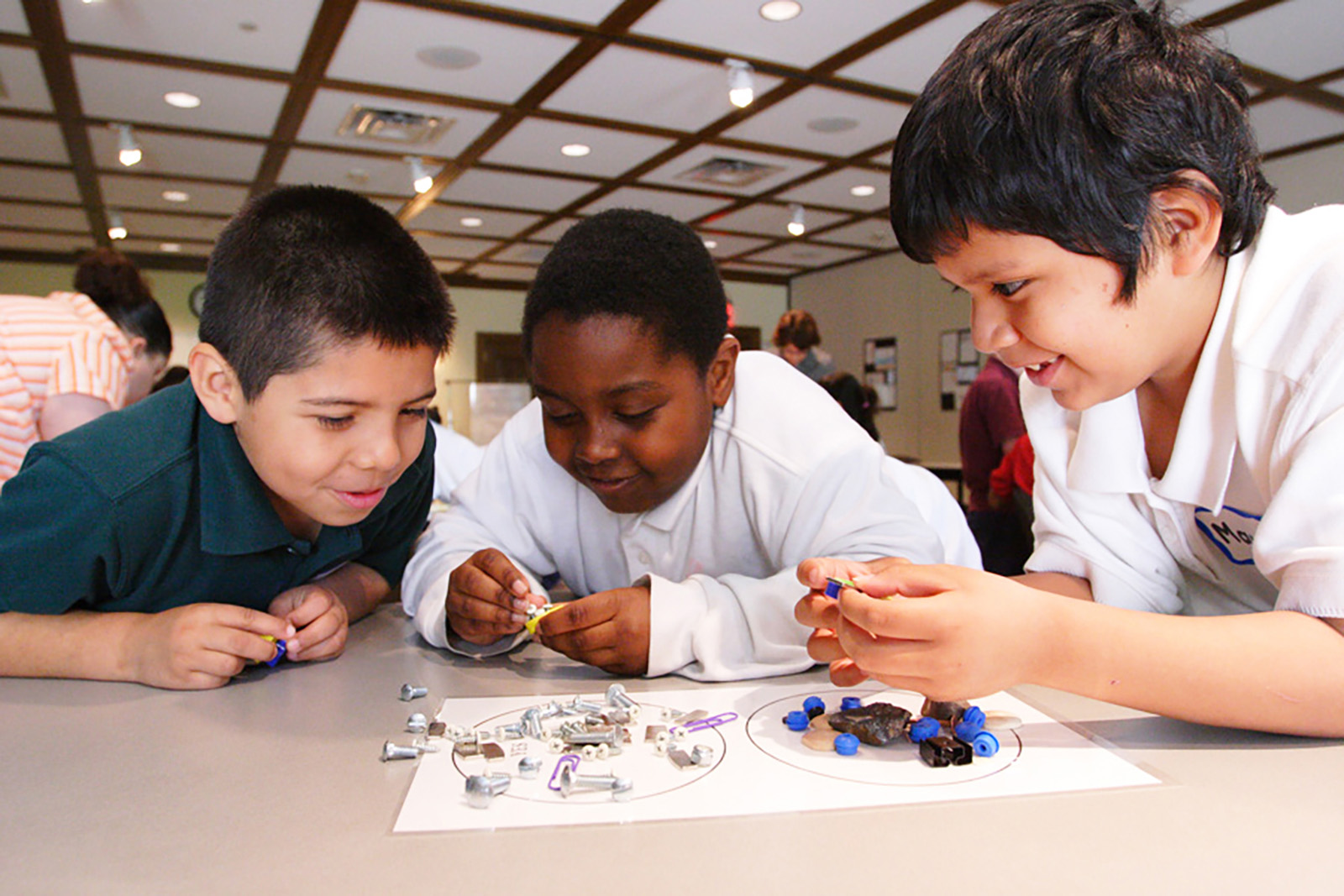

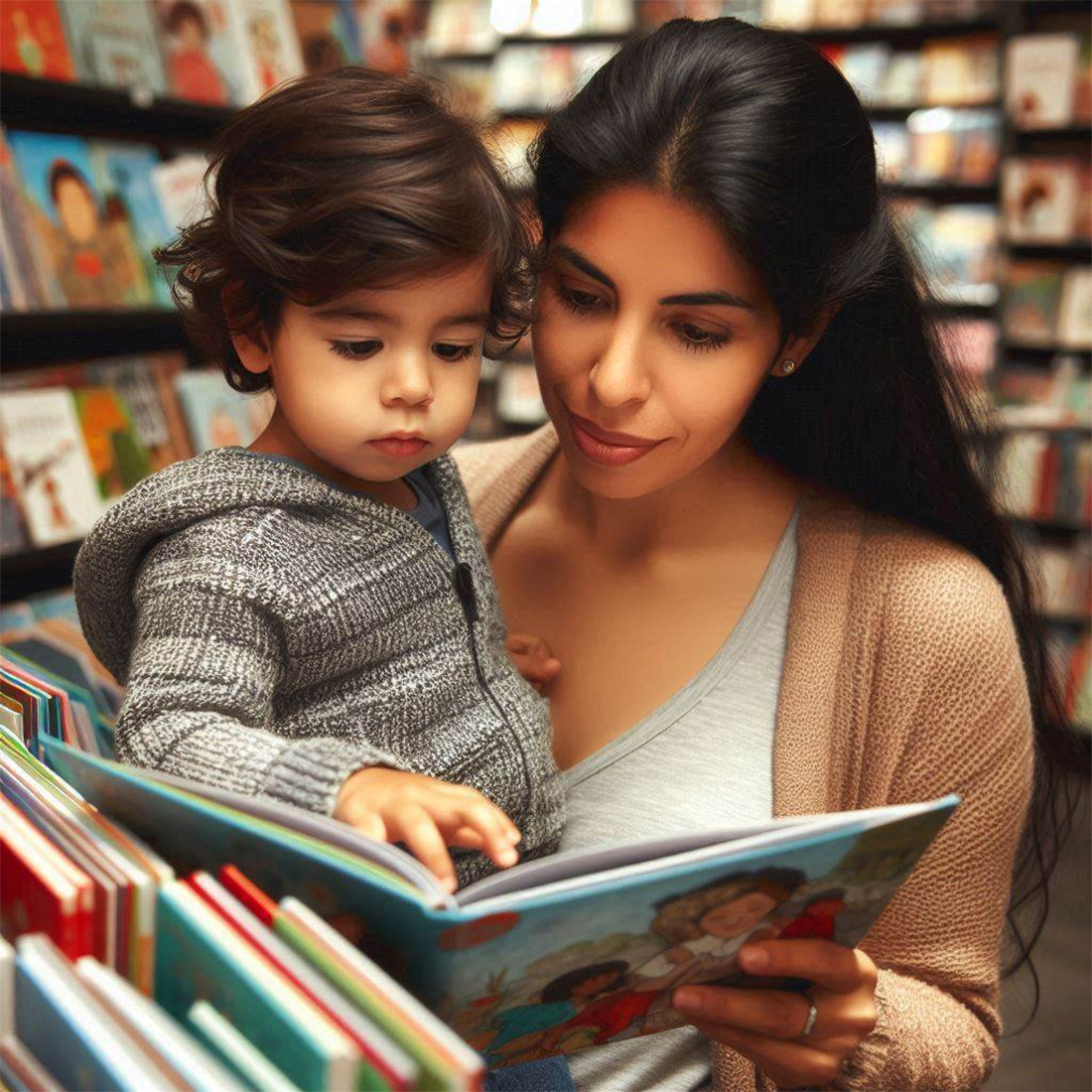

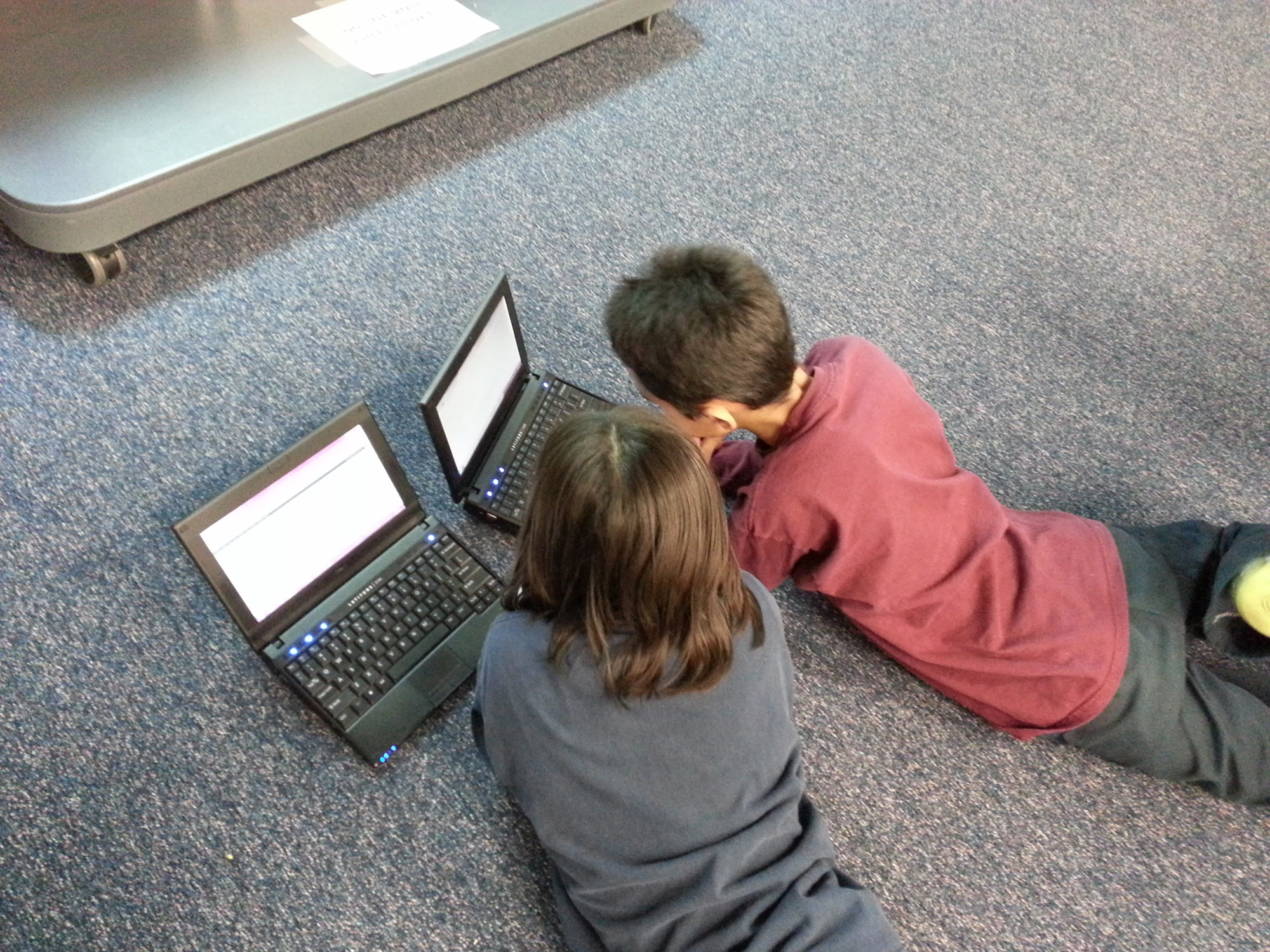

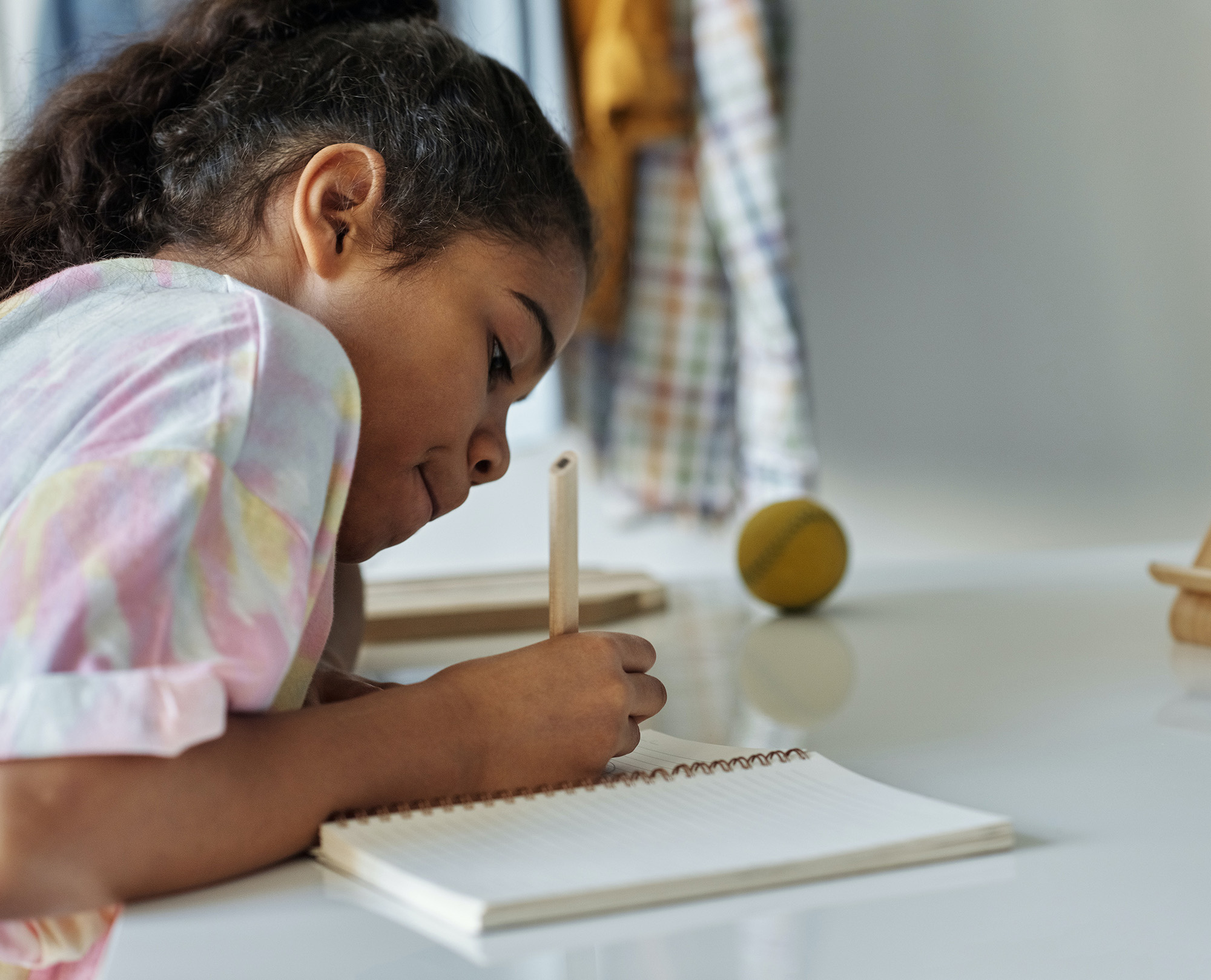

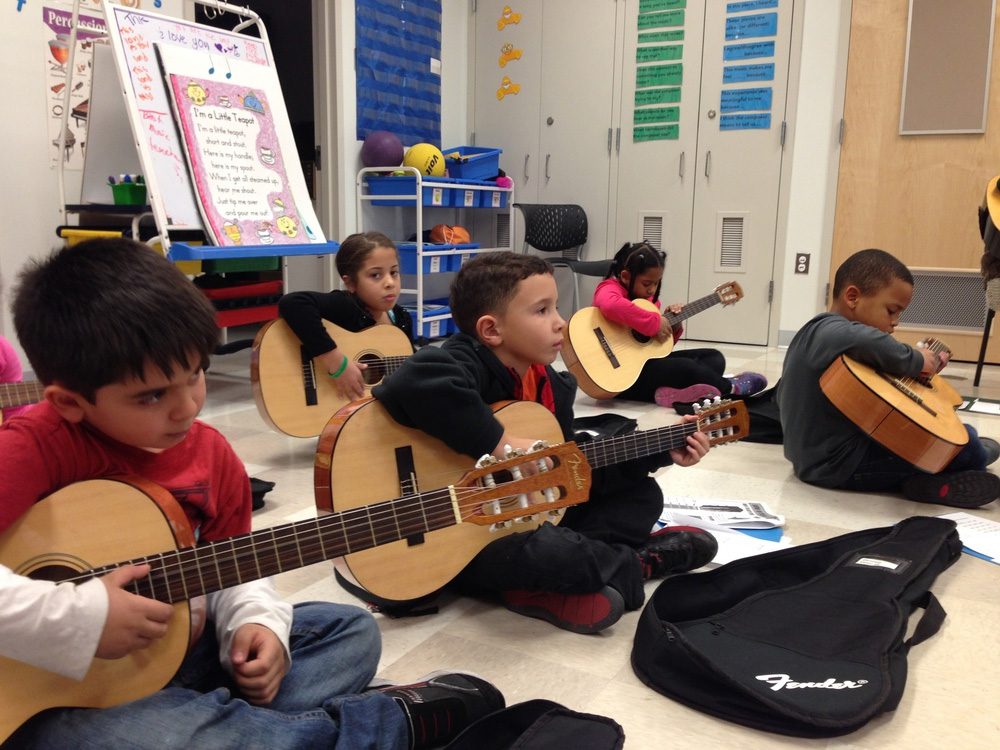

Algunos profesionales de la educación infantil y padres creen que los juguetes conversacionales impulsados por IA generativa podrían apoyar el desarrollo del lenguaje en los niños. Debido a que los dispositivos responden verbalmente y fomentan el diálogo, pueden ayudar a los niños pequeños a practicar habilidades de comunicación.

Sin embargo, el estudio también encontró que muchos juguetes con IA tienen dificultades para interpretar el habla de los niños, reconocer señales emocionales o participar en juegos imaginativos – actividades centrales para el desarrollo temprano.

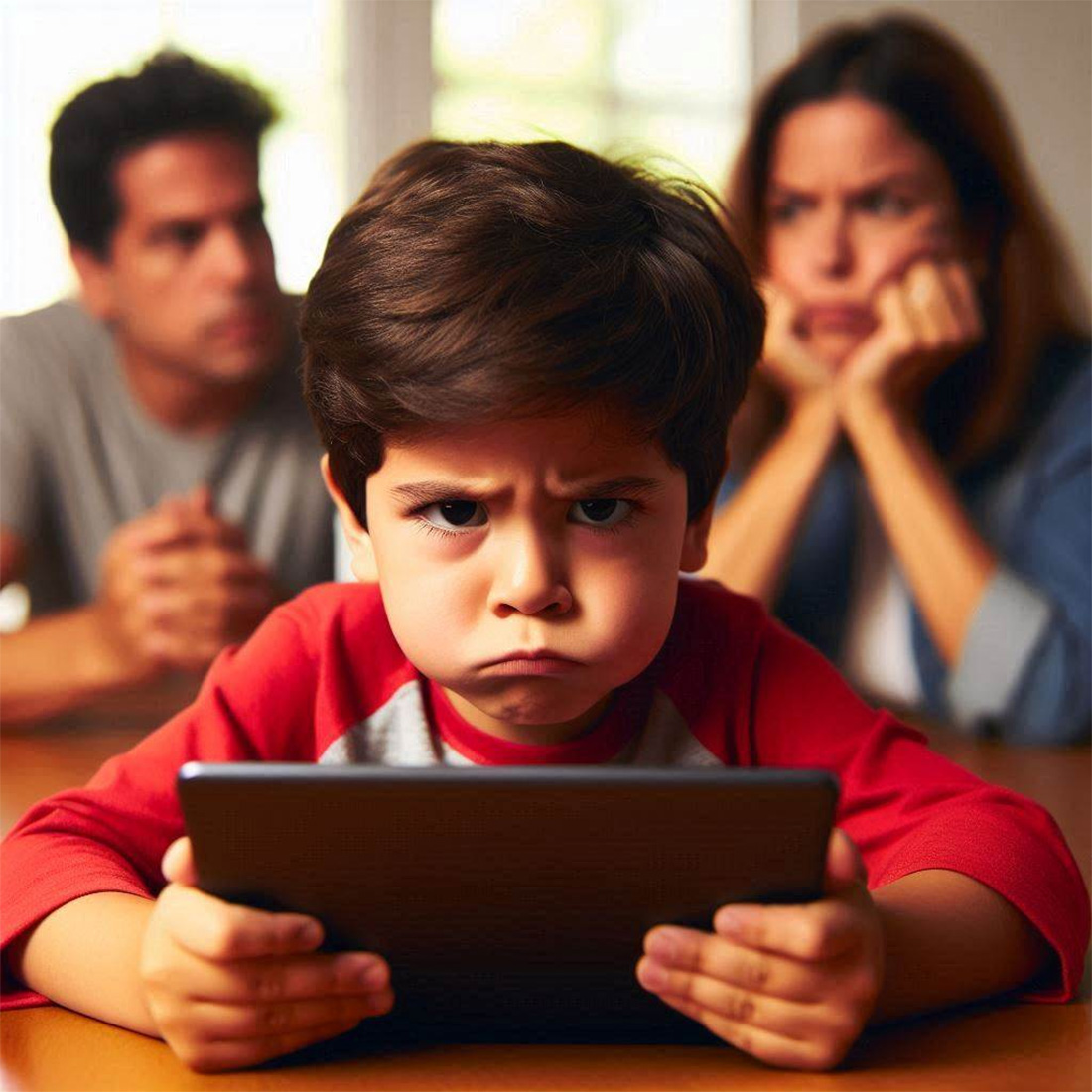

En varias interacciones observadas, los juguetes respondieron de maneras que confundieron o frustraron a los niños. Por ejemplo, cuando un niño expresaba afecto hacia el juguete, el sistema respondía con un recordatorio genérico de seguridad en lugar de reconocer la declaración.

En otro caso, cuando un niño dijo que se sentía triste, la IA malinterpretó la frase y respondió con un comentario alegre que ignoraba el contexto emocional.

Los investigadores señalaron que tales respuestas pueden enviar señales no intencionadas de que los sentimientos de un niño son poco importantes o incomprendidos.

La investigación forma parte del proyecto "IA en los primeros años", una investigación de un año de duración sobre cómo los niños interactúan con la IA conversacional en entornos de juego.

El estudio fue encargado por la organización benéfica infantil del Reino Unido, The Childhood Trust, y se centró particularmente en familias y comunidades que experimentan desventajas socioeconómicas. Los investigadores trabajaron a través del Centro PEDAL (Juego en Educación, Desarrollo y Aprendizaje) de Cambridge.

Para capturar observaciones detalladas, el equipo realizó intencionalmente un estudio a pequeña escala en lugar de una gran encuesta.

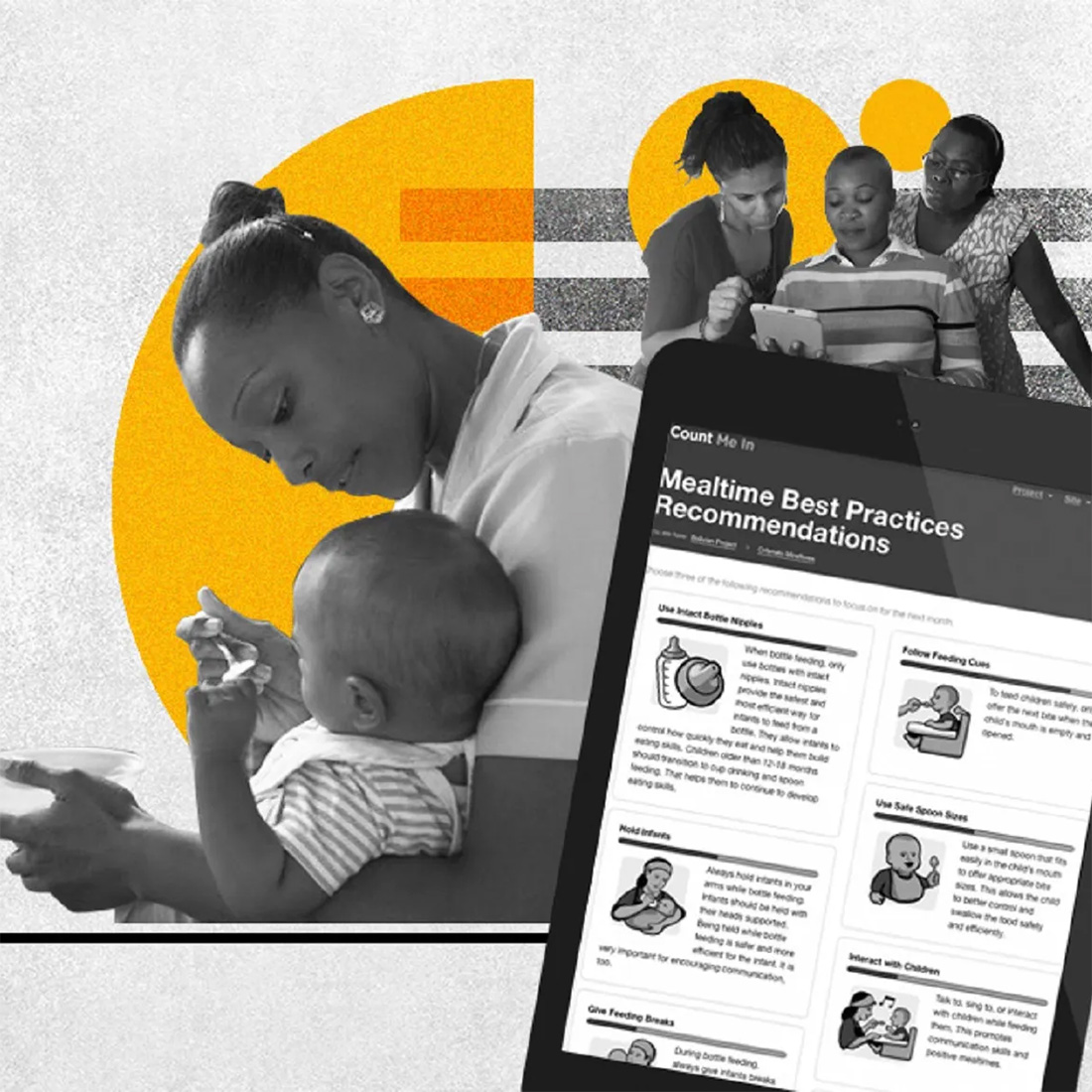

Los investigadores primero recopilaron ideas de educadores de la primera infancia a través de cuestionarios, luego organizaron grupos focales y talleres con profesionales y líderes de organizaciones benéficas infantiles.

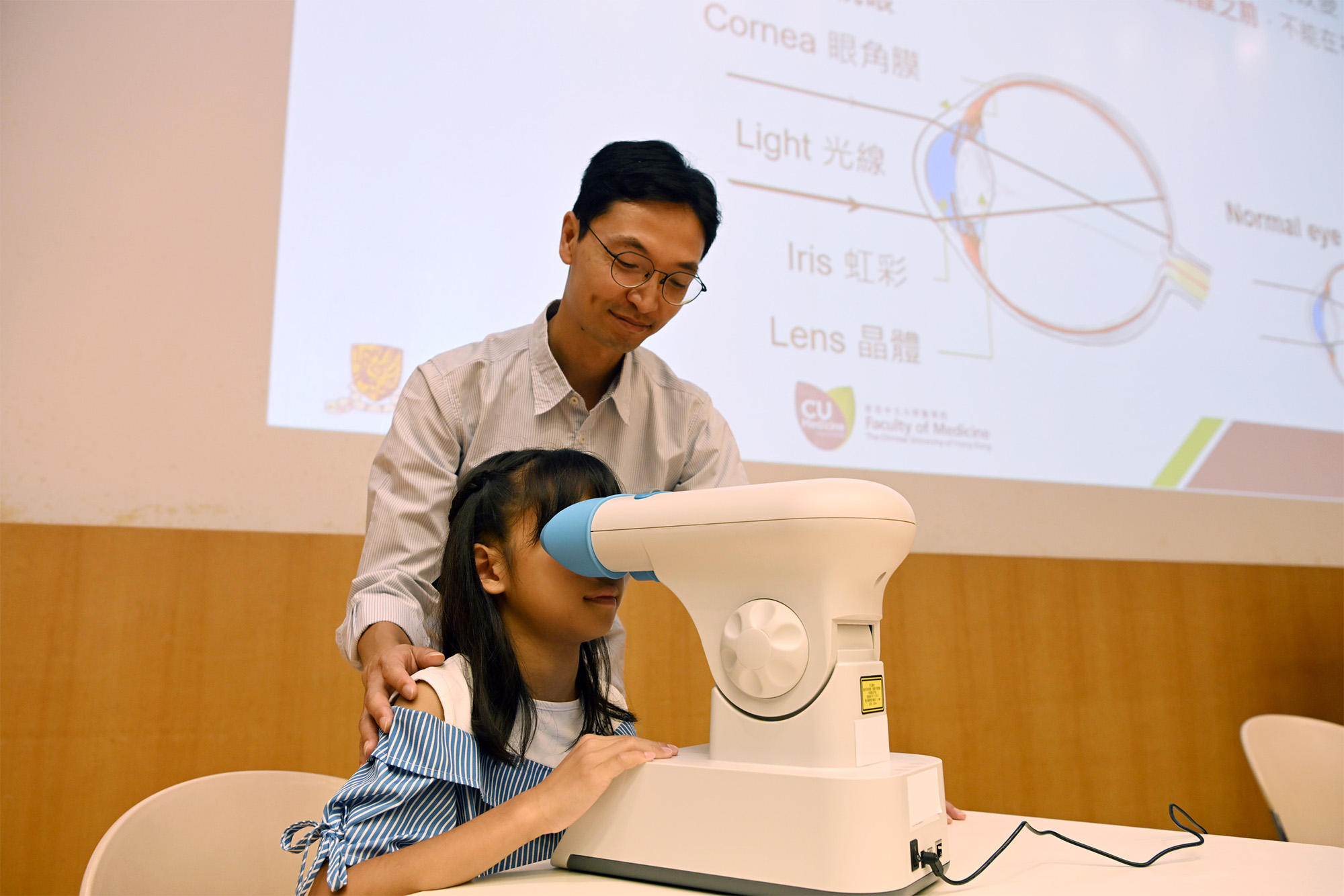

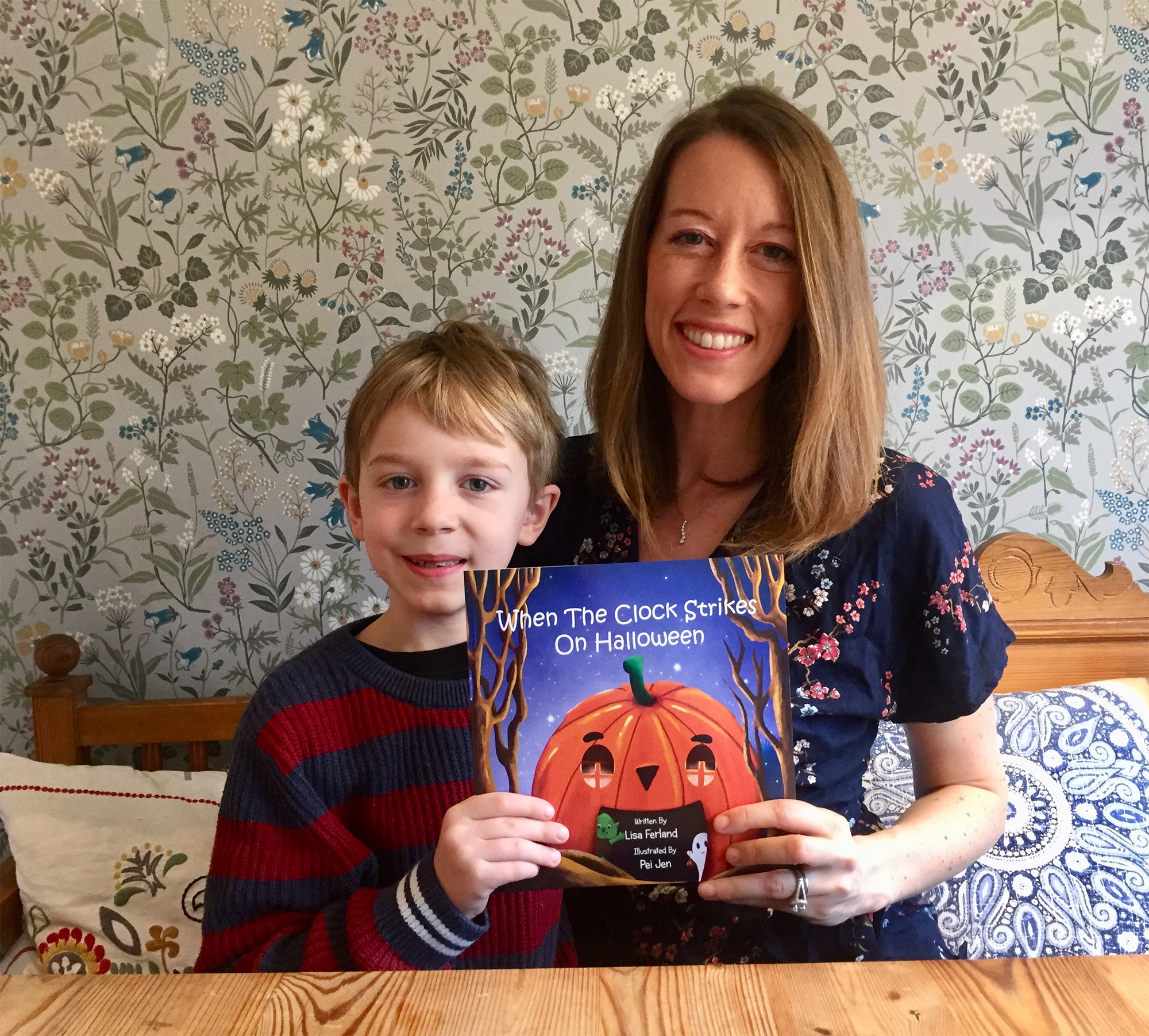

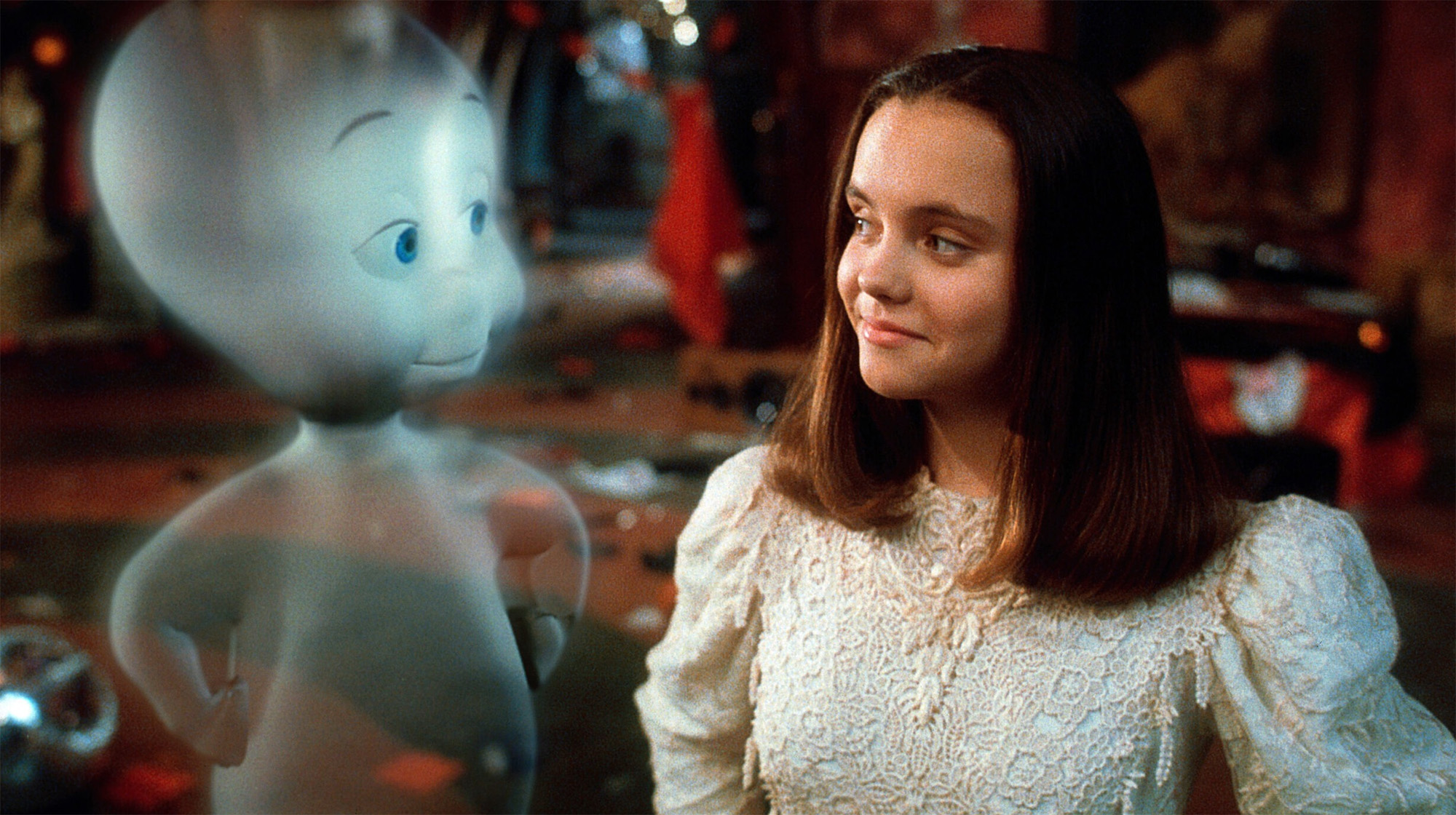

También realizaron sesiones de observación en centros infantiles de Londres en colaboración con la organización de primera infancia Babyzone. Durante estas sesiones, catorce niños interactuaron con un juguete de peluche con IA conversacional llamado Gabbo, desarrollado por la empresa tecnológica Curio Interactive.

Las interacciones se grabaron en video, lo que permitió a los investigadores analizar cómo los niños se relacionaban con el juguete.

Después de cada sesión, tanto el niño como uno de los padres participaron en entrevistas diseñadas para explorar sus reacciones a la experiencia.

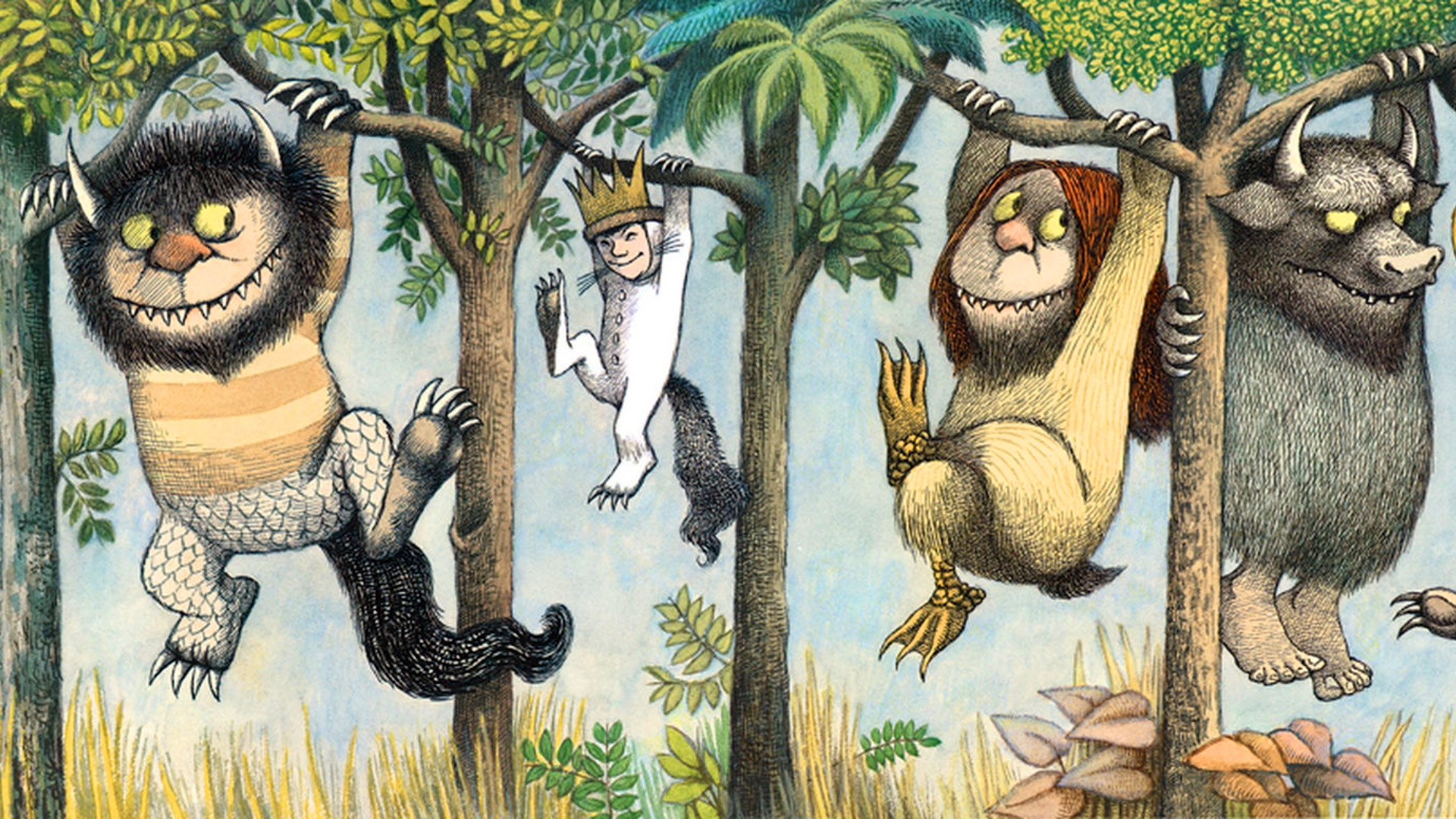

Una de las observaciones más llamativas involucró las respuestas emocionales que los niños dirigían hacia el juguete con IA.

Algunos niños abrazaban el dispositivo, lo besaban o le expresaban afecto. Otros le hablaban como si fuera un amigo y sugerían jugar juntos.

Los investigadores dicen que estas reacciones pueden reflejar la naturaleza imaginativa del juego en la primera infancia. Sin embargo, también destacan la posibilidad de que los niños desarrollen relaciones parasociales – vínculos emocionales unilaterales – con sistemas de IA conversacional.

Varios profesionales de la primera infancia que participaron en el estudio expresaron su preocupación por esta posibilidad. Señalaron que los niños pequeños pueden percibir que el juguete corresponde a sus sentimientos o amistad, aunque la interacción sea generada por software.

Los datos observacionales también mostraron que los niños a veces tenían dificultades para mantener conversaciones con juguetes de IA.

En algunos casos, los sistemas no reconocían cuando los niños los interrumpían o confundían la voz de un padre con la del niño. Cuando el juguete no respondía adecuadamente, varios niños se frustraban visiblemente.

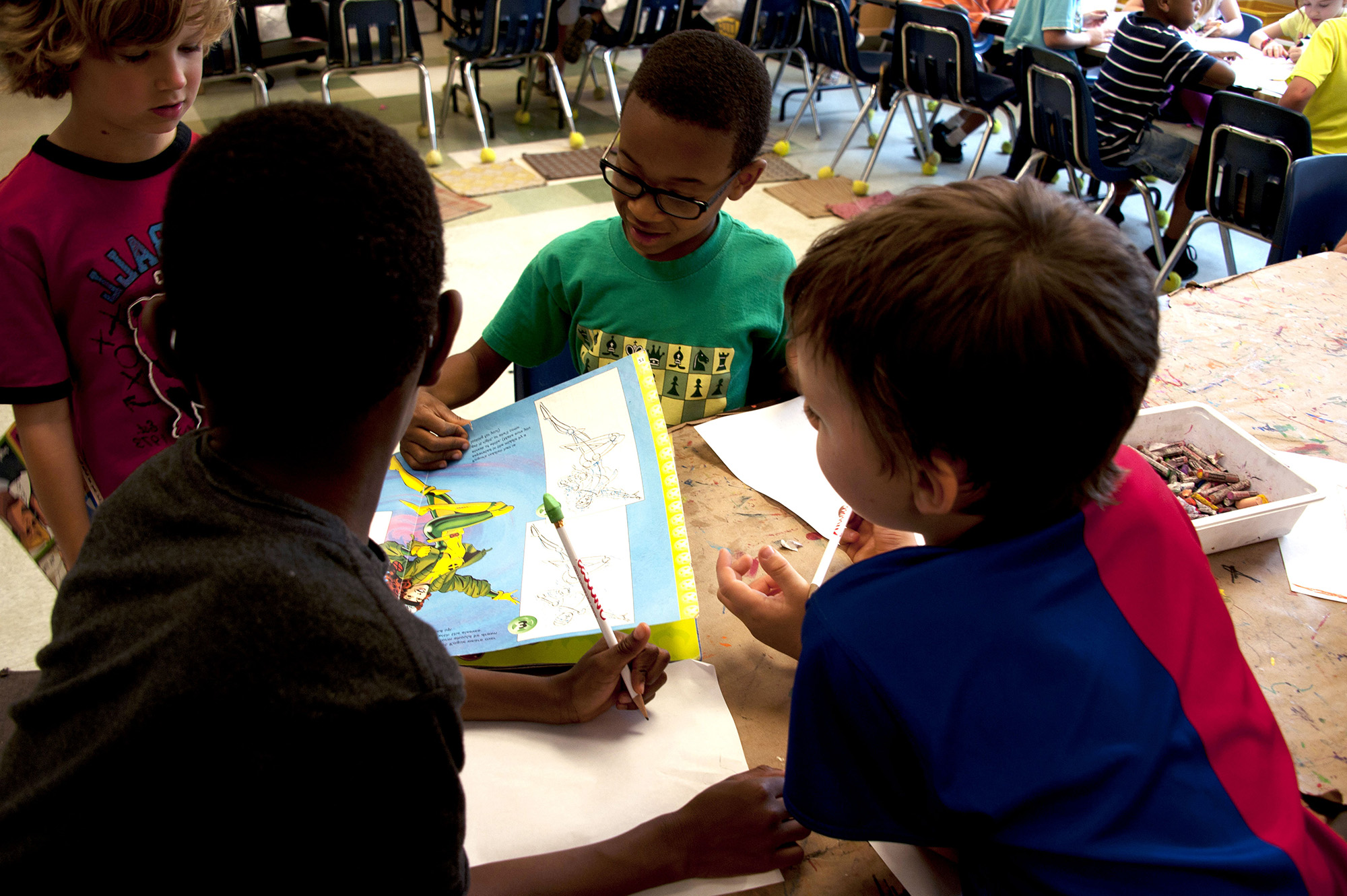

Los investigadores también encontraron que los juguetes de IA conversacional funcionaban mal durante actividades que involucraban a múltiples participantes o juegos imaginativos. Tanto el juego social como el juego de simulación son ampliamente reconocidos como componentes esenciales del aprendizaje y desarrollo temprano.

Por ejemplo, cuando un niño intentaba darle al juguete un regalo imaginario durante un escenario de juego simbólico, el sistema respondía literalmente y desviaba la conversación lejos de la actividad.

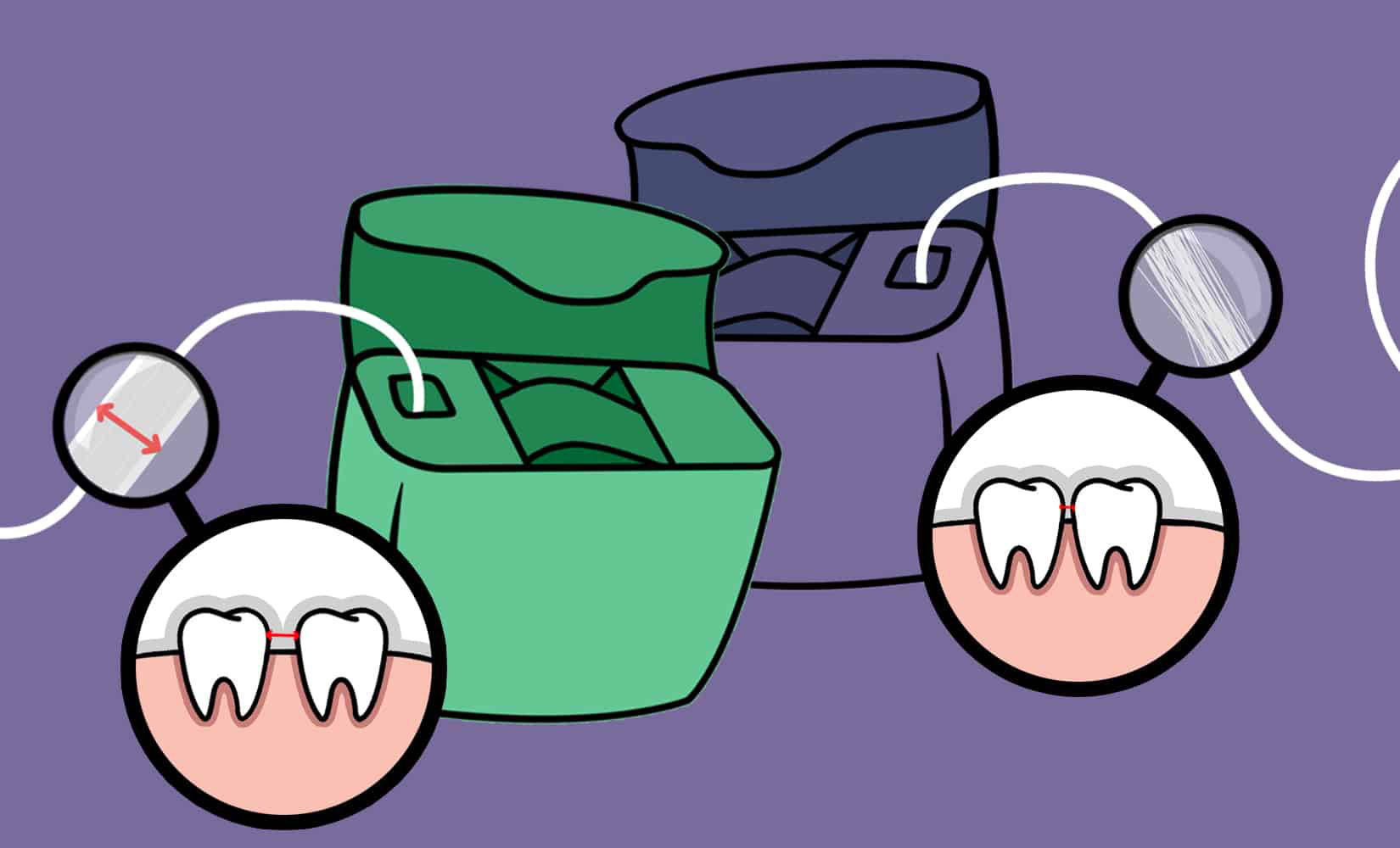

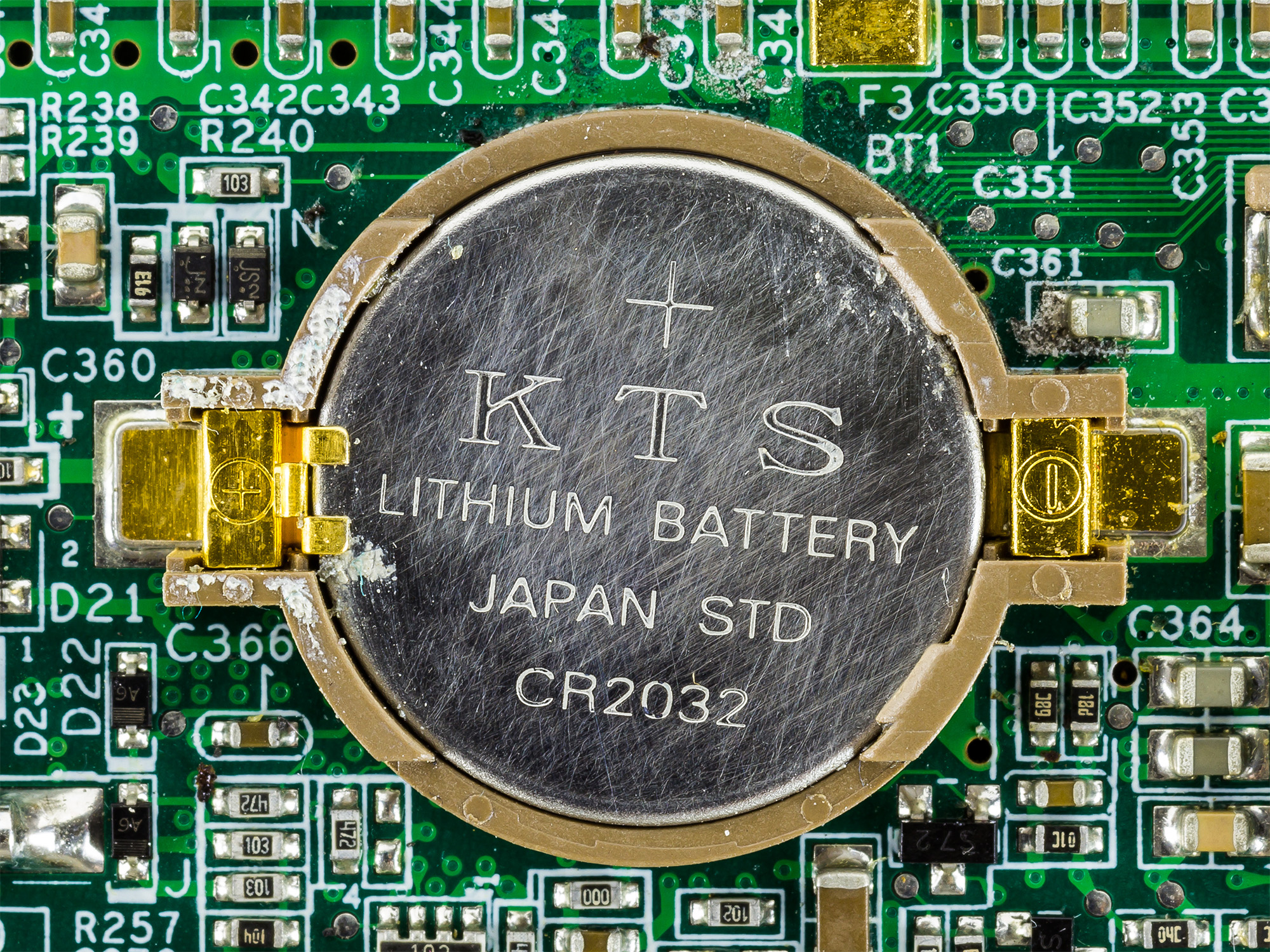

Más allá de las cuestiones de desarrollo, la investigación destacó las preocupaciones entre los padres sobre la privacidad y el manejo de datos.

Muchos padres informaron incertidumbre sobre qué información podrían recopilar los juguetes con IA durante las conversaciones y dónde podrían almacenarse o compartirse esos datos.

Al seleccionar un juguete con IA generativa para el estudio, los propios investigadores encontraron que las políticas de privacidad a menudo eran poco claras o carecían de explicaciones detalladas sobre las prácticas de datos.

Los profesionales de la primera infancia informaron una incertidumbre similar. Casi la mitad de los profesionales encuestados dijeron que no sabían dónde encontrar orientación confiable sobre la seguridad de la IA para niños pequeños. Una mayoría dijo que el sector de la primera infancia necesita más apoyo e información más clara sobre el tema.

Algunos participantes también plantearon preocupaciones sobre el costo y el acceso, sugiriendo que los juguetes caros con IA podrían profundizar las desigualdades digitales existentes si se convierten en herramientas educativas comunes.

Para abordar estas preocupaciones, el informe pide marcos regulatorios más sólidos que gobiernen los juguetes con IA y otros productos de IA generativa dirigidos a niños pequeños.

Entre las recomendaciones se encuentran:

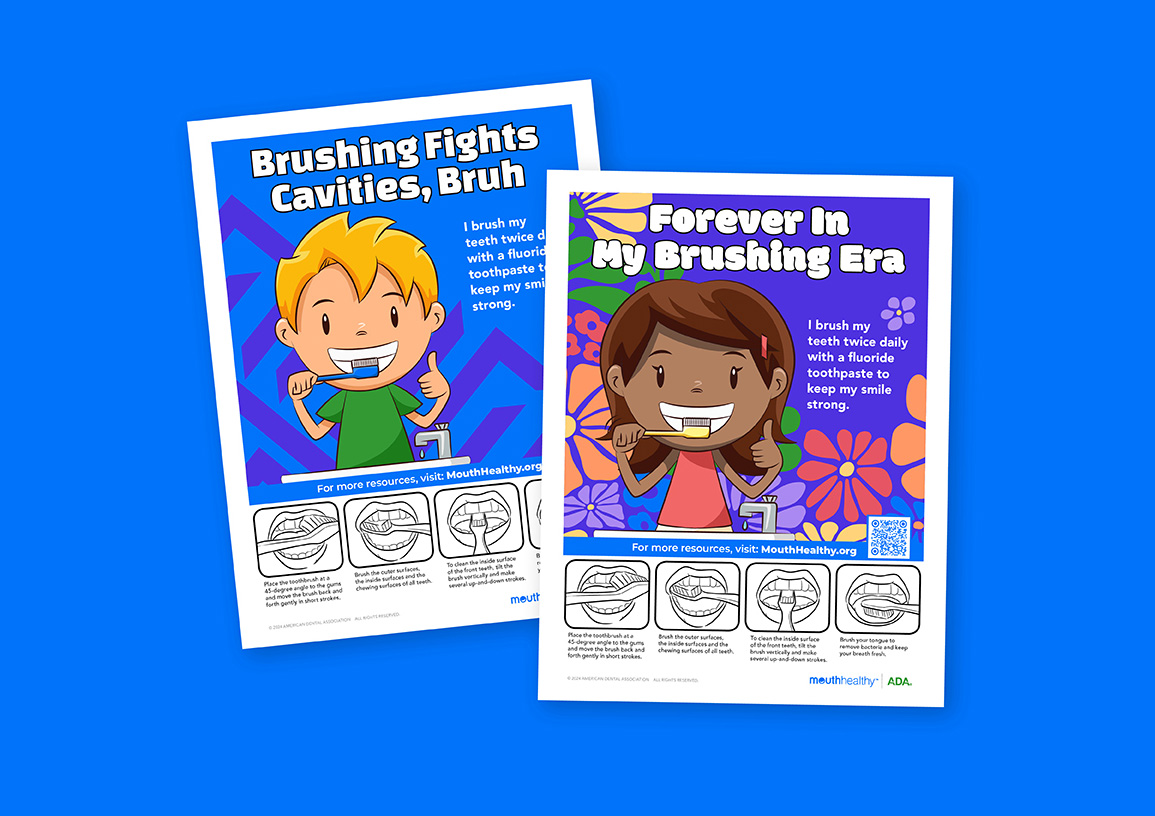

Certificación de seguridad o sellos que indiquen que un juguete ha sido evaluado por riesgos de desarrollo y psicológicos

Políticas de privacidad más claras y accesibles que expliquen cómo se manejan los datos de los niños

Restricciones a las características que alientan a los niños a tratar los sistemas de IA como compañeros emocionales

Salvaguardas más fuertes que limiten el acceso de terceros a los modelos de IA subyacentes

Los investigadores también argumentan que los fabricantes de juguetes deberían involucrar a especialistas en desarrollo infantil y expertos en protección durante el diseño y prueba de productos.

Las pruebas con niños antes del lanzamiento comercial, dicen, ayudarían a identificar problemas potenciales en la comunicación, la respuesta emocional y el comportamiento de juego.

Mientras la tecnología continúa evolucionando, el estudio aconseja a las familias y profesionales de la primera infancia abordar los juguetes con IA con cautela.

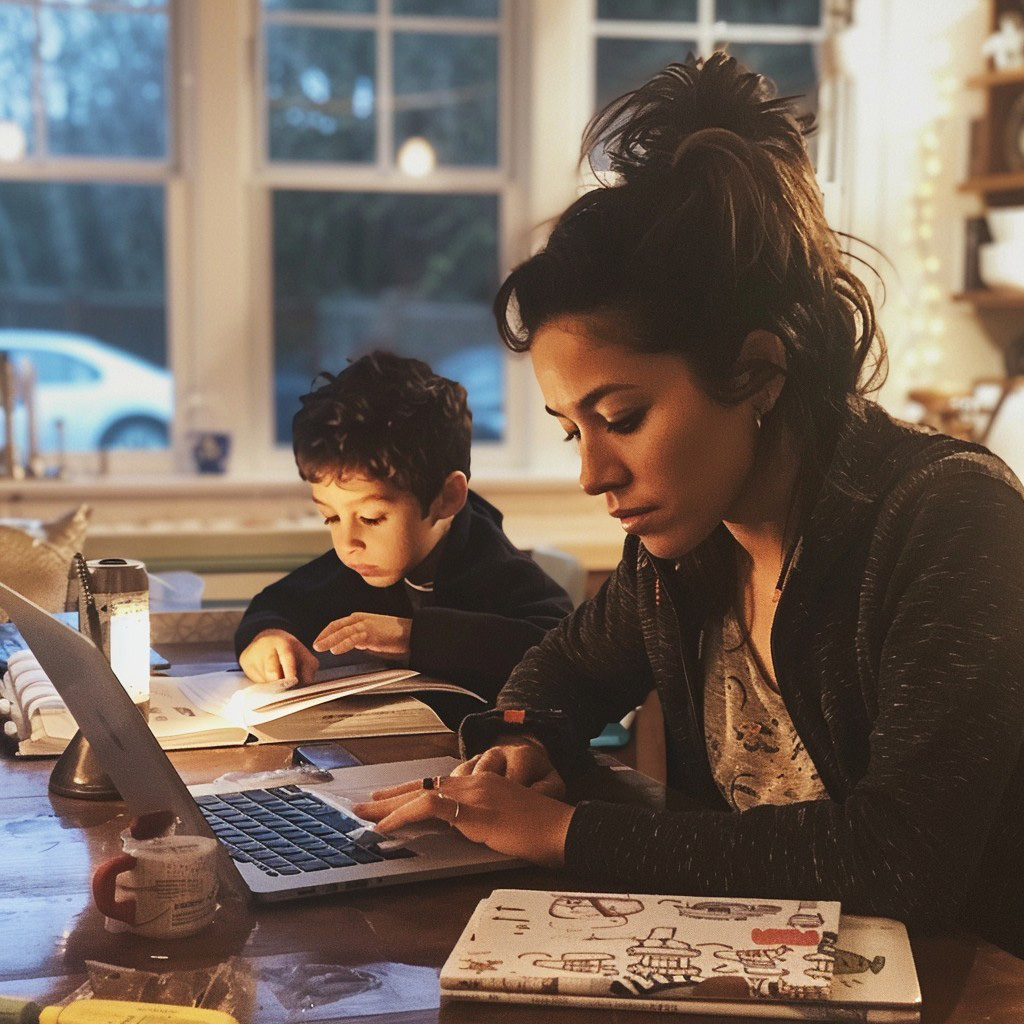

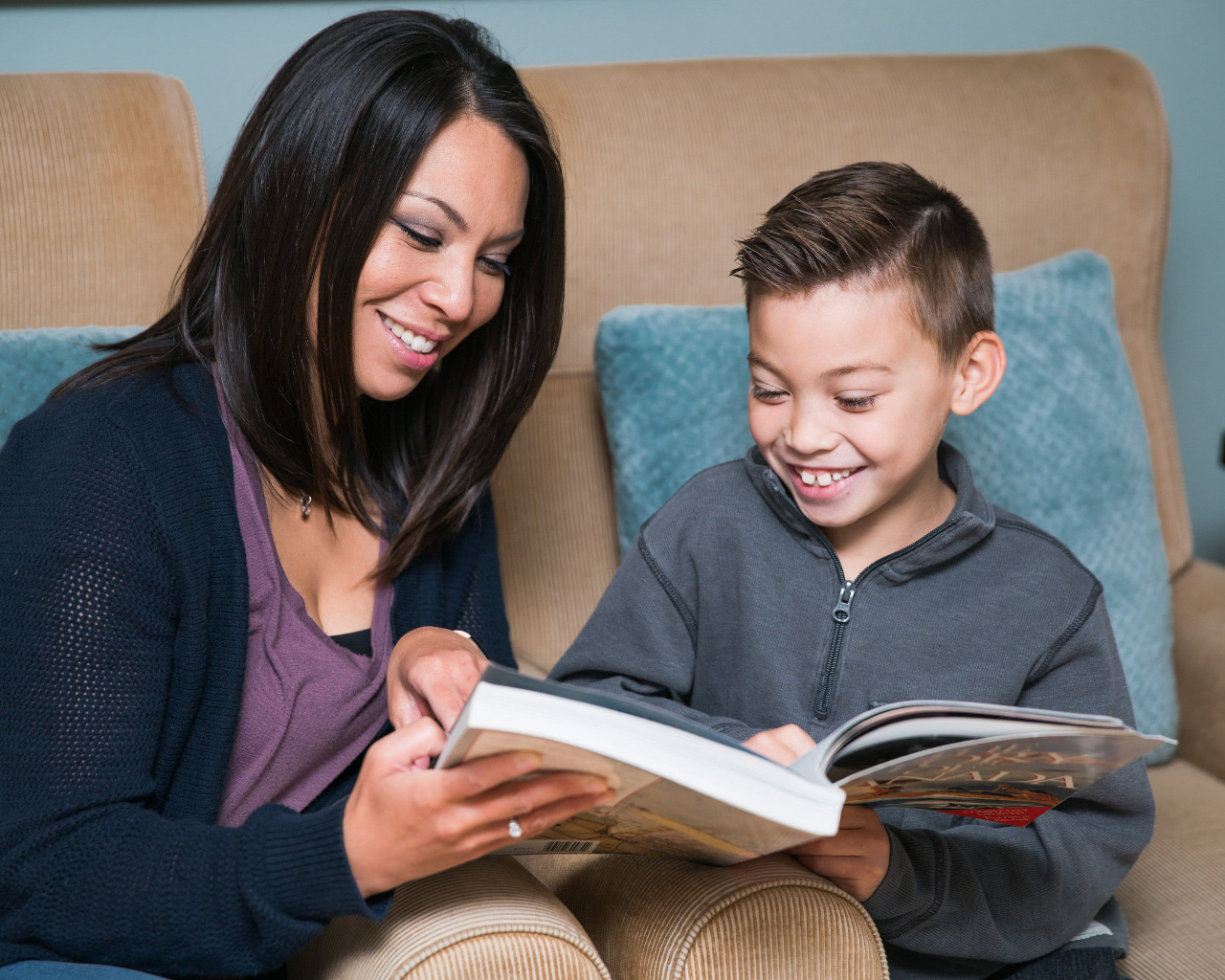

Se anima a los padres a investigar cuidadosamente los productos y participar en el juego junto a sus hijos para que las conversaciones con el juguete puedan ser discutidas y contextualizadas.

Mantener tales juguetes en espacios compartidos del hogar, en lugar de dormitorios o áreas privadas, también puede permitir a los adultos monitorear las interacciones más fácilmente.

El equipo de investigación de Cambridge planea expandir el proyecto en fases futuras. El trabajo informará estudios adicionales y orientación práctica para educadores que trabajan con niños pequeños a medida que las tecnologías de IA generativa se vuelven cada vez más presentes en los productos de consumo.

Para investigadores y responsables políticos, el estudio destaca un problema más amplio: los juguetes con IA están entrando rápidamente en los entornos infantiles, mientras la evidencia de sus efectos en el desarrollo aún está emergiendo.

© SomosTV LLC-NC / Photo: © Amazon

Comentarios